HMY 795: Αναγνώριση Προτύπων. Διαλέξεις 15-16

|

|

|

- Έλλη Παρθενορή Μαρκόπουλος

- 7 χρόνια πριν

- Προβολές:

Transcript

1 HMY 795: Αναγνώριση Προτύπων Διαλέξεις Νευρωνικά Δίκτυα(Neural Networks)

2 Fisher s linear discriminant: Μείωση διαστάσεων (dimensionality reduction) y Τ =w x s + s =w S w 2 2 Τ 1 2 W ( ) 2 2 ( ) m2 m1 = Τ 2 Τ Τ 1 = S B w m w m w w

3 Fisher s linear discriminant- Πολλαπλές κλάσεις Ck (k>2): T y =w x (k=1,2,,d ) k k T y= W x Within-class scatter Between-class scatter S Κ N ( m m)( m m) T B k k k k= 1 s s W B Τ = W S W W Τ = W S W B Τ s S B B J ( W) = = W W Τ s W S W W W W: ιδιοδιανύσματα του 1 S S W B που αντιστοιχούν στις D μεγαλύτερες ιδιοτιμές

4 Γραμμικά διαχωρίσιμα δεδομένα -2 κλάσεις wτ.ω. αν w T x>0όταν xανήκει στην κλάση C 1,w T x<0αν ανήκει στην C 2 Μετ/σμός: -xγια κάθε xστην C 2 : wτ.ω. w T x>0για κάθε x Γενικά: w T x>b(b: margin) w( k+ 1) = w( k) nk ( ) J ( w) Βέλτιστη σταθερά μάθησης: J nk ( ) = T J H J 2 Hessian H = J, Hij Newton-Raphsonupdate: 2 J = wi w j w = w( k ) 1 w( k+ 1) = w( k) H J

5 Perceptronalgorithm: μόνο τα λάθος ταξινομημένα δείγματα αλλάζουν τις τιμές του w T Criterion function JP ( w) = ( w xn) n M Batch training w( k+ 1) = w( k) + nk ( ) xn Single sample training w (1) = αυθαίρετο Για περιθώριο b n M w( k+ 1) = w( k) + x k, k 1 w(1) = αυθαίρετο k w( k+ 1) = w( k) + nk ( ) x, k 1 Τ k όπου w ( k) x b Εναλλακτικές συναρτήσεις κριτηρίου (μη μηδενική Hessian) J q = T ( w) ( w x ) n M n 2 J r T 2 1 ( n b) T ( w) = w x M: w x 2 n b 2n M x n

6 Νευρωνικά Δίκτυα Στα προηγούμενα (παλινδρόμηση και γραμμική ταξινόμηση) είδαμε μοντέλα όπου οι συναρτήσεις βάσης ήταν σταθερές (συγκεκριμένης μορφής) και επίσης ο αριθμός τους ήταν προαποφασισμένος Για προβλήματα με πολλές διαστάσεις μεγάλη αύξηση πολυπλοκότητας Υπάρχουν 2 τρόποι βελτίωσης Επιλογή συναρτήσεων βάσης από τα δεδομένα Χρήση συγκεκριμένου αριθμού συναρτήσεων βάσης, των οποίων οι παράμετροι καθορίζονται από τα δεδομένα εκπαίδευσης προσαρμοστικά (1) Επίσης στα προηγούμενα είδαμε γραμμικές διαχωριστικές συναρτήσεις πολλές φορές δεν είναι ικανοποιητικές για δεδομένα που δεν είναι γραμμικά διαχωρίσιμα (2) Μια προσέγγιση που υλοποιεί τις (1), (2) είναι αυτή των νευρωνικών δικτύων (neural networks) Το όνομα προέρχεται από τις (περιορισμένες) ομοιότητες αυτών των αρχιτεκτονικών με δίκτυα νευρώνων (κύτταρα νευρικού συστήματος) Διαλέγουμε τόσο τις συναρτήσεις βάσης όσο και κατάλληλες μη γραμμικότητες για το δίκτυο και «εκπαιδεύουμε» τις παραμέτρους των κατά τη φάση εκπαίδευσης με βάση παρόμοιες τεχνικές που είδαμε στον αλγόριθμο perceptron (gradient descent)

7 Νευρωνικά Δίκτυα Στο προηγούμενο κεφάλαιο εξετάσαμε μεθόδους σχεδίασης γραμμικών ταξινομητών που μπορούν να υλοποιηθούν με την αρχιτεκτονική δικτύου με ένα στρώμα (singlelayer network) του σχήματος Γενικώς θα δούμε πως μπορούμε να σχεδιάσουμε μοντέλα της μορφής όπου f(.) μια μη γραμμική συνάρτηση ενεργοποίησης (activation function) για προβλήματα ταξινόμησης και παλινδρόμησης. Θέλουμε να είμαστε σε θέση να «μάθουμε» από τα δεδομένα εκπαίδευσης τόσο τις τιμές των συντελεστών w j, όσο και την ακριβή μορφή των συναρτήσεων βάσης φ j (x) καθώς και τη συνάρτηση f(.) Μέχρι στιγμής είδαμε περιπτώσεις όπου η συνάρτηση fείναι η μοναδιαία συνάρτηση (παλινδρόμηση) ή κάποια μη γραμμική συνάρτηση (ταξινόμηση)

8 Νευρωνικά Δίκτυα Ένα απλό πρόβλημα γραμμικής ταξινόμησης το πρόβλημα OR Μπορούμε να σχεδιάσουμε έναν απλόγραμμικό ταξινομητή με ένα στρώμα με w 1 =w 2 =1και w 0 =3/2 Ένα απλό πρόβλημα μη γραμμικής ταξινόμησης το πρόβλημα XOR Μπορούμε να χρησιμοποιήσουμε ένα δίκτυο με δύοστρώματα, όπου η συνάρτηση ενεργοποίησης f είναι:

9 Νευρωνικά Δίκτυα Η βασική αρχιτεκτονική νευρωνικού δικτύου της προηγούμενης διαφάνειας είναι παράδειγμα δίκτυου δύο στρωμάτων(two-layer network) και μπορεί να υλοποιήσει μοντέλα της μορφής Feed-forward network (δίκτυο πρόσω τροφοδότησης), multi-layer perceptron(αναγνωριστής πολλαπλών στρωμάτων) Πρώτο στρώμα/ Στρώμα εισόδου j=1,2,,m(μ αριθμός κρυμμένων μονάδων) weights biases Είσοδοι των κρυμμένων μονάδων a j : activations Συναρτήσεις ενεργοποίησης h(.) (hidden units/hidden layer). Συνηθισμένη επιλογή για προβλήματα ταξινόμησης(όχι η μοναδική όμως): sigmoidal functions

10 Νευρωνικά Δίκτυα Δεύτερο στρώμα Έξοδος: yk = g( ak ) k = 1, 2,..., K K: αριθμός εξόδων Τελικά λοιπόν ο συνολικός μετ/σμός είναι: M D (2) (1) yk = g wkj h wjixi k = 1, 2,..., K j= 0 i= 0 όπου θεωρούμε x 0 =1και z 0 =1, η οποία είναι ίδιας μορφής με την: Παρατήρηση: Αν οι συναρτήσεις ενεργοποίησης των κρυμμένων μονάδων είναι γραμμικές, τότε μπορούμε να βρούμε ένα ισοδύναμο δίκτυο χωρίς το κρυμμένο στρώμα καθώς η αλληλουχία γραμμικών μετασχηματισμών είναι επίσης γραμμικός μετασχηματισμός. Στην περίπτωση αυτή, αν ο αριθμός των κρυμμένων μονάδων Μ είναι μικρότερος από τον αριθμό των εισόδων D ή/και εξόδων Κ τότε ο γραμμικός μετ/σμος δε θα είναι ο γενικότερος δυνατός (απώλεια πληροφορίας λόγω μείωσης των διαστάσεων)

11 Νευρωνικά Δίκτυα Kolmogorov stheorem: Κάθε συνεχής συνάρτηση πολλών μεταβλητών μπορεί να αναπαρασταθεί ως υπέρθεση ενός πεπερασμένου αριθμού συναρτήσεων μιας μεταβλητής στην περίπτωση που το πεδίο τιμών των εισόδων είναι κλειστό και φραγμένο Εφαρμογή στα νευρωνικά δίκτυα: Οποιαδήποτε συνεχής απεικόνιση y(x),όπου το xέχει διάσταση D μπορεί να αναπαρασταθεί ακριβώς από ένα δίκτυο τριών στρωμάτωνμε D(2D+1)μονάδες στο πρώτο στρώμα και 2D+1 στο δεύτερο, όπου οι συναρτήσεις ενεργοποίησης του πρώτου στρώματος h i είναι αυστηρά μονοτονικές και: D 2D+ 1 k = i j i j i= 1 j= 1 z λ h ( x ) y= g( z ) όπου gπραγματική και συνεχής συνάρτηση. Με άλλα λόγια μπορούμε να προσεγγίσουμε κάθε (μη γραμμική) συνεχή συνάρτηση για την οποία το πεδίο τιμών της εισόδου είναι κλειστό και φραγμένο αν το δίκτυο έχει ικανό αριθμό κρυμμένων μονάδων -Universal approximation property of neural networks Το ίδιο ισχύει και για σύνορα αποφάσεων, δηλ. ένα νευρωνικό δίκτυο με τρία στρώματα και συναρτήσεις ενεργοποίησης κατωφλίου ή σιγμοειδείς μπορεί να αναπαραστήσει σύνορα οποιασδήποτε μορφής με αυθαίρετη ακρίβεια (Bishop NN book sections )

12 Παράδειγμα Νευρωνικά Δίκτυα

13 Νευρωνικά Δίκτυα Παράδειγμα: NN με 2 στρώματα 3 μονάδων, σιγμοειδείς συναρτήσεις ενεργοποίησης στο πρώτο στρώμα, γραμμικές συναρτήσεις ενεργοποίησης στο στρώμα εξόδου, x ομοιόμορφο μεταξύ -1 και 1, Ν=50

14 Νευρωνικά Δίκτυα Συμμετρία ως προς τους συντελεστές w j Αν π.χ. οι συναρτήσεις ενεργοποίησης είναι: ha ( ) = tanh( a ) j j η οποία είναι περιττή συνάρτηση (tanh(-a)= -tanh(a)), μπορούμε να αλλάξουμε το πρόσημο όλων των συντελεστών που συνδέονται με την είσοδο των κρυφών μονάδων και να αλλάξουμε ταυτόχρονα το πρόσημο όλων των συντελεστών που «βγαίνουν» από τις μονάδες και να πάρουμε ακριβώς την ίδια απεικόνιση εισόδου/εξόδου Για Μκρυμμένες μονάδες: 2 Μ επιλογές. Γενικά, πολλαπλές επιλογές για τους συντελεστές μπορεί να δίνουν ακριβώς την ίδια απεικόνιση

15 Συναρτήσεις ενεργοποίησης Συναρτήσεις ενεργοποίησης: Μια συνηθισμένη επιλογή είναι η λογιστική σιγμοειδής συνάρτηση(logistic sigmoidal) ειδικά για προβλήματα ταξινόμησης Γιατί? Είδαμε ότι μπορούμε να ερμηνεύσουμε αυτή τη συνάρτηση στο πλαίσιο ενός προβλήματος ταξινόμησης με 2 κλάσεις. Συχνά χρησιμοποιείται και η ισοδύναμη συνάρτηση: a a e e tanh( a) = = 2 σ ( a) 1 a a e + e η οποία μπορεί να δώσει γρηγορότερη σύγκλιση Άλλες πιθανές συναρτήσεις ενεργοποίησης: συνάρτηση κατωφλίου (threshold function) 0, a< 0 g( a) = 1, a 0

16 Συναρτήσεις ενεργοποίησης Softmax function προβλήματα ταξινόμησης Κ κλάσεων:

17 Εκπαίδευση δικτύου Πως μπορούμε να εκτιμήσουμε τις παραμέτρους του δικτύου? Ας υποθέσουμε ότι έχουμε μια συνεχή μεταβλητή στόχου t. Τότε, όπως και στην περίπτωση της γραμμικής παλινδρόμησης μπορούμε να θεωρήσουμε ότι αν έχουμε Γκαουσιανό θόρυβο, η κατανομή του t είναι: Σε αυτή την περίπτωση μπορούμε να πάρουμε μοναδιαία συνάρτηση ενεργοποίησης στην έξοδο (δηλ g(.)). Η αντίστοιχη πιθανοφάνεια είναι: Παίρνοντας αρνητικό λογάριθμο: Μπορούμε να πάρουμε την εκτίμηση μέγιστης πιθανοφάνειας η οποία είναι ισοδύναμη με την ελαχιστοποίηση της συνάρτησης σφάλματος του αθροίσματος των τετραγώνων, δηλ. της:

18 Εκπαίδευση δικτύου Διαφορά με την απλή περίπτωση γραμμικής παλινδρόμησης δεν έχουμε κυρτή συνάρτηση κόστους (nonconvex), μπορεί να έχουμε τοπικά ελάχιστα Αφού υπολογίσουμε το w ML, η ακρίβεια του θορύβου υπολογίζεται όπως και πριν: Αν η συνάρτηση ενεργοποίησης εξόδου είναι μοναδιαία: E yk = ak =yk tk a k Έστω τώρα ότι έχουμε πρόβλημα ταξινόμησης με 2 κλάσεις οπότε η μεταβλητή στόχου tείναι 1 (C 1 )ή 0 (C 2 ). Μπορούμε να θεωρήσουμε ένα δίκτυο με συνάρτηση ενεργοποίησης εξόδου: Η έξοδος μπορεί να ερμηνευθεί ως η εκ των υστέρων πιθανότητα p(c 1 x)άρα p(c 2 x)=1-y=1-y(x,w) Η υπό συνθήκη κατανομή της μεταβλητής στόχου είναι Bernoulli:

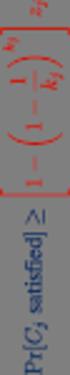

19 Εκπαίδευση δικτύου Για Ν ανεξάρτητες παρατηρήσεις, η πιθανοφάνεια είναι: N tn p( t x,w) = y( x,w) {1 y( x,w)} n= 1 n n 1 t n Παίρνοντας αρνητικό λογάριθμο, η συνάρτηση σφάλματος είναι (cross-entropy error function) N n= 1 { } E( w) = t ln y + (1 t )ln(1 y ) n n n n Αν θέλουμε να λύσουμε Κ προβλήματα 2 κλάσεων ταυτόχρονα -> Κ έξοδοι στο δίκτυο με σιγμοειδείς συναρτήσεις ενεργοποίησης. Η κατανομή του διανύσματος στόχου t είναι και η αντίστοιχη συνάρτηση σφάλματος: Και σε αυτή την περίπτωση: E a k =y k t k

20 Για πρόβλημα Κ κλάσεων έχουμε διάνυσμα στόχουt με Κ στοιχεία εκ των οποίων μόνο ένα μπορεί να ισούται με 1. Δίκτυο με Κ εξόδους κάθε έξοδος αντιστοιχεί στην πιθανότητα: t y ( x,w) = pt ( = 1 x) = y ( x,w) k k k k k= 1 Η πιθανοφάνεια είναι: N K = n = 1 k = 1 tnk p( T w) y nk K Εκπαίδευση δικτύου Η συνάρτηση σφάλματος είναι (αρνητικός λογάριθμος της (1)): multi-class cross entropy error function Σε αυτή την περίπτωση, οι συναρτήσεις ενεργοποίησης αντιστοιχούν στη συνάρτηση softmax: Ακόμη και σε αυτή την περίπτωση: E a k =y k t k

21 Εκπαίδευση δικτύου Ανακεφαλαιώνοντας, ανάλογα με το πρόβλημα επιλέγουμε τις συναρτήσεις ενεργοποίησης εξόδου καθώς και τη συνάρτηση σφάλματος t συνεχής (regression) sum-of-squares, γραμμικές συναρτήσεις ενεργοποίησης στο στρώμα εξόδου Ταξινόμηση 2 κλάσεων (μια ή περισσότερες) σιγμοειδείς συναρτήσεις, cross entropy error function Ταξινόμηση Κ κλάσεων softmax functions, multi-class cross-entropy error

22 Εκπαίδευση δικτύου Ελαχιστοποίηση της συνάρτησης σφάλματος: Επαναληπτική Δεν έχουμε μοναδική λύση! Υπάρχουν ολικά και τοπικά ελάχιστα (global/local minima) δεν υπάρχει εγγύηση ότι μπορεί να βρεθεί το ολικό ελάχιστο Γενικά, οι τεχνικές βελτιστοποίησης για ΝΝ βασίζονται στη μέθοδο καθοδικής κλίσης Μπορούμε να έχουμε εκπαίδευση σε παρτίδες (batch) ή ανά δείγμα (single-sample/stochastic/ sequential gradient descent) Πως μπορεί να υλοποιηθεί η ελαχιστοποίηση σε δίκτυα πολλαπλών στρωμάτων? Backpropagation

HMY 795: Αναγνώριση Προτύπων

HMY 795: Αναγνώριση Προτύπων Διαλέξεις 15 16 Λογιστική παλινδρόμηση (Logistic regression) Νευρωνικά Δίκτυα (Neural Networks) g ( x) = w x+ w T k k k0 1 ( T T WLS = X X) X T= X T Γραμμικές διαχωριστικές

HMY 795: Αναγνώριση Προτύπων Διαλέξεις 15 16 Λογιστική παλινδρόμηση (Logistic regression) Νευρωνικά Δίκτυα (Neural Networks) g ( x) = w x+ w T k k k0 1 ( T T WLS = X X) X T= X T Γραμμικές διαχωριστικές

HMY 795: Αναγνώριση Προτύπων

HMY 795: Αναγνώριση Προτύπων Διαλέξεις 17 18 Νευρωνικά Δίκτυα (Neural Networks) συνέχεια Minimum squared error procedure for classification 1 ( T T wls = X X) X b= X b Xw = b Logistic sigmoidal function

HMY 795: Αναγνώριση Προτύπων Διαλέξεις 17 18 Νευρωνικά Δίκτυα (Neural Networks) συνέχεια Minimum squared error procedure for classification 1 ( T T wls = X X) X b= X b Xw = b Logistic sigmoidal function

HMY 795: Αναγνώριση Προτύπων. Διαλέξεις 13-14

HMY 795: Αναγνώριση Προτύπων Διαλέξεις 13-14 Γραμμικές διαχωριστικές συναρτήσεις(συνέχεια) Επιλογή μοντέλου Δεδομένα επικύρωσης Κανονικοποίηση Bayes Model evidence(τεκμήριο): Η πιθανότητα να παρατηρήσουμε

HMY 795: Αναγνώριση Προτύπων Διαλέξεις 13-14 Γραμμικές διαχωριστικές συναρτήσεις(συνέχεια) Επιλογή μοντέλου Δεδομένα επικύρωσης Κανονικοποίηση Bayes Model evidence(τεκμήριο): Η πιθανότητα να παρατηρήσουμε

HMY 795: Αναγνώριση Προτύπων. Διαλέξεις 17-18

HMY 795: Αναγνώριση Προτύπων Διαλέξεις 17-18 Νευρωνικά Δίκτυα(Neural Networks) - συνέχεια Minimum squared-error procedure for classification 1 ( T T wls = X X) X b= Xb Xw= b Logistic sigmoidal function

HMY 795: Αναγνώριση Προτύπων Διαλέξεις 17-18 Νευρωνικά Δίκτυα(Neural Networks) - συνέχεια Minimum squared-error procedure for classification 1 ( T T wls = X X) X b= Xb Xw= b Logistic sigmoidal function

HMY 795: Αναγνώριση Προτύπων

HMY 795: Αναγνώριση Προτύπων Επανάληψη Expectatio maximizatio for Gaussia mixtures. Αρχικοποιούμε τις άγνωστες παραμέτρους µ k, Σ k και π k 2. Υπολογίσμος των resposibilitiesγ(z k : γ ( z = k π ( x µ ˆ,

HMY 795: Αναγνώριση Προτύπων Επανάληψη Expectatio maximizatio for Gaussia mixtures. Αρχικοποιούμε τις άγνωστες παραμέτρους µ k, Σ k και π k 2. Υπολογίσμος των resposibilitiesγ(z k : γ ( z = k π ( x µ ˆ,

HMY 795: Αναγνώριση Προτύπων

HMY 795: Αναγνώριση Προτύπων Διαλέξεις 9 20 Kernel methods Support vector machines Εκπαίδευση νευρωνικών δικτύων backpropagation:. Υπολογισμός μεταβλητών δικτύου «τρέχον» w () () (2) (2) aj = wji xi ak

HMY 795: Αναγνώριση Προτύπων Διαλέξεις 9 20 Kernel methods Support vector machines Εκπαίδευση νευρωνικών δικτύων backpropagation:. Υπολογισμός μεταβλητών δικτύου «τρέχον» w () () (2) (2) aj = wji xi ak

HMY 795: Αναγνώριση Προτύπων

HMY 795: Αναγνώριση Προτύπων Διαλέξεις 11-12 Γραμμική παλινδρόμηση συνέχεια Γραμμική παλινδρόμηση συνέχεια Γραμμικές διαχωριστικές συναρτήσεις Γραμμική παλινδρόμηση (Linear regression) y = w + wx + + w

HMY 795: Αναγνώριση Προτύπων Διαλέξεις 11-12 Γραμμική παλινδρόμηση συνέχεια Γραμμική παλινδρόμηση συνέχεια Γραμμικές διαχωριστικές συναρτήσεις Γραμμική παλινδρόμηση (Linear regression) y = w + wx + + w

Πανεπιστήµιο Κύπρου Πολυτεχνική Σχολή

Πανεπιστήµιο Κύπρου Πολυτεχνική Σχολή Τµήµα Ηλεκτρολόγων Μηχανικών και Μηχανικών Υπολογιστών ΗΜΜΥ 795: ΑΝΑΓΝΩΡΙΣΗ ΠΡΟΤΥΠΩΝ Ακαδηµαϊκό έτος 2010-11 Χειµερινό Εξάµηνο Τελική εξέταση Τρίτη, 21 εκεµβρίου 2010,

Πανεπιστήµιο Κύπρου Πολυτεχνική Σχολή Τµήµα Ηλεκτρολόγων Μηχανικών και Μηχανικών Υπολογιστών ΗΜΜΥ 795: ΑΝΑΓΝΩΡΙΣΗ ΠΡΟΤΥΠΩΝ Ακαδηµαϊκό έτος 2010-11 Χειµερινό Εξάµηνο Τελική εξέταση Τρίτη, 21 εκεµβρίου 2010,

Το Πολυεπίπεδο Perceptron. "Τεχνητά Νευρωνικά Δίκτυα" (Διαφάνειες), Α. Λύκας, Παν. Ιωαννίνων

Το Πολυ Perceptron Δίκτυα Πρόσθιας Τροφοδότησης (feedforward) Tο αντίστοιχο γράφημα του δικτύου δεν περιλαμβάνει κύκλους: δεν υπάρχει δηλαδή ανατροφοδότηση της εξόδου ενός νευρώνα προς τους νευρώνες από

Το Πολυ Perceptron Δίκτυα Πρόσθιας Τροφοδότησης (feedforward) Tο αντίστοιχο γράφημα του δικτύου δεν περιλαμβάνει κύκλους: δεν υπάρχει δηλαδή ανατροφοδότηση της εξόδου ενός νευρώνα προς τους νευρώνες από

Τεχνητή Νοημοσύνη. 19η διάλεξη ( ) Ίων Ανδρουτσόπουλος.

Τεχνητή Νοημοσύνη 19η διάλεξη (2016-17) Ίων Ανδρουτσόπουλος http://www.aueb.gr/users/ion/ 1 Οι διαφάνειες αυτές βασίζονται σε ύλη των βιβλίων: Artificia Inteigence A Modern Approach των S. Russe και P.

Τεχνητή Νοημοσύνη 19η διάλεξη (2016-17) Ίων Ανδρουτσόπουλος http://www.aueb.gr/users/ion/ 1 Οι διαφάνειες αυτές βασίζονται σε ύλη των βιβλίων: Artificia Inteigence A Modern Approach των S. Russe και P.

ΑΝΑΓΝΩΡΙΣΗ ΠΡΟΤΥΠΩΝ. ΕΝΟΤΗΤΑ: Γραμμικές Συναρτήσεις Διάκρισης. ΔΙΔΑΣΚΟΝΤΕΣ: Βλάμος Π. Αυλωνίτης Μ. ΙΟΝΙΟ ΠΑΝΕΠΙΣΤΗΜΙΟ ΤΜΗΜΑ ΠΛΗΡΟΦΟΡΙΚΗΣ

ΑΝΑΓΝΩΡΙΣΗ ΠΡΟΤΥΠΩΝ ΕΝΟΤΗΤΑ: Γραμμικές Συναρτήσεις Διάκρισης ΙΟΝΙΟ ΠΑΝΕΠΙΣΤΗΜΙΟ ΤΜΗΜΑ ΠΛΗΡΟΦΟΡΙΚΗΣ ΔΙΔΑΣΚΟΝΤΕΣ: Βλάμος Π. Αυλωνίτης Μ. Άδειες Χρήσης Το παρόν εκπαιδευτικό υλικό υπόκειται σε άδειες χρήσης

ΑΝΑΓΝΩΡΙΣΗ ΠΡΟΤΥΠΩΝ ΕΝΟΤΗΤΑ: Γραμμικές Συναρτήσεις Διάκρισης ΙΟΝΙΟ ΠΑΝΕΠΙΣΤΗΜΙΟ ΤΜΗΜΑ ΠΛΗΡΟΦΟΡΙΚΗΣ ΔΙΔΑΣΚΟΝΤΕΣ: Βλάμος Π. Αυλωνίτης Μ. Άδειες Χρήσης Το παρόν εκπαιδευτικό υλικό υπόκειται σε άδειες χρήσης

Ασκήσεις μελέτης της 19 ης διάλεξης

Οικονομικό Πανεπιστήμιο Αθηνών, Τμήμα Πληροφορικής Μάθημα: Τεχνητή Νοημοσύνη, 2016 17 Διδάσκων: Ι. Ανδρουτσόπουλος Ασκήσεις μελέτης της 19 ης διάλεξης 19.1. Δείξτε ότι το Perceptron με (α) συνάρτηση ενεργοποίησης

Οικονομικό Πανεπιστήμιο Αθηνών, Τμήμα Πληροφορικής Μάθημα: Τεχνητή Νοημοσύνη, 2016 17 Διδάσκων: Ι. Ανδρουτσόπουλος Ασκήσεις μελέτης της 19 ης διάλεξης 19.1. Δείξτε ότι το Perceptron με (α) συνάρτηση ενεργοποίησης

HMY 795: Αναγνώριση Προτύπων

HMY 795: Αναγνώριση Προτύπων Διάλεξη 3 Επιλογή μοντέλου Επιλογή μοντέλου Θεωρία αποφάσεων Επιλογή μοντέλου δεδομένα επικύρωσης Η επιλογή του είδους του μοντέλου που θα χρησιμοποιηθεί σε ένα πρόβλημα (π.χ.

HMY 795: Αναγνώριση Προτύπων Διάλεξη 3 Επιλογή μοντέλου Επιλογή μοντέλου Θεωρία αποφάσεων Επιλογή μοντέλου δεδομένα επικύρωσης Η επιλογή του είδους του μοντέλου που θα χρησιμοποιηθεί σε ένα πρόβλημα (π.χ.

Μοντέλο Perceptron πολλών στρωμάτων Multi Layer Perceptron (MLP)

Μοντέλο Perceptron πολλών στρωμάτων Multi Layer Perceptron (MLP) x -0,5 a x x 2 0 0 0 0 - -0,5 y y 0 0 x 2 -,5 a 2 θ η τιμή κατωφλίου Μία λύση του προβλήματος XOR Multi Layer Perceptron (MLP) x -0,5 Μία

Μοντέλο Perceptron πολλών στρωμάτων Multi Layer Perceptron (MLP) x -0,5 a x x 2 0 0 0 0 - -0,5 y y 0 0 x 2 -,5 a 2 θ η τιμή κατωφλίου Μία λύση του προβλήματος XOR Multi Layer Perceptron (MLP) x -0,5 Μία

HMY 795: Αναγνώριση Προτύπων

HMY 795: Αναγνώριση Προτύπων Διάλεξη 5 Κατανομές πιθανότητας και εκτίμηση παραμέτρων Κατανομές πιθανότητας και εκτίμηση παραμέτρων δυαδικές τυχαίες μεταβλητές Διαχωριστικές συναρτήσεις Ταξινόμηση κανονικών

HMY 795: Αναγνώριση Προτύπων Διάλεξη 5 Κατανομές πιθανότητας και εκτίμηση παραμέτρων Κατανομές πιθανότητας και εκτίμηση παραμέτρων δυαδικές τυχαίες μεταβλητές Διαχωριστικές συναρτήσεις Ταξινόμηση κανονικών

HMY 795: Αναγνώριση Προτύπων

HMY 795: Αναγνώριση Προτύπων Διάλεξη 5 Κατανομές πιθανότητας και εκτίμηση παραμέτρων δυαδικές τυχαίες μεταβλητές Bayesian decision Minimum misclassificaxon rate decision: διαλέγουμε την κατηγορία Ck για

HMY 795: Αναγνώριση Προτύπων Διάλεξη 5 Κατανομές πιθανότητας και εκτίμηση παραμέτρων δυαδικές τυχαίες μεταβλητές Bayesian decision Minimum misclassificaxon rate decision: διαλέγουμε την κατηγορία Ck για

Ασκήσεις Φροντιστηρίου «Υπολογιστική Νοημοσύνη Ι» 4 o Φροντιστήριο

Ασκήσεις Φροντιστηρίου 4 o Φροντιστήριο Πρόβλημα 1 ο Ο πίνακας συσχέτισης R x του διανύσματος εισόδου x( στον LMS αλγόριθμο 1 0.5 R x = ορίζεται ως: 0.5 1. Ορίστε το διάστημα των τιμών της παραμέτρου μάθησης

Ασκήσεις Φροντιστηρίου 4 o Φροντιστήριο Πρόβλημα 1 ο Ο πίνακας συσχέτισης R x του διανύσματος εισόδου x( στον LMS αλγόριθμο 1 0.5 R x = ορίζεται ως: 0.5 1. Ορίστε το διάστημα των τιμών της παραμέτρου μάθησης

Σέργιος Θεοδωρίδης Κωνσταντίνος Κουτρούμπας. Version 2

Σέργιος Θεοδωρίδης Κωνσταντίνος Κουτρούμπας Verson ΜΗ ΓΡΑΜΜΙΚΟΙ ΤΑΞΙΝΟΜΗΤΕΣ ΝΕΥΡΩΝΙΚΑ ΔΙΚΤΥΑ Η παραπάνω ανάλυση ήταν χρήσιμη προκειμένου να κατανοήσουμε τη λογική των δικτύων perceptrons πολλών επιπέδων

Σέργιος Θεοδωρίδης Κωνσταντίνος Κουτρούμπας Verson ΜΗ ΓΡΑΜΜΙΚΟΙ ΤΑΞΙΝΟΜΗΤΕΣ ΝΕΥΡΩΝΙΚΑ ΔΙΚΤΥΑ Η παραπάνω ανάλυση ήταν χρήσιμη προκειμένου να κατανοήσουμε τη λογική των δικτύων perceptrons πολλών επιπέδων

Ασκήσεις Φροντιστηρίου «Υπολογιστική Νοημοσύνη Ι» 3ο Φροντιστήριο

Ασκήσεις Φροντιστηρίου 3ο Φροντιστήριο Πρόβλημα 1 ο Το perceptron ενός επιπέδου είναι ένας γραμμικός ταξινομητής προτύπων. Δικαιολογήστε αυτή την πρόταση. x 1 x 2 Έξοδος y x p θ Κατώφλι Perceptron (στοιχειώδης

Ασκήσεις Φροντιστηρίου 3ο Φροντιστήριο Πρόβλημα 1 ο Το perceptron ενός επιπέδου είναι ένας γραμμικός ταξινομητής προτύπων. Δικαιολογήστε αυτή την πρόταση. x 1 x 2 Έξοδος y x p θ Κατώφλι Perceptron (στοιχειώδης

Βασικές αρχές εκπαίδευσης ΤΝΔ: το perceptron. "Τεχνητά Νευρωνικά Δίκτυα" (Διαφάνειες), Α. Λύκας, Παν. Ιωαννίνων

Βασικές αρχές εκπαίδευσης ΤΝΔ: το perceptron Βιολογικός Νευρώνας Δενδρίτες, που αποτελούν τις γραμμές εισόδου των ερεθισμάτων (βιολογικών σημάτων) Σώμα, στο οποίο γίνεται η συσσώρευση των ερεθισμάτων και

Βασικές αρχές εκπαίδευσης ΤΝΔ: το perceptron Βιολογικός Νευρώνας Δενδρίτες, που αποτελούν τις γραμμές εισόδου των ερεθισμάτων (βιολογικών σημάτων) Σώμα, στο οποίο γίνεται η συσσώρευση των ερεθισμάτων και

HMY 795: Αναγνώριση Προτύπων

HMY 795: Αναγνώριση Προτύπων Διαλέξεις 9 10 Γραμμική παλινδρόμηση (Linear regression) Μπεϋζιανή εκτίμηση για την κανονική κατανομή Γνωστή μέση τιμή μ, άγνωστη διασπορά σ 2. Ακρίβεια λ=1/σ 2 : conjugate

HMY 795: Αναγνώριση Προτύπων Διαλέξεις 9 10 Γραμμική παλινδρόμηση (Linear regression) Μπεϋζιανή εκτίμηση για την κανονική κατανομή Γνωστή μέση τιμή μ, άγνωστη διασπορά σ 2. Ακρίβεια λ=1/σ 2 : conjugate

Μέθοδοι Μηχανών Μάθησης για Ευφυή Αναγνώριση και ιάγνωση Ιατρικών εδοµένων

Μέθοδοι Μηχανών Μάθησης για Ευφυή Αναγνώριση και ιάγνωση Ιατρικών εδοµένων Εισηγητής: ρ Ηλίας Ζαφειρόπουλος Εισαγωγή Ιατρικά δεδοµένα: Συλλογή Οργάνωση Αξιοποίηση Data Mining ιαχείριση εδοµένων Εκπαίδευση

Μέθοδοι Μηχανών Μάθησης για Ευφυή Αναγνώριση και ιάγνωση Ιατρικών εδοµένων Εισηγητής: ρ Ηλίας Ζαφειρόπουλος Εισαγωγή Ιατρικά δεδοµένα: Συλλογή Οργάνωση Αξιοποίηση Data Mining ιαχείριση εδοµένων Εκπαίδευση

HMY 795: Αναγνώριση Προτύπων

HMY 795: Αναγνώριση Προτύπων Διάλεξη 4 Διαχωριστικές συναρτήσεις Ταξινόμηση Γκαουσιανών μεταβλητών Bayesan decson Mnmum msclassfcaton rate decson: διαλέγουμε την κατηγορίαck για την οποία η εκ των υστέρων

HMY 795: Αναγνώριση Προτύπων Διάλεξη 4 Διαχωριστικές συναρτήσεις Ταξινόμηση Γκαουσιανών μεταβλητών Bayesan decson Mnmum msclassfcaton rate decson: διαλέγουμε την κατηγορίαck για την οποία η εκ των υστέρων

Πανεπιστήμιο Κύπρου Πολυτεχνική Σχολή

Πανεπιστήμιο Κύπρου Πολυτεχνική Σχολή Τμήμα Ηλεκτρολόγων Μηχανικών και Μηχανικών Υπολογιστών ΗΜΜΥ 795: ΑΝΑΓΝΩΡΙΣΗ ΠΡΟΤΥΠΩΝ Ακαδημαϊκό έτος 2010-11 Χειμερινό Εξάμηνο Practice final exam 1. Έστω ότι για

Πανεπιστήμιο Κύπρου Πολυτεχνική Σχολή Τμήμα Ηλεκτρολόγων Μηχανικών και Μηχανικών Υπολογιστών ΗΜΜΥ 795: ΑΝΑΓΝΩΡΙΣΗ ΠΡΟΤΥΠΩΝ Ακαδημαϊκό έτος 2010-11 Χειμερινό Εξάμηνο Practice final exam 1. Έστω ότι για

Μη γραµµικοί ταξινοµητές Νευρωνικά ίκτυα

KEΣ 3 Αναγνώριση Προτύπων και Ανάλυση Εικόνας Μη γραµµικοί ταξινοµητές Νευρωνικά ίκτυα ΤµήµαΕπιστήµης και Τεχνολογίας Τηλεπικοινωνιών Πανεπιστήµιο Πελοποννήσου Εισαγωγή Πολυεπίπεδες Perceptron Οαλγόριθµος

KEΣ 3 Αναγνώριση Προτύπων και Ανάλυση Εικόνας Μη γραµµικοί ταξινοµητές Νευρωνικά ίκτυα ΤµήµαΕπιστήµης και Τεχνολογίας Τηλεπικοινωνιών Πανεπιστήµιο Πελοποννήσου Εισαγωγή Πολυεπίπεδες Perceptron Οαλγόριθµος

ΔΙΚΤΥO RBF. "Τεχνητά Νευρωνικά Δίκτυα" (Διαφάνειες), Α. Λύκας, Παν. Ιωαννίνων

ΔΙΚΤΥO RBF Αρχιτεκτονική δικτύου RBF Δίκτυα RBF: δίκτυα συναρτήσεων πυρήνα (radial basis function networks). Πρόσθιας τροφοδότησης (feedforward) για προβλήματα μάθησης με επίβλεψη. Εναλλακτικό του MLP.

ΔΙΚΤΥO RBF Αρχιτεκτονική δικτύου RBF Δίκτυα RBF: δίκτυα συναρτήσεων πυρήνα (radial basis function networks). Πρόσθιας τροφοδότησης (feedforward) για προβλήματα μάθησης με επίβλεψη. Εναλλακτικό του MLP.

Σέργιος Θεοδωρίδης Κωνσταντίνος Κουτρούμπας. Version 2

Σέργιος Θεοδωρίδης Κωνσταντίνος Κουτρούμπας Verson 2 1 ΧΑΡΤΟΓΡΑΦΗΣΗ ΤΟΥ ΧΩΡΟΥ ΤΩΝ ΤΑΞΙΝΟΜΗΤΩΝ Ταξινομητές Ταξινομητές συναρτ. διάκρισης Ταξινομητές επιφανειών απόφ. Παραμετρικοί ταξινομητές Μη παραμετρικοί

Σέργιος Θεοδωρίδης Κωνσταντίνος Κουτρούμπας Verson 2 1 ΧΑΡΤΟΓΡΑΦΗΣΗ ΤΟΥ ΧΩΡΟΥ ΤΩΝ ΤΑΞΙΝΟΜΗΤΩΝ Ταξινομητές Ταξινομητές συναρτ. διάκρισης Ταξινομητές επιφανειών απόφ. Παραμετρικοί ταξινομητές Μη παραμετρικοί

Σέργιος Θεοδωρίδης Κωνσταντίνος Κουτρούμπας. Version 2

Σέργιος Θεοδωρίδης Κωνσταντίνος Κουτρούμπας Verson ΧΑΡΤΟΓΡΑΦΗΣΗ ΤΟΥ ΧΩΡΟΥ ΤΩΝ ΤΑΞΙΝΟΜΗΤΩΝ Ταξινομητές Ταξινομητές συναρτ. διάκρισης Ταξινομητές επιφανειών απόφ. Παραμετρικοί ταξινομητές Μη παραμετρικοί

Σέργιος Θεοδωρίδης Κωνσταντίνος Κουτρούμπας Verson ΧΑΡΤΟΓΡΑΦΗΣΗ ΤΟΥ ΧΩΡΟΥ ΤΩΝ ΤΑΞΙΝΟΜΗΤΩΝ Ταξινομητές Ταξινομητές συναρτ. διάκρισης Ταξινομητές επιφανειών απόφ. Παραμετρικοί ταξινομητές Μη παραμετρικοί

Τεχνητή Νοημοσύνη. 18η διάλεξη ( ) Ίων Ανδρουτσόπουλος.

Τεχνητή Νοημοσύνη 18η διάλεξη (2016-17) Ίων Ανδρουτσόπουλος http://www.aueb.gr/users/ion/ 1 Οι διαφάνειες αυτής της διάλεξης βασίζονται: στο βιβλίο Machine Learning του T. Mitchell, McGraw- Hill, 1997,

Τεχνητή Νοημοσύνη 18η διάλεξη (2016-17) Ίων Ανδρουτσόπουλος http://www.aueb.gr/users/ion/ 1 Οι διαφάνειες αυτής της διάλεξης βασίζονται: στο βιβλίο Machine Learning του T. Mitchell, McGraw- Hill, 1997,

Σέργιος Θεοδωρίδης Κωνσταντίνος Κουτρούμπας. Version 2

Σέργιος Θεοδωρίδης Κωνσταντίνος Κουτρούμπας Verson 2 1 M = 1 N = N prob k N k { k n ω wrongly classfed} = (1 ) N k 2 Η συνάρτηση πιθανοφάνειας L(p) μεγιστοποιείται όταν =k/n. 3 Αφού τα s είναι άγνωστα,

Σέργιος Θεοδωρίδης Κωνσταντίνος Κουτρούμπας Verson 2 1 M = 1 N = N prob k N k { k n ω wrongly classfed} = (1 ) N k 2 Η συνάρτηση πιθανοφάνειας L(p) μεγιστοποιείται όταν =k/n. 3 Αφού τα s είναι άγνωστα,

Σέργιος Θεοδωρίδης Κωνσταντίνος Κουτρούμπας. Version 2

Σέργιος Θεοδωρίδης Κωνσταντίνος Κουτρούμπας Verson ΜΙΑ ΣΥΜΒΑΣΗ: Προκειμένου να καταστήσουμε πιο συμπαγή το συμβολισμό H : ορίζουμε Ετσι έχουμε *=[ ] an *=[ ]. H : * * ΣΗΜΕΙΩΣΗ: Στη συνέχεια εκτός αν ορίζεται

Σέργιος Θεοδωρίδης Κωνσταντίνος Κουτρούμπας Verson ΜΙΑ ΣΥΜΒΑΣΗ: Προκειμένου να καταστήσουμε πιο συμπαγή το συμβολισμό H : ορίζουμε Ετσι έχουμε *=[ ] an *=[ ]. H : * * ΣΗΜΕΙΩΣΗ: Στη συνέχεια εκτός αν ορίζεται

Νευρωνικά Δίκτυα στο Matlab

Νευρωνικά Δίκτυα στο Matlab Ρ202 Μηχανική Ευφυΐα (Machine Intelligence) Ευστάθιος Αντωνίου Τμήμα Μηχανικών Πληροφορικής Αλεξάνδρειο ΤΕΙ Θεσσαλονίκης E-mail: antoniou@itteithegr Πρόγραμμα Μεταπτυχιακών

Νευρωνικά Δίκτυα στο Matlab Ρ202 Μηχανική Ευφυΐα (Machine Intelligence) Ευστάθιος Αντωνίου Τμήμα Μηχανικών Πληροφορικής Αλεξάνδρειο ΤΕΙ Θεσσαλονίκης E-mail: antoniou@itteithegr Πρόγραμμα Μεταπτυχιακών

HMY 795: Αναγνώριση Προτύπων

HMY 795: Αναγνώριση Προτύπων Διαλέξεις 7-8 Μπεϋζιανή εκτίμηση - συνέχεια Μη παραμετρικές μέθοδοι εκτίμησης πυκνότητας Δυαδικές τ.μ. κατανομή Bernoulli : Εκτίμηση ML: Εκτίμηση Bayes για εκ των προτέρων

HMY 795: Αναγνώριση Προτύπων Διαλέξεις 7-8 Μπεϋζιανή εκτίμηση - συνέχεια Μη παραμετρικές μέθοδοι εκτίμησης πυκνότητας Δυαδικές τ.μ. κατανομή Bernoulli : Εκτίμηση ML: Εκτίμηση Bayes για εκ των προτέρων

Πολλαπλή παλινδρόμηση (Multivariate regression)

ΜΑΘΗΜΑ 3 ο 1 Πολλαπλή παλινδρόμηση (Multivariate regression) Η συμπεριφορά των περισσότερων οικονομικών μεταβλητών είναι συνάρτηση όχι μιας αλλά πολλών μεταβλητών Υ = f ( X 1, X 2,... X n ) δηλαδή η Υ

ΜΑΘΗΜΑ 3 ο 1 Πολλαπλή παλινδρόμηση (Multivariate regression) Η συμπεριφορά των περισσότερων οικονομικών μεταβλητών είναι συνάρτηση όχι μιας αλλά πολλών μεταβλητών Υ = f ( X 1, X 2,... X n ) δηλαδή η Υ

Τεχνητή Νοημοσύνη. 17η διάλεξη ( ) Ίων Ανδρουτσόπουλος.

Τεχνητή Νοημοσύνη 17η διάλεξη (2016-17) Ίων Ανδρουτσόπουλος http://.aueb.gr/users/ion/ 1 Οι διαφάνειες αυτής της διάλεξης βασίζονται: στο βιβλίο Artificia Inteigence A Modern Approach των S. Russe και

Τεχνητή Νοημοσύνη 17η διάλεξη (2016-17) Ίων Ανδρουτσόπουλος http://.aueb.gr/users/ion/ 1 Οι διαφάνειες αυτής της διάλεξης βασίζονται: στο βιβλίο Artificia Inteigence A Modern Approach των S. Russe και

HMY 795: Αναγνώριση Προτύπων. Διάλεξη 2

HMY 795: Αναγνώριση Προτύπων Διάλεξη 2 Επισκόπηση θεωρίας πιθανοτήτων Θεωρία πιθανοτήτων Τυχαία μεταβλητή: Μεταβλητή της οποίας δε γνωρίζουμε με βεβαιότητα την τιμή (αντίθετα με τις ντετερμινιστικές μεταβλητές)

HMY 795: Αναγνώριση Προτύπων Διάλεξη 2 Επισκόπηση θεωρίας πιθανοτήτων Θεωρία πιθανοτήτων Τυχαία μεταβλητή: Μεταβλητή της οποίας δε γνωρίζουμε με βεβαιότητα την τιμή (αντίθετα με τις ντετερμινιστικές μεταβλητές)

4.3. Γραµµικοί ταξινοµητές

Γραµµικοί ταξινοµητές Γραµµικός ταξινοµητής είναι ένα σύστηµα ταξινόµησης που χρησιµοποιεί γραµµικές διακριτικές συναρτήσεις Οι ταξινοµητές αυτοί αναπαρίστανται συχνά µε οµάδες κόµβων εντός των οποίων

Γραµµικοί ταξινοµητές Γραµµικός ταξινοµητής είναι ένα σύστηµα ταξινόµησης που χρησιµοποιεί γραµµικές διακριτικές συναρτήσεις Οι ταξινοµητές αυτοί αναπαρίστανται συχνά µε οµάδες κόµβων εντός των οποίων

Σέργιος Θεοδωρίδης Κωνσταντίνος Κουτρούμπας. Version 2

Σέργιος Θεοδωρίδης Κωνσταντίνος Κουτρούμπας Verson ΧΑΡΤΟΓΡΑΦΗΣΗ ΤΟΥ ΧΩΡΟΥ ΤΩΝ ΤΑΞΙΝΟΜΗΤΩΝ Ταξινομητές Ταξινομητές συναρτ. διάκρισης Ταξινομητές επιφανειών απόφ. Παραμετρικοί ταξινομητές Μη παραμετρικοί

Σέργιος Θεοδωρίδης Κωνσταντίνος Κουτρούμπας Verson ΧΑΡΤΟΓΡΑΦΗΣΗ ΤΟΥ ΧΩΡΟΥ ΤΩΝ ΤΑΞΙΝΟΜΗΤΩΝ Ταξινομητές Ταξινομητές συναρτ. διάκρισης Ταξινομητές επιφανειών απόφ. Παραμετρικοί ταξινομητές Μη παραμετρικοί

Σέργιος Θεοδωρίδης Κωνσταντίνος Κουτρούμπας. Version 2

Σέργιος Θεοδωρίδης Κωνσταντίνος Κουτρούμπας Verson Σχεδιαζόντας ταξινομητές: Τα δεδομένα Στην πράξη η γνώση σχετικά διαδικασία γέννεσης των δεδομένων είναι πολύ σπάνια γνωστή. Το μόνο που έχουμε στη διάθεσή

Σέργιος Θεοδωρίδης Κωνσταντίνος Κουτρούμπας Verson Σχεδιαζόντας ταξινομητές: Τα δεδομένα Στην πράξη η γνώση σχετικά διαδικασία γέννεσης των δεδομένων είναι πολύ σπάνια γνωστή. Το μόνο που έχουμε στη διάθεσή

Το μοντέλο Perceptron

Το μοντέλο Perceptron Αποτελείται από έναν μόνο νευρώνα McCulloch-Pitts w j x x 1, x2,..., w x T 1 1 x 2 w 2 Σ u x n f(u) Άνυσμα Εισόδου s i x j x n w n -θ w w 1, w2,..., w n T Άνυσμα Βαρών 1 Το μοντέλο

Το μοντέλο Perceptron Αποτελείται από έναν μόνο νευρώνα McCulloch-Pitts w j x x 1, x2,..., w x T 1 1 x 2 w 2 Σ u x n f(u) Άνυσμα Εισόδου s i x j x n w n -θ w w 1, w2,..., w n T Άνυσμα Βαρών 1 Το μοντέλο

ΚΑΤΗΓΟΡΙΕΣ ΤΑΞΙΝΟΜΗΣΗΣ

ΚΑΤΗΓΟΡΙΕΣ ΤΑΞΙΝΟΜΗΣΗΣ Κατευθυνόμενη ταξινόμηση (supervsed cassfcaton) Μη-κατευθυνόμενη ταξινόμηση (unsupervsed cassfcaton) Γραμμική: Lnear Dscrmnant Anayss Μη- Γραμμική: Νευρωνικά δίκτυα κλπ. Ιεραρχική

ΚΑΤΗΓΟΡΙΕΣ ΤΑΞΙΝΟΜΗΣΗΣ Κατευθυνόμενη ταξινόμηση (supervsed cassfcaton) Μη-κατευθυνόμενη ταξινόμηση (unsupervsed cassfcaton) Γραμμική: Lnear Dscrmnant Anayss Μη- Γραμμική: Νευρωνικά δίκτυα κλπ. Ιεραρχική

Ακαδημαϊκό Έτος , Χειμερινό Εξάμηνο Διδάσκων Καθ.: Νίκος Τσαπατσούλης

ΠΑΝΕΠΙΣΤΗΜΙΟ ΠΕΛΟΠΟΝΝΗΣΟΥ, ΤΜΗΜΑ ΤΕΧΝΟΛΟΓΙΑΣ ΤΗΛΕΠΙΚΟΙΝΩΝΙΩΝ ΚΕΣ 3: ΑΝΑΓΝΩΡΙΣΗ ΠΡΟΤΥΠΩΝ ΚΑΙ ΑΝΑΛΥΣΗ ΕΙΚΟΝΑΣ Ακαδημαϊκό Έτος 7 8, Χειμερινό Εξάμηνο Καθ.: Νίκος Τσαπατσούλης ΕΡΩΤΗΣΕΙΣ ΕΠΑΝΑΛΗΨΗΣ Το παρόν

ΠΑΝΕΠΙΣΤΗΜΙΟ ΠΕΛΟΠΟΝΝΗΣΟΥ, ΤΜΗΜΑ ΤΕΧΝΟΛΟΓΙΑΣ ΤΗΛΕΠΙΚΟΙΝΩΝΙΩΝ ΚΕΣ 3: ΑΝΑΓΝΩΡΙΣΗ ΠΡΟΤΥΠΩΝ ΚΑΙ ΑΝΑΛΥΣΗ ΕΙΚΟΝΑΣ Ακαδημαϊκό Έτος 7 8, Χειμερινό Εξάμηνο Καθ.: Νίκος Τσαπατσούλης ΕΡΩΤΗΣΕΙΣ ΕΠΑΝΑΛΗΨΗΣ Το παρόν

Κινητά Δίκτυα Επικοινωνιών. Συμπληρωματικό υλικό. Προσαρμοστική Ισοστάθμιση Καναλιού

Κινητά Δίκτυα Επικοινωνιών Συμπληρωματικό υλικό Προσαρμοστική Ισοστάθμιση Καναλιού Προσαρμοστικοί Ισοσταθμιστές Για να υπολογίσουμε τους συντελεστές του ισοσταθμιστή MMSE, απαιτείται να λύσουμε ένα γραμμικό

Κινητά Δίκτυα Επικοινωνιών Συμπληρωματικό υλικό Προσαρμοστική Ισοστάθμιση Καναλιού Προσαρμοστικοί Ισοσταθμιστές Για να υπολογίσουμε τους συντελεστές του ισοσταθμιστή MMSE, απαιτείται να λύσουμε ένα γραμμικό

ΧΑΡΟΚΟΠΕΙΟ ΠΑΝΕΠΙΣΤΗΜΙΟ ΑΘΗΝΩΝ ΤΜΗΜΑ ΠΛΗΡΟΦΟΡΙΚΗΣ & ΤΗΛΕΜΑΤΙΚΗΣ ΤΕΧΝΗΤΗ ΝΟΗΜΟΣΥΝΗ ΝΕΥΡΩΝΙΚΑ ΔΙΚΤΥΑ. Καραγιώργου Σοφία

ΧΑΡΟΚΟΠΕΙΟ ΠΑΝΕΠΙΣΤΗΜΙΟ ΑΘΗΝΩΝ ΤΜΗΜΑ ΠΛΗΡΟΦΟΡΙΚΗΣ & ΤΗΛΕΜΑΤΙΚΗΣ ΤΕΧΝΗΤΗ ΝΟΗΜΟΣΥΝΗ ΝΕΥΡΩΝΙΚΑ ΔΙΚΤΥΑ Καραγιώργου Σοφία Εισαγωγή Προσομοιώνει βιολογικές διεργασίες (π.χ. λειτουργία του εγκεφάλου, διαδικασία

ΧΑΡΟΚΟΠΕΙΟ ΠΑΝΕΠΙΣΤΗΜΙΟ ΑΘΗΝΩΝ ΤΜΗΜΑ ΠΛΗΡΟΦΟΡΙΚΗΣ & ΤΗΛΕΜΑΤΙΚΗΣ ΤΕΧΝΗΤΗ ΝΟΗΜΟΣΥΝΗ ΝΕΥΡΩΝΙΚΑ ΔΙΚΤΥΑ Καραγιώργου Σοφία Εισαγωγή Προσομοιώνει βιολογικές διεργασίες (π.χ. λειτουργία του εγκεφάλου, διαδικασία

HMY 795: Αναγνώριση Προτύπων

HMY 795: Αναγνώριση Προτύπων Διάλεξη 2 Επισκόπηση θεωρίας πιθανοτήτων Τυχαίες μεταβλητές: Βασικές έννοιες Τυχαία μεταβλητή: Μεταβλητή της οποίας δε γνωρίζουμε με βεβαιότητα την τιμή (σε αντίθεση με τις

HMY 795: Αναγνώριση Προτύπων Διάλεξη 2 Επισκόπηση θεωρίας πιθανοτήτων Τυχαίες μεταβλητές: Βασικές έννοιες Τυχαία μεταβλητή: Μεταβλητή της οποίας δε γνωρίζουμε με βεβαιότητα την τιμή (σε αντίθεση με τις

Νευρωνικά ίκτυα και Εξελικτικός. Σηµερινό Μάθηµα. επανάληψη Γενετικών Αλγορίθµων 1 η εργασία Επανάληψη νευρωνικών δικτύων Ασκήσεις εφαρµογές

Νευρωνικά ίκτυα και Εξελικτικός Προγραµµατισµός Σηµερινό Μάθηµα επανάληψη Γενετικών Αλγορίθµων η εργασία Επανάληψη νευρωνικών δικτύων Ασκήσεις εφαρµογές Κωδικοποίηση Αντικειµενική Συνάρτ Αρχικοποίηση Αξιολόγηση

Νευρωνικά ίκτυα και Εξελικτικός Προγραµµατισµός Σηµερινό Μάθηµα επανάληψη Γενετικών Αλγορίθµων η εργασία Επανάληψη νευρωνικών δικτύων Ασκήσεις εφαρµογές Κωδικοποίηση Αντικειµενική Συνάρτ Αρχικοποίηση Αξιολόγηση

Αναγνώριση Προτύπων Ι

Αναγνώριση Προτύπων Ι Ενότητα 3: Στοχαστικά Συστήματα Αν. Καθηγητής Δερματάς Ευάγγελος Τμήμα Ηλεκτρολόγων Μηχανικών και Τεχνολογίας Υπολογιστών Άδειες Χρήσης Το παρόν εκπαιδευτικό υλικό υπόκειται σε άδειες

Αναγνώριση Προτύπων Ι Ενότητα 3: Στοχαστικά Συστήματα Αν. Καθηγητής Δερματάς Ευάγγελος Τμήμα Ηλεκτρολόγων Μηχανικών και Τεχνολογίας Υπολογιστών Άδειες Χρήσης Το παρόν εκπαιδευτικό υλικό υπόκειται σε άδειες

ΤΕΙ ΣΕΡΡΩΝ ΤΜΗΜΑ ΠΛΗΡΟΦΟΡΙΚΗΣ ΚΑΙ ΕΠΙΚΟΙΝΩΝΙΩΝ ΕΞΕΤΑΣΗ ΣΤΟ ΜΑΘΗΜΑ «ΑΝΑΓΝΩΡΙΣΗ ΠΡΟΤΥΠΩΝ ΝΕΥΡΩΝΙΚΑ ΔΙΚΤΥΑ» ΠΑ. 7 ΣΕΠΤΕΜΒΡΙΟΥ 2012

ΠΑ. 7 ΣΕΠΤΕΜΒΡΙΟΥ Δίνονται τα εξής πρότυπα: [ ] [ ] [ ] [ ] Άσκηση η (3 μονάδες) Χρησιμοποιώντας το κριτήριο της ομοιότητας να απορριφθεί ένα χαρακτηριστικό με βάση το συντελεστή συσχέτισης. (γράψτε ποιο

ΠΑ. 7 ΣΕΠΤΕΜΒΡΙΟΥ Δίνονται τα εξής πρότυπα: [ ] [ ] [ ] [ ] Άσκηση η (3 μονάδες) Χρησιμοποιώντας το κριτήριο της ομοιότητας να απορριφθεί ένα χαρακτηριστικό με βάση το συντελεστή συσχέτισης. (γράψτε ποιο

ΤΜΗΜΑ ΔΙΟΙΚΗΣΗΣ ΕΠΙΧΕΙΡΗΣΕΩΝ

ΤΕΙ Δυτικής Μακεδονίας ΤΜΗΜΑ ΔΙΟΙΚΗΣΗΣ ΕΠΙΧΕΙΡΗΣΕΩΝ 2015-2016 Τεχνητή Νοημοσύνη Νευρώνας Perceptron Διδάσκων: Τσίπουρας Μάρκος Εκπαιδευτικό Υλικό: Τσίπουρας Μάρκος Τζώρτζης Γρηγόρης Περιεχόμενα Εισαγωγή

ΤΕΙ Δυτικής Μακεδονίας ΤΜΗΜΑ ΔΙΟΙΚΗΣΗΣ ΕΠΙΧΕΙΡΗΣΕΩΝ 2015-2016 Τεχνητή Νοημοσύνη Νευρώνας Perceptron Διδάσκων: Τσίπουρας Μάρκος Εκπαιδευτικό Υλικό: Τσίπουρας Μάρκος Τζώρτζης Γρηγόρης Περιεχόμενα Εισαγωγή

ΤΕΙ ΣΕΡΡΩΝ ΤΜΗΜΑ ΠΛΗΡΟΦΟΡΙΚΗΣ ΚΑΙ ΕΠΙΚΟΙΝΩΝΙΩΝ ΕΞΕΤΑΣΗ ΣΤΟ ΜΑΘΗΜΑ «ΑΝΑΓΝΩΡΙΣΗ ΠΡΟΤΥΠΩΝ ΝΕΥΡΩΝΙΚΑ ΔΙΚΤΥΑ» ΔΕ. 11 ΙΟΥΝΙΟΥ 2012

ΔΕ. ΙΟΥΝΙΟΥ Δίνονται τα εξής πρότυπα: [ ] [ ] [ ] [ ] Άσκηση η ( μονάδες) Χρησιμοποιώντας το κριτήριο της ομοιότητας να απορριφθεί ένα χαρακτηριστικό με βάσει το συντελεστή συσχέτισης. (γράψτε ποιο χαρακτηριστικό

ΔΕ. ΙΟΥΝΙΟΥ Δίνονται τα εξής πρότυπα: [ ] [ ] [ ] [ ] Άσκηση η ( μονάδες) Χρησιμοποιώντας το κριτήριο της ομοιότητας να απορριφθεί ένα χαρακτηριστικό με βάσει το συντελεστή συσχέτισης. (γράψτε ποιο χαρακτηριστικό

Δρ. Βασίλειος Γ. Καμπουρλάζος Δρ. Ανέστης Γ. Χατζημιχαηλίδης

Μάθημα 4 ο Δρ. Ανέστης Γ. Χατζημιχαηλίδης Τμήμα Μηχανικών Πληροφορικής Τ.Ε. ΤΕΙ Ανατολικής Μακεδονίας και Θράκης 2016-2017 Διευρυμένη Υπολογιστική Νοημοσύνη (ΥΝ) Επεκτάσεις της Κλασικής ΥΝ. Μεθοδολογίες

Μάθημα 4 ο Δρ. Ανέστης Γ. Χατζημιχαηλίδης Τμήμα Μηχανικών Πληροφορικής Τ.Ε. ΤΕΙ Ανατολικής Μακεδονίας και Θράκης 2016-2017 Διευρυμένη Υπολογιστική Νοημοσύνη (ΥΝ) Επεκτάσεις της Κλασικής ΥΝ. Μεθοδολογίες

Αναγνώριση Προτύπων Ι

Αναγνώριση Προτύπων Ι Ενότητα 1: Μέθοδοι Αναγνώρισης Προτύπων Αν. Καθηγητής Δερματάς Ευάγγελος Τμήμα Ηλεκτρολόγων Μηχανικών και Τεχνολογίας Υπολογιστών Άδειες Χρήσης Το παρόν εκπαιδευτικό υλικό υπόκειται

Αναγνώριση Προτύπων Ι Ενότητα 1: Μέθοδοι Αναγνώρισης Προτύπων Αν. Καθηγητής Δερματάς Ευάγγελος Τμήμα Ηλεκτρολόγων Μηχανικών και Τεχνολογίας Υπολογιστών Άδειες Χρήσης Το παρόν εκπαιδευτικό υλικό υπόκειται

Σέργιος Θεοδωρίδης Κωνσταντίνος Κουτρούμπας. Version 2

Σέργιος Θεοδωρίδης Κωνσταντίνος Κουτρούμπας Verson Μέθοδοι ελαχίστων τετραγώνων Least square methos Αν οι κλάσεις είναι γραμμικώς διαχωρίσιμες το perceptron θα δώσει σαν έξοδο ± Αν οι κλάσεις ΔΕΝ είναι

Σέργιος Θεοδωρίδης Κωνσταντίνος Κουτρούμπας Verson Μέθοδοι ελαχίστων τετραγώνων Least square methos Αν οι κλάσεις είναι γραμμικώς διαχωρίσιμες το perceptron θα δώσει σαν έξοδο ± Αν οι κλάσεις ΔΕΝ είναι

HMY 795: Αναγνώριση Προτύπων

HMY 795: Αναγνώριση Προτύπων Διαλέξεις 7 8 Μπεϋζιανή εκτίμηση συνέχεια Μη παραμετρικές μέθοδοι εκτίμησης πυκνότητας Εκτίμηση ML για την κανονική κατανομή Μπεϋζιανή εκτίμηση για την κανονική κατανομή Γνωστή

HMY 795: Αναγνώριση Προτύπων Διαλέξεις 7 8 Μπεϋζιανή εκτίμηση συνέχεια Μη παραμετρικές μέθοδοι εκτίμησης πυκνότητας Εκτίμηση ML για την κανονική κατανομή Μπεϋζιανή εκτίμηση για την κανονική κατανομή Γνωστή

HMY 799 1: Αναγνώριση Συστημάτων

HMY 799 : Αναγνώριση Συστημάτων Διάλεξη Γραμμική παλινδρόμηση (Linear regression) Εμπειρική συνάρτηση μεταφοράς Ομαλοποίηση (smoothing) Y ( ) ( ) ω G ω = U ( ω) ω +Δ ω γ ω Δω = ω +Δω W ( ξ ω ) U ( ξ) G(

HMY 799 : Αναγνώριση Συστημάτων Διάλεξη Γραμμική παλινδρόμηση (Linear regression) Εμπειρική συνάρτηση μεταφοράς Ομαλοποίηση (smoothing) Y ( ) ( ) ω G ω = U ( ω) ω +Δ ω γ ω Δω = ω +Δω W ( ξ ω ) U ( ξ) G(

Υπολογιστική Νοημοσύνη. Μάθημα 6: Μάθηση με Οπισθοδιάδοση Σφάλματος Backpropagation Learning

Υπολογιστική Νοημοσύνη Μάθημα 6: Μάθηση με Οπισθοδιάδοση Σφάλματος Backpropagation Learning Κεντρική ιδέα Τα παραδείγματα μάθησης παρουσιάζονται στο μηεκπαιδευμένο δίκτυο και υπολογίζονται οι έξοδοι. Για

Υπολογιστική Νοημοσύνη Μάθημα 6: Μάθηση με Οπισθοδιάδοση Σφάλματος Backpropagation Learning Κεντρική ιδέα Τα παραδείγματα μάθησης παρουσιάζονται στο μηεκπαιδευμένο δίκτυο και υπολογίζονται οι έξοδοι. Για

ΔΗΜΟΚΡΙΤΕΙΟ ΠΑΝΕΠΙΣΤΗΜΙΟ ΘΡΑΚΗΣ Τμήμα Επιστήμης Φυσικής Αγωγής και Αθλητισμού Πρόγραμμα Διδακτορικών Σπουδών ΠΛΗΡΟΦΟΡΙΑΚΟ ΕΝΤΥΠΟ ΜΑΘΗΜΑΤΟΣ

ΔΗΜΟΚΡΙΤΕΙΟ ΠΑΝΕΠΙΣΤΗΜΙΟ ΘΡΑΚΗΣ Τμήμα Επιστήμης Φυσικής Αγωγής και Αθλητισμού Πρόγραμμα Διδακτορικών Σπουδών ΠΛΗΡΟΦΟΡΙΑΚΟ ΕΝΤΥΠΟ ΜΑΘΗΜΑΤΟΣ 1. ΤΙΤΛΟΣ ΜΑΘΗΜΑΤΟΣ: Προχωρημένη Στατιστική 2. ΠΕΡΙΓΡΑΜΜΑ ΕΙΣΗΓΗΣΕΩΝ

ΔΗΜΟΚΡΙΤΕΙΟ ΠΑΝΕΠΙΣΤΗΜΙΟ ΘΡΑΚΗΣ Τμήμα Επιστήμης Φυσικής Αγωγής και Αθλητισμού Πρόγραμμα Διδακτορικών Σπουδών ΠΛΗΡΟΦΟΡΙΑΚΟ ΕΝΤΥΠΟ ΜΑΘΗΜΑΤΟΣ 1. ΤΙΤΛΟΣ ΜΑΘΗΜΑΤΟΣ: Προχωρημένη Στατιστική 2. ΠΕΡΙΓΡΑΜΜΑ ΕΙΣΗΓΗΣΕΩΝ

ΕΚΤΙΜΙΣΗ ΜΕΓΙΣΤΗΣ ΠΙΘΑΝΟΦΑΝΕΙΑΣ

3.1 Εισαγωγή ΕΚΤΙΜΙΣΗ ΜΕΓΙΣΤΗΣ ΠΙΘΑΝΟΦΑΝΕΙΑΣ Στο κεφ. 2 είδαμε πώς θα μπορούσαμε να σχεδιάσουμε έναν βέλτιστο ταξινομητή εάν ξέραμε τις προγενέστερες(prior) πιθανότητες ( ) και τις κλάση-υπό όρους πυκνότητες

3.1 Εισαγωγή ΕΚΤΙΜΙΣΗ ΜΕΓΙΣΤΗΣ ΠΙΘΑΝΟΦΑΝΕΙΑΣ Στο κεφ. 2 είδαμε πώς θα μπορούσαμε να σχεδιάσουμε έναν βέλτιστο ταξινομητή εάν ξέραμε τις προγενέστερες(prior) πιθανότητες ( ) και τις κλάση-υπό όρους πυκνότητες

ΒΑΣΙΚΕΣ ΕΝΝΟΙΕΣ ΚΑΙ ΜΑΘΗΜΑΤΙΚΗ ΔΙΑΤΥΠΩΣΗ, Διαλ. 2. Ανωτάτη Σχολή Παιδαγωγικής και Τεχνολογικής Εκπαίδευσης 8/4/2017

ΒΑΣΙΚΕΣ ΕΝΝΟΙΕΣ ΚΑΙ ΜΑΘΗΜΑΤΙΚΗ ΔΙΑΤΥΠΩΣΗ, Διαλ. 2 Ανωτάτη Σχολή Παιδαγωγικής και Τεχνολογικής Εκπαίδευσης 8/4/2017 Αντικειμενικοί στόχοι Η μελέτη των βασικών στοιχείων που συνθέτουν ένα πρόβλημα βελτιστοποίησης

ΒΑΣΙΚΕΣ ΕΝΝΟΙΕΣ ΚΑΙ ΜΑΘΗΜΑΤΙΚΗ ΔΙΑΤΥΠΩΣΗ, Διαλ. 2 Ανωτάτη Σχολή Παιδαγωγικής και Τεχνολογικής Εκπαίδευσης 8/4/2017 Αντικειμενικοί στόχοι Η μελέτη των βασικών στοιχείων που συνθέτουν ένα πρόβλημα βελτιστοποίησης

HMY 220: Σήματα και Συστήματα Ι

Σύγκλιση Σειρών Fourier Ιδιότητες Σειρών Fourier Παραδείγματα HMY 0: Σήματα και Συστήματα Ι ΔΙΑΛΕΞΗ #10 Σειρές Fourier: Προσέγγιση Οι Σειρές Fourier μπορούν να αναπαραστήσουν μια πολύ μεγάλη κλάση περιοδικών

Σύγκλιση Σειρών Fourier Ιδιότητες Σειρών Fourier Παραδείγματα HMY 0: Σήματα και Συστήματα Ι ΔΙΑΛΕΞΗ #10 Σειρές Fourier: Προσέγγιση Οι Σειρές Fourier μπορούν να αναπαραστήσουν μια πολύ μεγάλη κλάση περιοδικών

Εκπαίδευση ΤΝΔ με ελαχιστοποίηση του τετραγωνικού σφάλματος εκπαίδευσης. "Τεχνητά Νευρωνικά Δίκτυα" (Διαφάνειες), Α. Λύκας, Παν.

Εκπαίδευση ΤΝΔ με ελαχιστοποίηση του τετραγωνικού σφάλματος εκπαίδευσης Ελαχιστοποίηση συνάρτησης σφάλματος Εκπαίδευση ΤΝΔ: μπορεί να διατυπωθεί ως πρόβλημα ελαχιστοποίησης μιας συνάρτησης σφάλματος E(w)

Εκπαίδευση ΤΝΔ με ελαχιστοποίηση του τετραγωνικού σφάλματος εκπαίδευσης Ελαχιστοποίηση συνάρτησης σφάλματος Εκπαίδευση ΤΝΔ: μπορεί να διατυπωθεί ως πρόβλημα ελαχιστοποίησης μιας συνάρτησης σφάλματος E(w)

HMY 795: Αναγνώριση Προτύπων

HMY 795: Αναγνώριση Προτύπων Διαλέξεις 2-22 Support vector machies (συνέχεια) Support vector machies (συνέχεια) Usupervised learig: Clusterig ad Gaussia mixtures Kerel fuctios: k( xx, ') = ϕ ( x) ϕ( x

HMY 795: Αναγνώριση Προτύπων Διαλέξεις 2-22 Support vector machies (συνέχεια) Support vector machies (συνέχεια) Usupervised learig: Clusterig ad Gaussia mixtures Kerel fuctios: k( xx, ') = ϕ ( x) ϕ( x

Ασκήσεις Φροντιστηρίου «Υπολογιστική Νοημοσύνη Ι» 5 o Φροντιστήριο

Πρόβλημα ο Ασκήσεις Φροντιστηρίου 5 o Φροντιστήριο Δίνεται το παρακάτω σύνολο εκπαίδευσης: # Είσοδος Κατηγορία 0 0 0 Α 2 0 0 Α 0 Β 4 0 0 Α 5 0 Β 6 0 0 Α 7 0 Β 8 Β α) Στον παρακάτω κύβο τοποθετείστε τα

Πρόβλημα ο Ασκήσεις Φροντιστηρίου 5 o Φροντιστήριο Δίνεται το παρακάτω σύνολο εκπαίδευσης: # Είσοδος Κατηγορία 0 0 0 Α 2 0 0 Α 0 Β 4 0 0 Α 5 0 Β 6 0 0 Α 7 0 Β 8 Β α) Στον παρακάτω κύβο τοποθετείστε τα

Υπολογιστική Νοημοσύνη. Μάθημα 13: Αναδρομικά Δίκτυα - Recurrent Networks

Υπολογιστική Νοημοσύνη Μάθημα 13: Αναδρομικά Δίκτυα - Recurrent Networks Γενικά Ένα νευρωνικό δίκτυο λέγεται αναδρομικό, εάν υπάρχει έστω και μια σύνδεση από έναν νευρώνα επιπέδου i προς έναν νευρώνα επιπέδου

Υπολογιστική Νοημοσύνη Μάθημα 13: Αναδρομικά Δίκτυα - Recurrent Networks Γενικά Ένα νευρωνικό δίκτυο λέγεται αναδρομικό, εάν υπάρχει έστω και μια σύνδεση από έναν νευρώνα επιπέδου i προς έναν νευρώνα επιπέδου

HMY 795: Αναγνώριση Προτύπων

HMY 795: Αναγνώριση Προτύπων Διαλέξεις 5 6 Principal component analysis EM for Gaussian mixtures: μ k, Σ k, π k. Ορίζουμε το διάνυσμα z (διάσταση Κ) ώστε K p( x θ) = π ( x μ, Σ ) k = k k k Eκ των υστέρων

HMY 795: Αναγνώριση Προτύπων Διαλέξεις 5 6 Principal component analysis EM for Gaussian mixtures: μ k, Σ k, π k. Ορίζουμε το διάνυσμα z (διάσταση Κ) ώστε K p( x θ) = π ( x μ, Σ ) k = k k k Eκ των υστέρων

Υπολογιστική Νοημοσύνη. Μάθημα 4: Μάθηση στον απλό τεχνητό νευρώνα (2)

Υπολογιστική Νοημοσύνη Μάθημα 4: Μάθηση στον απλό τεχνητό νευρώνα (2) Ο κανόνας Δέλτα για συνεχείς συναρτήσεις ενεργοποίησης (1/2) Για συνεχείς συναρτήσεις ενεργοποίησης, θα θέλαμε να αλλάξουμε περισσότερο

Υπολογιστική Νοημοσύνη Μάθημα 4: Μάθηση στον απλό τεχνητό νευρώνα (2) Ο κανόνας Δέλτα για συνεχείς συναρτήσεις ενεργοποίησης (1/2) Για συνεχείς συναρτήσεις ενεργοποίησης, θα θέλαμε να αλλάξουμε περισσότερο

3. O ΑΛΓΟΡΙΘΜΟΣ ΤΟΥ PERCEPTRON

3. O ΑΛΓΟΡΙΘΜΟΣ ΤΟΥ PERCEPRON 3. ΕΙΣΑΓΩΓΗ: Το Perceptron είναι η απλούστερη μορφή Νευρωνικού δικτύου, το οποίο χρησιμοποιείται για την ταξινόμηση ενός ειδικού τύπου προτύπων, που είναι γραμμικά διαχωριζόμενα.

3. O ΑΛΓΟΡΙΘΜΟΣ ΤΟΥ PERCEPRON 3. ΕΙΣΑΓΩΓΗ: Το Perceptron είναι η απλούστερη μορφή Νευρωνικού δικτύου, το οποίο χρησιμοποιείται για την ταξινόμηση ενός ειδικού τύπου προτύπων, που είναι γραμμικά διαχωριζόμενα.

ΟΙΚΟΝΟΜΕΤΡΙΑ. Παπάνα Αγγελική

ΟΙΚΟΝΟΜΕΤΡΙΑ Ενότητα 13: Επανάληψη Παπάνα Αγγελική Μεταδιδακτορική ερευνήτρια, ΑΠΘ E-mail: angeliki.papana@gmail.com, agpapana@auth.gr Webpage: http://users.auth.gr/agpapana 1 Γιατί μελετούμε την Οικονομετρία;

ΟΙΚΟΝΟΜΕΤΡΙΑ Ενότητα 13: Επανάληψη Παπάνα Αγγελική Μεταδιδακτορική ερευνήτρια, ΑΠΘ E-mail: angeliki.papana@gmail.com, agpapana@auth.gr Webpage: http://users.auth.gr/agpapana 1 Γιατί μελετούμε την Οικονομετρία;

HMY 220: Σήματα και Συστήματα Ι

Σύγκλιση Σειρών Fourier Ιδιότητες Σειρών Fourier Παραδείγματα HMY 220: Σήματα και Συστήματα Ι ΔΙΑΛΕΞΗ #10 Τρεις ισοδύναμες μορφές: () = = = = Σειρές Fourier j( 2π ) t Τ.. x () t FS a jω0t xt () = ae =

Σύγκλιση Σειρών Fourier Ιδιότητες Σειρών Fourier Παραδείγματα HMY 220: Σήματα και Συστήματα Ι ΔΙΑΛΕΞΗ #10 Τρεις ισοδύναμες μορφές: () = = = = Σειρές Fourier j( 2π ) t Τ.. x () t FS a jω0t xt () = ae =

HMY 795: Αναγνώριση Προτύπων. Διαλέξεις 9-10

HMY 795: Αναγνώριση Προτύπων Διαλέξεις 9-10 Γραμμική παλινδρόμηση (Linear regression) Μπεϋζιανή εκτίμηση για την κανονική κατανομή Γνωστή μέση τιμή μ, άγνωστη διασπορά σ 2. Ακρίβεια λ=1/σ 2 : conjugate

HMY 795: Αναγνώριση Προτύπων Διαλέξεις 9-10 Γραμμική παλινδρόμηση (Linear regression) Μπεϋζιανή εκτίμηση για την κανονική κατανομή Γνωστή μέση τιμή μ, άγνωστη διασπορά σ 2. Ακρίβεια λ=1/σ 2 : conjugate

Υπολογιστική Νοημοσύνη. Μάθημα 12: Παραδείγματα Ασκήσεων 2

Υπολογιστική Νοημοσύνη Μάθημα 12: Παραδείγματα Ασκήσεων 2 Δίκτυα Πολλών Επιπέδων Με μη γραμμικούς νευρώνες Έστω ένα πρόβλημα κατηγοριοποίησης, με δύο βαθμούς ελευθερίας (x, y) και δύο κατηγορίες (A, B).

Υπολογιστική Νοημοσύνη Μάθημα 12: Παραδείγματα Ασκήσεων 2 Δίκτυα Πολλών Επιπέδων Με μη γραμμικούς νευρώνες Έστω ένα πρόβλημα κατηγοριοποίησης, με δύο βαθμούς ελευθερίας (x, y) και δύο κατηγορίες (A, B).

3 η ΕΝΟΤΗΤΑ ΜΗ ΓΡΑΜΜΙΚΟΣ ΠΡΟΓΡΑΜΜΑΤΙΣΜΟΣ ΒΕΛΤΙΣΤΟΠΟΙΗΣΗ ΕΝΟΣ ΚΡΙΤΗΡΙΟΥ

ΣΧΟΛΗ ΠΟΛΙΤΙΚΩΝ ΜΗΧΑΝΙΚΩΝ ΕΜΠ ΕΙΣΑΓΩΓΗ ΣΤΗN ΒΕΛΤΙΣΤΟΠΟΙΗΣΗ ΣΥΣΤΗΜΑΤΩΝ 3 η ΕΝΟΤΗΤΑ ΜΗ ΓΡΑΜΜΙΚΟΣ ΠΡΟΓΡΑΜΜΑΤΙΣΜΟΣ ΒΕΛΤΙΣΤΟΠΟΙΗΣΗ ΕΝΟΣ ΚΡΙΤΗΡΙΟΥ Μ. Καρλαύτης Ν. Λαγαρός Άδεια Χρήσης Το παρόν εκπαιδευτικό υλικό

ΣΧΟΛΗ ΠΟΛΙΤΙΚΩΝ ΜΗΧΑΝΙΚΩΝ ΕΜΠ ΕΙΣΑΓΩΓΗ ΣΤΗN ΒΕΛΤΙΣΤΟΠΟΙΗΣΗ ΣΥΣΤΗΜΑΤΩΝ 3 η ΕΝΟΤΗΤΑ ΜΗ ΓΡΑΜΜΙΚΟΣ ΠΡΟΓΡΑΜΜΑΤΙΣΜΟΣ ΒΕΛΤΙΣΤΟΠΟΙΗΣΗ ΕΝΟΣ ΚΡΙΤΗΡΙΟΥ Μ. Καρλαύτης Ν. Λαγαρός Άδεια Χρήσης Το παρόν εκπαιδευτικό υλικό

Εισαγωγικές έννοιες. Κατηγορίες προβλημάτων (σε μια διάσταση) Προβλήματα εύρεσης μεγίστου. Συμβολισμοί

Κατηγορίες προβλημάτων (σε μια διάσταση) Εισαγωγικές έννοιες Δ. Γ. Παπαγεωργίου Τμήμα Μηχανικών Επιστήμης Υλικών Πανεπιστήμιο Ιωαννίνων dpapageo@cc.uoi.gr http://pc164.materials.uoi.gr/dpapageo Το πρόβλημα

Κατηγορίες προβλημάτων (σε μια διάσταση) Εισαγωγικές έννοιες Δ. Γ. Παπαγεωργίου Τμήμα Μηχανικών Επιστήμης Υλικών Πανεπιστήμιο Ιωαννίνων dpapageo@cc.uoi.gr http://pc164.materials.uoi.gr/dpapageo Το πρόβλημα

Εισόδημα Κατανάλωση 1500 500 1600 600 1300 450 1100 400 600 250 700 275 900 300 800 352 850 400 1100 500

Εισόδημα Κατανάλωση 1500 500 1600 600 1300 450 1100 400 600 250 700 275 900 300 800 352 850 400 1100 500 Πληθυσμός Δείγμα Δείγμα Δείγμα Ο ρόλος της Οικονομετρίας Οικονομική Θεωρία Διατύπωση της

Εισόδημα Κατανάλωση 1500 500 1600 600 1300 450 1100 400 600 250 700 275 900 300 800 352 850 400 1100 500 Πληθυσμός Δείγμα Δείγμα Δείγμα Ο ρόλος της Οικονομετρίας Οικονομική Θεωρία Διατύπωση της

Αναγνώριση Προτύπων (Pattern Recognition) Μπεϋζιανή Θεωρία Αποφάσεων (Bayesian Decision Theory) Π. Τσακαλίδης

Αναγνώριση Προτύπων (Pattern Recognton Μπεϋζιανή Θεωρία Αποφάσεων (Bayesan Decson Theory Π. Τσακαλίδης ΠΑΝΕΠΙΣΤΗΜΙΟ ΚΡΗΤΗΣ ΤΜΗΜΑ ΕΠΙΣΤΗΜΗΣ ΥΠΟΛΟΓΙΣΤΩΝ Μπεϋζιανή Θεωρία Αποφάσεων (Bayes Decson theory Στατιστικά

Αναγνώριση Προτύπων (Pattern Recognton Μπεϋζιανή Θεωρία Αποφάσεων (Bayesan Decson Theory Π. Τσακαλίδης ΠΑΝΕΠΙΣΤΗΜΙΟ ΚΡΗΤΗΣ ΤΜΗΜΑ ΕΠΙΣΤΗΜΗΣ ΥΠΟΛΟΓΙΣΤΩΝ Μπεϋζιανή Θεωρία Αποφάσεων (Bayes Decson theory Στατιστικά

Θεωρία Αποφάσεων ο. 4 Φροντιστήριο. Λύσεις των Ασκήσεων

Θεωρία Αποφάσεων ο Φροντιστήριο Λύσεις των Ασκήσεων Άσκηση Έστω ένα πρόβλημα ταξινόμησης μιας διάστασης με δύο κατηγορίες, όπου για κάθε κατηγορία έχουν συλλεχθεί τα παρακάτω δεδομένα: D = {, 2,,,,7 }

Θεωρία Αποφάσεων ο Φροντιστήριο Λύσεις των Ασκήσεων Άσκηση Έστω ένα πρόβλημα ταξινόμησης μιας διάστασης με δύο κατηγορίες, όπου για κάθε κατηγορία έχουν συλλεχθεί τα παρακάτω δεδομένα: D = {, 2,,,,7 }

Πληροφοριακά Συστήματα & Περιβάλλον

ΑΡΙΣΤΟΤΕΛΕΙΟ ΠΑΝΕΠΙΣΤΗΜΙΟ ΘΕΣΣΑΛΟΝΙΚΗΣ ΑΝΟΙΧΤΑ ΑΚΑΔΗΜΑΙΚΑ ΜΑΘΗΜΑΤΑ Πληροφοριακά Συστήματα & Περιβάλλον Ενότητα 8: Τεχνητά Νευρωνικά Δίκτυα Παναγιώτης Λεφάκης Δασολογίας & Φυσικού Περιβάλλοντος Άδειες Χρήσης

ΑΡΙΣΤΟΤΕΛΕΙΟ ΠΑΝΕΠΙΣΤΗΜΙΟ ΘΕΣΣΑΛΟΝΙΚΗΣ ΑΝΟΙΧΤΑ ΑΚΑΔΗΜΑΙΚΑ ΜΑΘΗΜΑΤΑ Πληροφοριακά Συστήματα & Περιβάλλον Ενότητα 8: Τεχνητά Νευρωνικά Δίκτυα Παναγιώτης Λεφάκης Δασολογίας & Φυσικού Περιβάλλοντος Άδειες Χρήσης

ΤΕΙ ΔΥΤΙΚΗΣ ΜΑΚΕΔΟΝΙΑΣ Μεταπτυχιακό Τραπεζικής & Χρηματοοικονομικής

ΤΕΙ ΔΥΤΙΚΗΣ ΜΑΚΕΔΟΝΙΑΣ Μεταπτυχιακό Τραπεζικής & Χρηματοοικονομικής Υποθέσεις του Απλού γραμμικού υποδείγματος της Παλινδρόμησης Η μεταβλητή ε t (διαταρακτικός όρος) είναι τυχαία μεταβλητή με μέσο όρο

ΤΕΙ ΔΥΤΙΚΗΣ ΜΑΚΕΔΟΝΙΑΣ Μεταπτυχιακό Τραπεζικής & Χρηματοοικονομικής Υποθέσεις του Απλού γραμμικού υποδείγματος της Παλινδρόμησης Η μεταβλητή ε t (διαταρακτικός όρος) είναι τυχαία μεταβλητή με μέσο όρο

HMY 429: Εισαγωγή στην Επεξεργασία Ψηφιακών Σημάτων. Διάλεξη 20: Διακριτός Μετασχηματισμός Fourier (Discrete Fourier Transform DFT)

HMY 429: Εισαγωγή στην Επεξεργασία Ψηφιακών Σημάτων Διάλεξη 20: Διακριτός Μετασχηματισμός Fourier (Discrete Fourier Transform DFT) Εισαγωγή Μέχρι στιγμής έχουμε δει το Μετασχηματισμό Fourier Διακριτού

HMY 429: Εισαγωγή στην Επεξεργασία Ψηφιακών Σημάτων Διάλεξη 20: Διακριτός Μετασχηματισμός Fourier (Discrete Fourier Transform DFT) Εισαγωγή Μέχρι στιγμής έχουμε δει το Μετασχηματισμό Fourier Διακριτού

Πληροφοριακά Συστήματα Διοίκησης

Πληροφοριακά Συστήματα Διοίκησης Τρεις αλγόριθμοι μηχανικής μάθησης ΠΜΣ Λογιστική Χρηματοοικονομική και Διοικητική Επιστήμη ΤΕΙ Ηπείρου @ 2018 Μηχανική μάθηση αναγνώριση προτύπων Η αναγνώριση προτύπων

Πληροφοριακά Συστήματα Διοίκησης Τρεις αλγόριθμοι μηχανικής μάθησης ΠΜΣ Λογιστική Χρηματοοικονομική και Διοικητική Επιστήμη ΤΕΙ Ηπείρου @ 2018 Μηχανική μάθηση αναγνώριση προτύπων Η αναγνώριση προτύπων

1. Τετραγωνικές μορφές. x y 0. 0x y 0 1α 1β 2α 2β 3. 0x + y 0

Β4. ΕΣΣΙΑΝΟΣ ΠΙΝΑΚΑΣ-ΚΥΡΤΟΤΗΤΑ 1.Τετραγωνικές μορφές.χαρακτηρισμός συμμετρικών πινάκων 3.Δεύτερες μερικές παράγωγοι-εσσιανός πίνακας 4.Συνθήκες για ακρότατα 5.Κυρτές/κοίλες συναρτήσεις 6.Ολικά ακρότατα

Β4. ΕΣΣΙΑΝΟΣ ΠΙΝΑΚΑΣ-ΚΥΡΤΟΤΗΤΑ 1.Τετραγωνικές μορφές.χαρακτηρισμός συμμετρικών πινάκων 3.Δεύτερες μερικές παράγωγοι-εσσιανός πίνακας 4.Συνθήκες για ακρότατα 5.Κυρτές/κοίλες συναρτήσεις 6.Ολικά ακρότατα

ΕΥΦΥΗΣ ΕΛΕΓΧΟΣ. Ενότητα #8: Βελτιστοποίηση Συστημάτων Ασαφούς Λογικής. Αναστάσιος Ντούνης Τμήμα Μηχανικών Αυτοματισμού Τ.Ε.

ΕΛΛΗΝΙΚΗ ΔΗΜΟΚΡΑΤΙΑ Ανώτατο Εκπαιδευτικό Ίδρυμα Πειραιά Τεχνολογικού Τομέα ΕΥΦΥΗΣ ΕΛΕΓΧΟΣ Ενότητα #8: Βελτιστοποίηση Συστημάτων Ασαφούς Λογικής Αναστάσιος Ντούνης Τμήμα Μηχανικών Αυτοματισμού Τ.Ε. Άδειες

ΕΛΛΗΝΙΚΗ ΔΗΜΟΚΡΑΤΙΑ Ανώτατο Εκπαιδευτικό Ίδρυμα Πειραιά Τεχνολογικού Τομέα ΕΥΦΥΗΣ ΕΛΕΓΧΟΣ Ενότητα #8: Βελτιστοποίηση Συστημάτων Ασαφούς Λογικής Αναστάσιος Ντούνης Τμήμα Μηχανικών Αυτοματισμού Τ.Ε. Άδειες

Τεχνικές Μείωσης Διαστάσεων. Ειδικά θέματα ψηφιακής επεξεργασίας σήματος και εικόνας Σ. Φωτόπουλος- Α. Μακεδόνας

Τεχνικές Μείωσης Διαστάσεων Ειδικά θέματα ψηφιακής επεξεργασίας σήματος και εικόνας Σ. Φωτόπουλος- Α. Μακεδόνας 1 Εισαγωγή Το μεγαλύτερο μέρος των δεδομένων που καλούμαστε να επεξεργαστούμε είναι πολυδιάστατα.

Τεχνικές Μείωσης Διαστάσεων Ειδικά θέματα ψηφιακής επεξεργασίας σήματος και εικόνας Σ. Φωτόπουλος- Α. Μακεδόνας 1 Εισαγωγή Το μεγαλύτερο μέρος των δεδομένων που καλούμαστε να επεξεργαστούμε είναι πολυδιάστατα.

ΠΕΡΙΕΧΟΜΕΝΑ ΚΕΦΑΛΑΙΟ 1

ΠΕΡΙΕΧΟΜΕΝΑ ΚΕΦΑΛΑΙΟ 1 ΣΥΝΔΥΑΣΤΙΚΗ 1.1 ΒΑΣΙΚΗ ΑΡΧΗ ΑΠΑΡΙΘΜΗΣΗΣ... 13 1.2 ΠΡΟΣΘΕΤΙΚΗ ΑΡΧΗ ΑΠΑΡΙΘΜΗΣΗΣ... 15 1.3 ΔΙΑΤΑΞΕΙΣ..... 16 1.4 ΜΕΤΑΘΕΣΕΙΣ... 18 1.5 ΣΥΝΔΥΑΣΜΟΙ... 20 1.6 ΕΠΑΝΑΛΗΠΤΙΚΕΣ ΜΕΤΑΘΕΣΕΙΣ......

ΠΕΡΙΕΧΟΜΕΝΑ ΚΕΦΑΛΑΙΟ 1 ΣΥΝΔΥΑΣΤΙΚΗ 1.1 ΒΑΣΙΚΗ ΑΡΧΗ ΑΠΑΡΙΘΜΗΣΗΣ... 13 1.2 ΠΡΟΣΘΕΤΙΚΗ ΑΡΧΗ ΑΠΑΡΙΘΜΗΣΗΣ... 15 1.3 ΔΙΑΤΑΞΕΙΣ..... 16 1.4 ΜΕΤΑΘΕΣΕΙΣ... 18 1.5 ΣΥΝΔΥΑΣΜΟΙ... 20 1.6 ΕΠΑΝΑΛΗΠΤΙΚΕΣ ΜΕΤΑΘΕΣΕΙΣ......

Μάθηση και Γενίκευση. "Τεχνητά Νευρωνικά Δίκτυα" (Διαφάνειες), Α. Λύκας, Παν. Ιωαννίνων

Μάθηση και Γενίκευση Το Πολυεπίπεδο Perceptron (MultiLayer Perceptron (MLP)) Έστω σύνολο εκπαίδευσης D={(x n,t n )}, n=1,,n. x n =(x n1,, x nd ) T, t n =(t n1,, t np ) T Θα πρέπει το MLP να έχει d νευρώνες

Μάθηση και Γενίκευση Το Πολυεπίπεδο Perceptron (MultiLayer Perceptron (MLP)) Έστω σύνολο εκπαίδευσης D={(x n,t n )}, n=1,,n. x n =(x n1,, x nd ) T, t n =(t n1,, t np ) T Θα πρέπει το MLP να έχει d νευρώνες

Πολλαπλή παλινδρόµηση. Μάθηµα 3 ο

Πολλαπλή παλινδρόµηση Μάθηµα 3 ο Πολλαπλή παλινδρόµηση (Multivariate regression ) Η συµπεριφορά των περισσότερων οικονοµικών µεταβλητών είναι συνάρτηση όχι µιας αλλά πολλών µεταβλητών Y = f ( X, X 2, X

Πολλαπλή παλινδρόµηση Μάθηµα 3 ο Πολλαπλή παλινδρόµηση (Multivariate regression ) Η συµπεριφορά των περισσότερων οικονοµικών µεταβλητών είναι συνάρτηση όχι µιας αλλά πολλών µεταβλητών Y = f ( X, X 2, X

Διακριτικές Συναρτήσεις

Διακριτικές Συναρτήσεις Δρ. Δηµήτριος Τσέλιος Επίκουρος Καθηγητής ΤΕΙ Θεσσαλίας Τµήµα Διοίκησης Επιχειρήσεων Θερµικός χάρτης των XYZ ξενοδοχείων σε σχέση µε τη γεωγραφική περιοχή τους P. Adamopoulos New

Διακριτικές Συναρτήσεις Δρ. Δηµήτριος Τσέλιος Επίκουρος Καθηγητής ΤΕΙ Θεσσαλίας Τµήµα Διοίκησης Επιχειρήσεων Θερµικός χάρτης των XYZ ξενοδοχείων σε σχέση µε τη γεωγραφική περιοχή τους P. Adamopoulos New

(1) L{a 1 x 1 + a 2 x 2 } = a 1 L{x 1 } + a 2 L{x 2 } (2) x(t) = δ(t t ) x(t ) dt x[i] = δ[i i ] x[i ] (3) h[i, i ] x[i ] (4)

![(1) L{a 1 x 1 + a 2 x 2 } = a 1 L{x 1 } + a 2 L{x 2 } (2) x(t) = δ(t t ) x(t ) dt x[i] = δ[i i ] x[i ] (3) h[i, i ] x[i ] (4) (1) L{a 1 x 1 + a 2 x 2 } = a 1 L{x 1 } + a 2 L{x 2 } (2) x(t) = δ(t t ) x(t ) dt x[i] = δ[i i ] x[i ] (3) h[i, i ] x[i ] (4)](/thumbs/58/41629922.jpg) Πανεπιστήμιο Θεσσαλίας ΗΥ240: Θεωρία Σημάτων και Συστημάτων Γραμμικά χρονικά μεταβαλλόμενα συστήματα Συνάρτηση συστήματος Ένα σύστημα L απεικονίζει κάθε σήμα εισόδου x σε ένα σήμα εξόδου y, δηλ., συνεχής

Πανεπιστήμιο Θεσσαλίας ΗΥ240: Θεωρία Σημάτων και Συστημάτων Γραμμικά χρονικά μεταβαλλόμενα συστήματα Συνάρτηση συστήματος Ένα σύστημα L απεικονίζει κάθε σήμα εισόδου x σε ένα σήμα εξόδου y, δηλ., συνεχής

ΤΕΙ ΔΥΤΙΚΗΣ ΜΑΚΕΔΟΝΙΑΣ Μεταπτυχιακό Τμήμα Τραπεζικής & Χρηματοοικονομικής

ΤΕΙ ΔΥΤΙΚΗΣ ΜΑΚΕΔΟΝΙΑΣ Μεταπτυχιακό Τμήμα Τραπεζικής & Χρηματοοικονομικής Πολλαπλό Γραμμικό Υπόδειγμα Παλινδρόμησης Τα υποδείγματα του απλού γραμμικού υποδείγματος της παλινδρόμησης (simple linear regression

ΤΕΙ ΔΥΤΙΚΗΣ ΜΑΚΕΔΟΝΙΑΣ Μεταπτυχιακό Τμήμα Τραπεζικής & Χρηματοοικονομικής Πολλαπλό Γραμμικό Υπόδειγμα Παλινδρόμησης Τα υποδείγματα του απλού γραμμικού υποδείγματος της παλινδρόμησης (simple linear regression

Εφαρμογές μεθοδολογιών μηχανικής εκμάθησης στο χώρο της παραγωγής υδρογονανθράκων. Βασίλης Γαγάνης

Εφαρμογές μεθοδολογιών μηχανικής εκμάθησης στο χώρο της παραγωγής υδρογονανθράκων Μέθοδοι μηχανικής εκμάθησης Εύρεση μαθηματικής έκφρασης μοντέλου (κανόνα) ο κανόνας διέπει το υπό μελέτη πρόβλημα ανάπτυξη

Εφαρμογές μεθοδολογιών μηχανικής εκμάθησης στο χώρο της παραγωγής υδρογονανθράκων Μέθοδοι μηχανικής εκμάθησης Εύρεση μαθηματικής έκφρασης μοντέλου (κανόνα) ο κανόνας διέπει το υπό μελέτη πρόβλημα ανάπτυξη

ΕΛΕΓΧΟΣ ΠΑΡΑΓΩΓΙΚΩΝ ΔΙΕΡΓΑΣΙΩΝ

ΕΛΛΗΝΙΚΗ ΔΗΜΟΚΡΑΤΙΑ Ανώτατο Εκπαιδευτικό Ίδρυμα Πειραιά Τεχνολογικού Τομέα ΕΛΕΓΧΟΣ ΠΑΡΑΓΩΓΙΚΩΝ ΔΙΕΡΓΑΣΙΩΝ Ενότητα: Αναγνώριση Διεργασίας - Προσαρμοστικός Έλεγχος (Process Identification) Αλαφοδήμος Κωνσταντίνος

ΕΛΛΗΝΙΚΗ ΔΗΜΟΚΡΑΤΙΑ Ανώτατο Εκπαιδευτικό Ίδρυμα Πειραιά Τεχνολογικού Τομέα ΕΛΕΓΧΟΣ ΠΑΡΑΓΩΓΙΚΩΝ ΔΙΕΡΓΑΣΙΩΝ Ενότητα: Αναγνώριση Διεργασίας - Προσαρμοστικός Έλεγχος (Process Identification) Αλαφοδήμος Κωνσταντίνος

ΠΕΡΙΕΧΟΜΕΝΑ ΜΕΡΟΣ ΠΡΩΤΟ ΣΤΟΙΧΕΙΑ ΔΙΑΦΟΡΙΚΟΥ ΛΟΓΙΣΜΟΥ ΣΥΝΑΡΤΗΣΕΩΝ ΠΟΛΛΩΝ ΜΕΤΑΒΛΗΤΩΝ 15

ΠΕΡΙΕΧΟΜΕΝΑ ΠΡΟΛΟΓΟΣ 13 ΜΕΡΟΣ ΠΡΩΤΟ ΣΤΟΙΧΕΙΑ ΔΙΑΦΟΡΙΚΟΥ ΛΟΓΙΣΜΟΥ ΣΥΝΑΡΤΗΣΕΩΝ ΠΟΛΛΩΝ ΜΕΤΑΒΛΗΤΩΝ 15 ΚΕΦΑΛΑΙΟ 1: ΣΥΝΑΡΤΗΣΕΙΣ ΠΟΛΛΩΝ ΜΕΤΑΒΛΗΤΩΝ 17 1. Εισαγωγή 17 2. Πραγματικές συναρτήσεις διανυσματικής μεταβλητής

ΠΕΡΙΕΧΟΜΕΝΑ ΠΡΟΛΟΓΟΣ 13 ΜΕΡΟΣ ΠΡΩΤΟ ΣΤΟΙΧΕΙΑ ΔΙΑΦΟΡΙΚΟΥ ΛΟΓΙΣΜΟΥ ΣΥΝΑΡΤΗΣΕΩΝ ΠΟΛΛΩΝ ΜΕΤΑΒΛΗΤΩΝ 15 ΚΕΦΑΛΑΙΟ 1: ΣΥΝΑΡΤΗΣΕΙΣ ΠΟΛΛΩΝ ΜΕΤΑΒΛΗΤΩΝ 17 1. Εισαγωγή 17 2. Πραγματικές συναρτήσεις διανυσματικής μεταβλητής

ΣΥΝΕΛΙΚΤΙΚΑ ΝΕΥΡΩΝΙΚΑ ΔΙΚΤΥΑ

ΠΑΝΕΠΙΣΤΗΜΙΟ ΠΑΤΡΩΝ - ΤΜΗΜΑ ΦΥΣΙΚΗΣ - Δ.Π.Μ.Σ. «Ηλεκτρονική και Επεξεργασία της Πληροφορίας» ΔΙΠΛΩΜΑΤΙΚΗ ΕΡΓΑΣΙΑ ΣΥΝΕΛΙΚΤΙΚΑ ΝΕΥΡΩΝΙΚΑ ΔΙΚΤΥΑ ΣΤΗΝ ΥΠΟΛΟΓΙΣΤΙΚΗ ΌΡΑΣΗ ΟΝΟΜΑΤΕΠΩΝΥΜΟ : ΠΑΠΑΔΟΠΟΥΛΟΣ ΑΘΑΝΑΣΙΟΣ

ΠΑΝΕΠΙΣΤΗΜΙΟ ΠΑΤΡΩΝ - ΤΜΗΜΑ ΦΥΣΙΚΗΣ - Δ.Π.Μ.Σ. «Ηλεκτρονική και Επεξεργασία της Πληροφορίας» ΔΙΠΛΩΜΑΤΙΚΗ ΕΡΓΑΣΙΑ ΣΥΝΕΛΙΚΤΙΚΑ ΝΕΥΡΩΝΙΚΑ ΔΙΚΤΥΑ ΣΤΗΝ ΥΠΟΛΟΓΙΣΤΙΚΗ ΌΡΑΣΗ ΟΝΟΜΑΤΕΠΩΝΥΜΟ : ΠΑΠΑΔΟΠΟΥΛΟΣ ΑΘΑΝΑΣΙΟΣ

Τεχνητή Νοημοσύνη ( )

Εβδομάδα Διάλεξη Ενδεικτικά θέματα διαλέξεων Ενδεικτικά θέματα εργαστηρίων/φροντιστηρίων 1 1 1 2 2 3 2 4 3 5 3 6 4 7 4 8 5 9 Τεχνητή Νοημοσύνη (2017-18) Γενικές πληροφορίες για το μάθημα. Εισαγωγή στην

Εβδομάδα Διάλεξη Ενδεικτικά θέματα διαλέξεων Ενδεικτικά θέματα εργαστηρίων/φροντιστηρίων 1 1 1 2 2 3 2 4 3 5 3 6 4 7 4 8 5 9 Τεχνητή Νοημοσύνη (2017-18) Γενικές πληροφορίες για το μάθημα. Εισαγωγή στην

HMY 795: Αναγνώριση Προτύπων

HMY 795: Αναγνώριση Προτύπων Διάλεξη 6 Κατανομές πιθανότητας και εκτίμηση παραμέτρων Κατανομές πιθανότητας και εκτίμηση παραμέτρων κανονικές τυχαίες μεταβλητές Εκτίμηση παραμέτρων δυαδικές τυχαίες μεταβλητές

HMY 795: Αναγνώριση Προτύπων Διάλεξη 6 Κατανομές πιθανότητας και εκτίμηση παραμέτρων Κατανομές πιθανότητας και εκτίμηση παραμέτρων κανονικές τυχαίες μεταβλητές Εκτίμηση παραμέτρων δυαδικές τυχαίες μεταβλητές

ΠΑΝΕΠΙΣΤΗΜΙΟ ΠΕΙΡΑΙΩΣ ΤΜΗΜΑ ΣΤΑΤΙΣΤΙΚΗΣ ΚΑΙ ΑΣΦΑΛΙΣΤΙΚΗΣ ΕΠΙΣΤΗΜΗΣ Εξετάσεις περιόδου στο μάθημα ΑΝΑΛΥΣΗ ΠΑΛΙΝΔΡΟΜΗΣΗΣ

ΠΑΝΕΠΙΣΤΗΜΙΟ ΠΕΙΡΑΙΩΣ ΤΜΗΜΑ ΣΤΑΤΙΣΤΙΚΗΣ ΚΑΙ ΑΣΦΑΛΙΣΤΙΚΗΣ ΕΠΙΣΤΗΜΗΣ Εξετάσεις περιόδου στο μάθημα ΑΝΑΛΥΣΗ ΠΑΛΙΝΔΡΟΜΗΣΗΣ Ονοματεπώνυμο: Όνομα Πατρός:... Σ ΑΜ:. Ημερομηνία: Παρακαλώ μη γράφετε στα παρακάτω

ΠΑΝΕΠΙΣΤΗΜΙΟ ΠΕΙΡΑΙΩΣ ΤΜΗΜΑ ΣΤΑΤΙΣΤΙΚΗΣ ΚΑΙ ΑΣΦΑΛΙΣΤΙΚΗΣ ΕΠΙΣΤΗΜΗΣ Εξετάσεις περιόδου στο μάθημα ΑΝΑΛΥΣΗ ΠΑΛΙΝΔΡΟΜΗΣΗΣ Ονοματεπώνυμο: Όνομα Πατρός:... Σ ΑΜ:. Ημερομηνία: Παρακαλώ μη γράφετε στα παρακάτω

Μέρος V. Ανάλυση Παλινδρόμηση (Regression Analysis)

Μέρος V. Ανάλυση Παλινδρόμηση (Regresso Aalss) Βασικές έννοιες Απλή Γραμμική Παλινδρόμηση Πολλαπλή Παλινδρόμηση Εφαρμοσμένη Στατιστική Μέρος 5 ο - Κ. Μπλέκας () Βασικές έννοιες Έστω τ.μ. Χ,Υ όπου υπάρχει

Μέρος V. Ανάλυση Παλινδρόμηση (Regresso Aalss) Βασικές έννοιες Απλή Γραμμική Παλινδρόμηση Πολλαπλή Παλινδρόμηση Εφαρμοσμένη Στατιστική Μέρος 5 ο - Κ. Μπλέκας () Βασικές έννοιες Έστω τ.μ. Χ,Υ όπου υπάρχει

Θεωρία Λήψης Αποφάσεων

Θεωρία Λήψης Αποφάσεων Ενότητα 2: Θεωρία Απόφασης του Bayes Μπεληγιάννης Γρηγόριος Σχολή Οργάνωσης και Διοίκησης Επιχειρήσεων Τμήμα Διοίκησης Επιχειρήσεων Αγροτικών Προϊόντων & Τροφίμων (Δ.Ε.Α.Π.Τ.) Θεωρία

Θεωρία Λήψης Αποφάσεων Ενότητα 2: Θεωρία Απόφασης του Bayes Μπεληγιάννης Γρηγόριος Σχολή Οργάνωσης και Διοίκησης Επιχειρήσεων Τμήμα Διοίκησης Επιχειρήσεων Αγροτικών Προϊόντων & Τροφίμων (Δ.Ε.Α.Π.Τ.) Θεωρία

Υλοποιώντας λογικές πύλες χρησιμοποιώντας perceptrons

Υλοποιώντας λογικές πύλες χρησιμοποιώντας perceptrons Ένας μικρός οδηγός Λευτέρης Ασλάνογλου Προπτυχιακός Φοιτητής Μηχανικών Η/Υ & Πληροφορικής Πάτρας Τρίτη, 5 Ιουνίου 2012 Το παρακάτω είναι ένα tutorial

Υλοποιώντας λογικές πύλες χρησιμοποιώντας perceptrons Ένας μικρός οδηγός Λευτέρης Ασλάνογλου Προπτυχιακός Φοιτητής Μηχανικών Η/Υ & Πληροφορικής Πάτρας Τρίτη, 5 Ιουνίου 2012 Το παρακάτω είναι ένα tutorial

Γραµµικοί Ταξινοµητές

ΚΕΣ 3: Αναγνώριση Προτύπων και Ανάλυση Εικόνας KEΣ 3 Αναγνώριση Προτύπων και Ανάλυση Εικόνας Γραµµικοί Ταξινοµητές ΤµήµαΕπιστήµης και Τεχνολογίας Τηλεπικοινωνιών Πανεπιστήµιο Πελοποννήσου 7 Ncolas sapatsouls

ΚΕΣ 3: Αναγνώριση Προτύπων και Ανάλυση Εικόνας KEΣ 3 Αναγνώριση Προτύπων και Ανάλυση Εικόνας Γραµµικοί Ταξινοµητές ΤµήµαΕπιστήµης και Τεχνολογίας Τηλεπικοινωνιών Πανεπιστήµιο Πελοποννήσου 7 Ncolas sapatsouls