ΕΠΛ 604 Τεχνητή Νοηµοσύνη *****************

|

|

|

- Δαμιανός Παπαφιλίππου

- 7 χρόνια πριν

- Προβολές:

Transcript

1 ΕΠΛ 604 Τεχνητή Νοηµοσύνη ***************** Κώστας Νεοκλέους, PhD Τηλέφωνο Γραφείου: ΤΕΧΝΗΤΑ ΝΕΥΡΩΝΙΚΑ ΙΚΤΥΑ Adaline, Madaline, MLP Αλγόριθµος Ελαχίστων Μέσων Τετραγώνων Least Mean Square Algorithm (LMS) Αλγόριθµος Backpropagation

2 Γενικά τη σειρά αυτή θα δούµε µερικές από τις πιο βασικές αρχιτεκτονικές (ή τοπολογίες) τεχνητών νευρωνικών δικτύων που µπορούν να χρησιµοποιηθούν για τη δηµιουργία άλλων, πιο σύνθετων δοµών Αυτές είναι τα Adaline, Madaline, Perceptrons και σταδιακά τα MLP Τέτοιες αρχιτεκτονικές έχουν πολλές εφαρµογές όπως θα δούµε στη συνέχεια ADALINE Είναι µια βασική δοµή ενός γραµµικού νευρώνα Είναι προσαρµοζόµενος (adaptive) γραµµικός συνδυαστής (simple adaptive linear combiner) Οι πληροφορίες εισόδου και εξόδου είναι συνήθως σε ψηφιακή (δυαδική) µορφή

3 οµήενός απλού Adaline τοιχεία εισόδου υναπτικά Βάρη x (κ) w (κ) x 2 (κ) w 2 (κ) u N = i= xw i i όπου, x R Nx x N (κ) w N (κ) w R Nx x w u = x T w u R ADALINE Το απλό µοντέλο Adaline µοιάζει µε το Finite Impulse Response Filter FIR που χρησιµοποιείται στη ψηφιακή επεξεργασία σήµατος Μετά από κατάλληλη µάθηση που γίνεται συνήθως µε αλγόριθµο LMS που θα δούµε αργότερα το adaline µπορεί να χρησιµοποιηθεί για να αναγνωρίζει τα αρχικά σήµατα έστω και αν αυτά έχουν αλλοιωθεί ελαφρά

4 ΒΑΙΚΑ ΤΟΙΧΕΙΑ ΓΙΑ ΦΙΛΤΡΑ Παράδειγµα εφαρµογής φίλτρου που προσαρµόστηκε µε µάθηση LMS: Το σήµα εισόδου Η κατηγοριοποίηση ΦΙΛΤΡΟ Καλό φιλτράρισµα ΦΙΛΤΡΟ 05 Ικανοποιητικό φιλτράρισµα ΦΙΛΤΡΟ 0 Απορριπτέο φιλτράρισµα κοκ ΒΑΙΚΑ ΤΟΙΧΕΙΑ ΓΙΑ ΦΙΛΤΡΑ Τα φίλτρα µπορεί να είναι υλισµικά (physical hardware) ή υπολογιστικά (computer software) Οι εργασίες που συνήθως κάνουν είναι: Φιλτράρισµα (filtering) υπό την έννοια της απάλειψης θορύβου (noise) και άλλων µη-επιθυµητών παρεµβολών Βελτίωση (smoothening) που γίνεται συνήθως όταν έχουµε καλή γνώση των σχετικών διαδικασιών Χρονική πρόβλεψη (prediction)

5 ΜΕΡΙΚΑ ΠΑΡΑ ΕΙΓΜΑΤΑ ΕΦΑΡΜΟΓΗ ΦΙΛΤΡΩΝ Τα φίλτρα µπορούν να κατηγοριοποιηθούν ως γραµµικά ή µη-γραµµικά ε συστήµατα εντοπισµού στόχων µε ραντάρ (pulse radar tracking systems), το φίλτρο θα µπορούσε να κάνει, καθάρισµα σήµατος (filtering), βελτίωση (smoothening) και πρόγνωση (prediction) 2 ιαχωρισµός ηλεκτροκαρδιογραφήµατος (ΗΚΓ, ΕCG) εγκύου από το ΗΚΓ του εµβρύου ΠαράδειγµαΕΚΓ Παράδειγµα 3: Καθαρισµός ECG σήµατος από παρεµβολές Η/Μ πεδίου 50 Hz Ηλεκτροκαρδιογράφος Ηλεκτροκαρδιογράφηµα µε παρεµβολές από το Η/Μ πεδίο των 50 Ηz

6 ΠαράδειγµαΕΚΓ ECG σήµα µετά τον καθαρισµό του από κατάλληλο φίλτρο: ΠαράδειγµαΕΚΓ Λεπτοµέρεια ECG σήµατος Το αποτέλεσµα επετεύχθη µε µόνο δύο βάρη (w και w 2 ) και µε τη χρήση αλγόριθµου LMS

7 Adaline Για επεξεργασία µε ψηφιακά σήµατα, συχνά χρησιµοποιούµε στην έξοδο περιοριστή (ή κβαντιστή, ή ψαλιδιστή, ή στοιχείο κατωφλίου) (threshold, quantizer, signum, hard limiter, Heavyside,) όπως πιο κάτω: x (κ) w (κ) Κβαντιστής x 2 (κ) w 2 (κ) u N = i= xw i i y = + ή - x N (κ) w N (κ) Adaline Γενικά το Adaline - όπως και τα περισσότερα µονοκατευθυντικά τεχνητά νευρωνικά δίκτυα (feedforward neural networks) πραγµατοποιούν µιαν αντιστοίχηση (mapping) από N στοιχεία εισόδου σε στοιχείο εξόδου R Ν R Μετά που θα µάθει τα παραδείγµατα που το δόθηκαν, θα πρέπει να ελεγχθεί µε άγνωστες περιπτώσεις Εάν διακριβώνει σωστά µε ικανοποιητική πιθανότητα, τότε λέµε ότι έµαθε να γενικεύει (generalization)

8 Λίγη ξεκούραση! Adalines σαν λογικές πύλες Τα Adalines µπορούν να χρησιµοποιηθούν σαν λογικές πύλες AND, OR, MAJ, NOT Μαθηµατικά: N y x AND( x x x) = sgn( ( i) + - N ) =, 2,, N = i= + Εάν όλα τα x i = + - Εάν όχι N = + = OR( ) = i= y sgn( ( xi) N - ) x, x2,, xn + Εάν µερικά x i = + - Εάν όχι

9 Adalines σαν λογικές πύλες N = sgn( ) = ) = i= y xi MAJ( x, x2,, xn + Εάν τα πλείστα x i = + - Εάν όχι y = s g n( x) = NOT( x) = + Εάν x =- - Εάν x =+ Adalines σαν λογικές πύλες Οι πύλες AND, OR, MAJ δείχνονται γραφικά µε adalines πιο κάτω: x 0 (κ)= x (κ) - Ν AND x 2 (κ) y = πύλη AND x N (κ)

10 Adalines σαν λογικές πύλες x 0 (κ)= x (κ) Ν - OR x 2 (κ) y = πύλη OR x N (κ) Adalines σαν λογικές πύλες x 0 (κ)= x (κ) 0 MAJ x 2 (κ) y = πύλη MAJ x N (κ)

11 Adaline µε µη-γραµµικά στοιχεία εισόδου (Polynomial Discriminant Function Specht, 967) x x x 2 w 3 [ ] 2 w X w 2 w 3 Περιοριστής y w 4 x 2 [ ] 2 w 5 Χρησιµοποιήθηκε για ανάλυση δεδοµένων ECG MADALINE τις περιπτώσεις που τα σήµατα εισόδου δεν µπορούν να διαχωριστούν γραµµικά, τα απλά adaline αποτυγχάνουν να τα διαχωρίσουν ε τέτοιες περιπτώσεις θα µπορούσαµε να χρησιµοποιήσουµε MADALINES (από το Multiple ADALINE) όπου πολλά adalines συνδέονται σε σειρά

12 MADALINE x y = sgn(u ) x 2 y 2 = sgn(u 2 ) x N Όπου για ευκρίνεια τα βάρη δεν δείχνονται PERCEPTRON Τo απλό µονοεπίπεδο (single-layer) PERCEPTRON (Rosenblatt, 950) είχε εξαιρετικά µεγάλη επίδραση στην ανάπτυξη των τεχνητών νευρωνικών δικτύων Μοιάζει πολύ µε το Adaline που είδαµε Ο Rosenblatt χρησιµοποίησε το απλό µοντέλο νευρώνων των McCuloch - Pitts (947)

13 Απλό µονοεπίπεδο PERCEPTRON Ο Rosenblatt χρησιµοποίησε το µοντέλο που ονόµασε Perceptron, στη προσπάθεια του να µελετήσει τη λειτουργία του οφθαλµού Απλό µονοεπίπεδο PERCEPTRON Τo απλό µονοεπίπεδο PERCEPTRON έχει πολλές οµοιότητες µε αυτό που ονοµάζεται Maximum- likelihood Gaussian Classifier Παρόλο που ήταν µια νέα νέα και πρωτοποριακή µοντελοποίηση νευρωνικού δικτύου, υποβλήθηκε σε πολλή κριτική, κυρίως από τους Minsky και Papert* γιατί, µεταξύ άλλων, δεν µπορούσε να επιλύσει το κλασσικό πρόβληµα ΧOR Φαίνεται ότι ο κάπως υπερβολικός όρος Perceptron, προδιάθεσε µερικούς επιστήµονες αρνητικά ήµερα, το ενδιαφέρον εστιάζεται στα πολυεπίπεδα perceptrons που θα δούµε λίγο µετά * M Minsky and S A Papert Perceptrons: An Introduction to Computational Geometry MIT Press, Cambridge, MA, expanded edition, 988/969

14 Πολυεπίπεδα PERCEPTRONS MultiLayer Perceptrons (MLP) Τυπικά ένα τέτοιο δίκτυο αποτελείται από: Ένα σύνολο αισθητήρων ή πληροφοριών εισόδου (πηγαίοι κόµβοι), που αποτελούν το επίπεδο εισόδου (input layer) Ένα ή περισσότερα κρυµµένα επίπεδα (hidden layers) υπολογιστικών κόµβων και ένα επίπεδο υπολογιστικών κόµβων εξόδου Πολυεπίπεδα PERCEPTRONS κρυµµένα επίπεδα Ε Ι Ο Ο Ε Ξ Ο Ο

15 Πολυεπίπεδα PERCEPTRONS - MLP Τα MLP εφαρµόστηκαν µε επιτυχία στην επίλυση ποικίλων και δύσκολων προβληµάτων, όπως δείχνεται παρακάτω για ηλεκτρονική µύτη

16 Μάθηση στα ADALINES MADALINES PERCEPTRONS και MLP Μάθηση στο απλό Adaline x (κ) x 2 (κ) w (κ) w 2 (κ) u(κ N ) = xw i i i= Επιθυµητή έξοδος - d(κ) + ύγκριση φάλµα e(κ) = d(κ) u(κ) x N (κ) w N (κ) Οαλγόριθµος µάθησης καθορίζει πως να προσαρµοστούν τα βάρη ώστε το σφάλµα να γίνει ικανοποιητικά µικρό Αλγόριθµος µάθησης

17 Αλγόριθµος Ελαχίστων Μέσων Τετραγώνων (ΕΜΤ, LMS) Τα Adalines συνήθως εκπαιδεύονται µε τον αλγόριθµο των Ελαχίστων Μέσων Τετραγώνων, που είναι επίσης γνωστός ως Widrow-Hoff ή Κανόνας έλτα (Delta Rule) ή Error Correction Rule Είναι ένας απλός κανόνας Bernard Widrow Εφαρµόζεται συνήθως σε γραµµικά στοιχεία Θα εξηγηθεί για ένα απλό νευρώνα Αλγόριθµος Ελαχίστων Μέσων Τετραγώνων Η µέθοδος είναι σηµαντική γιατί: Είναι προϊόν πρωτοποριακής εργασίας που έγινε στο Πανεπιστήµιο Stanford από τους Widrow και Hoff τη δεκαετία του 960 Βοηθά στη κατανόηση της θεωρίας των γραµµικών προσαρµοζόµενων φίλτρων που χρησιµοποιούν απλό γραµµικό νευρώνα Βοηθά επίσης στη θεωρητική ανάπτυξη των µη-γραµµικών πολυεπίπεδων perceptron (Multi Layer Perceptrons, MLP)

18 Αλγόριθµος Ελαχίστων Μέσων Τετραγώνων Οι Widrow και Hoff προσπάθησαν να βρουν µια διαδικασία που να προσαρµόζει τα συναπτικά βάρη w έτσι ώστε ο νευρώνας να αναγνωρίζει (ξεχωρίζει, καθορίζει) κάποια πρότυπα εισόδου, µε όσο το δυνατό λιγότερο γενικό σφάλµα Βασίστηκαν στην εργασία του Rosenblatt που έγινε στα Perceptrons αν µέτρο αποδοτικότητας (performance), χρησιµοποίησαν το κριτήριο Ελάχιστου Μέσου Τετραγωνικού φάλµατος (LMS) Αλγόριθµος Ελαχίστων Μέσων Τετραγώνων O αλγόριθµος LMS έχει πολλές εφαρµογές όπως σε: Προσαρµοζόµενα κυκλώµατα (ήταν η πρώτη εφαρµογή που έγινε) [Adaptive Switching Circuits (Widrow και Hoff, 960)] Προσαρµοζόµενες τηλεφωνικές γραµµές για γρήγορη µεταφορά πληροφοριών [Adaptive equalization of telephone channels (Lucky 965, 966)] Προσαρµοζόµενες αντένες για τη µείωση των παρεµβολών [Adaptive antennas (Widrow et al, 967)] Προσαρµοζόµενη ακύρωση ηχούς που έρχεται από µακρινές αποστάσεις [Adaptive echo cancellation (Sondhi και Berkley, 980)] Προσαρµοζόµενη κωδικοποίηση οµιλίας [Adaptive differential pulse code modulation (Jayant και Noll, 984)]

19 Ανάπτυξη Αλγόριθµου Ελαχίστων Μέσων Τετραγώνων Έστω x = [x, x 2,, x N ] T τα σήµατα εισόδου που παράγονται από κάποιους αισθητήρες Θέση αισθητήρα x x 2 w w 2 x w N T y = xw = w x i= i i Αθροιστής (Adder) y Ένταση φωτός Tα σήµατα εφαρµόζονται σε αντίστοιχο σύνολο βαρών: w = [ w,w 2,, w N ] T x N Αισθητήρες (Sensors) w N Βάρη Weights (multipliers) Ανάπτυξη Αλγόριθµου Ελαχίστων Μέσων Τετραγώνων όπου, y είναι η έξοδος (εξαρτηµένη µεταβλητή) του δικτύου d είναι η επιθυµητή έξοδος (desired output) [είναι επίσης γνωστή ως target ή observation] Το ζητούµενο είναι να υπολογιστούν οι βέλτιστες τιµές του w, έτσι ώστε να ελαχιστοποιείται κάποιο κατάλληλο συνολικό σφάλµα, J Αυτό είναι συνήθως µια συνάρτηση του σφάλµατος e όπου e d y Όταν το συνολικό σφάλµα εκφράζεται ως µέσο τετραγωνικό, η λύση θα µπορούσε να βρεθεί από ένα σύστηµα εξισώσεων που είναι γνωστές ως Wiener-Hopf Την απόδειξη αυτών των εξισώσεων θα δούµε αµέσως µετά

20 Ανάπτυξη Εξισώσεων Wiener-Hopf µε χρήση Αλγόριθµου Ελαχίστων Μέσων Τετραγώνων H σχέση εισόδου-εξόδου είναι: N T y = xw = w x (4) i= Το σήµα σφάλµατος για ένα πρότυπο µάθησης και για ένα νευρώνα εξόδου είναι: e = d y i i (42) Αλγόριθµος Ελαχίστων Μέσων Τετραγώνων Ένα κατάλληλο µέτρο απόδοσης (performance criterion ή measure), ή συνάρτηση κόστους (cost function) J, για όλα τα πρότυπα, είναι το µέσο τετραγωνικό σφάλµα (mean square error - MSE), που ορίζεται από τη σχέση: J = E e E d y E d wx 2 = = ( 2 ) ( N 2 i i) i= Όπου Ε είναι ο τελεστής της «αναµενόµενης τιµής» ή στατιστική µέση τιµή (expectation, mean, ensemble average) (43)

21 Ορισµός: Ορισµός και ιδιότητες του Ε[] Για τυχαία συνεχή µεταβλητή x, που παρουσιάζεται µε πιθανότητα P x : + Ex [ ] = x xpx ( xdx ) (44) Νοουµένου βέβαια ότι το ολοκλήρωµα έχει απόλυτη σύγκλιση Για τυχαία διακριτή µεταβλητή, x: E[ x] = x xp{x i = x i } = xp i i i i (45) Ορισµός και ιδιότητες του Ε[] Χρήσιµες ιδιότητες του Ε[] : Εάν c και c 2 είναι σταθερές που παίρνουν πραγµατικές τιµές, Ε[c x + c 2 ]=c Ε[x] + c 2 Ε[x x 2 x 3 ]=Ε[x ] Ε[x 2 ] Ε[x 3 ] (46) (47) Ε[x] Ε[ x ] (48)

22 Γραµµικό πρόβληµα βέλτιστου φιλτραρίσµατος Το πρόβληµα αυτό µπορεί να θεωρηθεί και ως γραµµικό πρόβληµα βέλτιστου φιλτραρίσµατος (linear optimum filtering problem) που συνοπτικά ορίζεται ως εξής: Ζητείται να καθοριστεί το βέλτιστο σύνολο βαρών w *,w* 2,, w* Ν, για το οποίο το µέσο τετραγωνικό λάθος J είναι ελάχιστο Εξισώσεις Wiener-Hopf Λύση: (γνωστή σαν φίλτρο Wiener) Από την (43) και τις ιδιότητες του τελεστή E[ ]: N N N 2 J = E[ d ] E i i i j i j 2 wxd + E ww x x i= 2 j= i= (49) όπου Ν είναι ο αριθµός των στοιχείων εισόδου

23 Εξισώσεις Wiener-Hopf Επειδή ο τελεστής Ε[] είναι γραµµικός, µπορούµε να αλλάξουµε τη σειρά του Ε µε το, οπόταν η (49) γίνεται: J = Ed wexd + wwexx 2 2 N N N 2 [ ] i [ i ] i j [ i j] i= j= i= ήσε διανυσµατική µορφή: όπου τα συναπτικά βάρη w θεωρούνται σταθερά, και βγαίνουν έξω από τα Ε[] (40) 2 T T T J = E[ d ] E[ x d] w+ w E[ xx ] w (4) 2 2 Εξισώσεις Wiener-Hopf Για ευκολία στη χρήση, και χρησιµοποιώντας τους γνωστούς στατιστικούς ορισµούς: E[d 2 ] r d = Μέση τετραγωνική τιµή Τη συνάρτηση ετεροσυσχέτισης (cross-correlation): E[x i d] R xd (i) όπου i =, 2,,Ν (42) (43) και τη συνάρτηση αυτοσυσχέτισης (auto-correlation): ( ) R i, j E[ x, x ] i, j =, 2,, N xx i j (44) Η (40) γράφεται:

24 Εξισώσεις Wiener-Hopf N N N J = rd wr i xd() i + wwr i j xx(, i j) 2 i= 2 j= i= (45) Ηεξίσωση αυτή είναι θετική για όλα τα βάρη, και εποµένως έχει ολικό ελάχιστο (global minimum) Για τη περίπτωση δύο βαρών µόνο, η επιφάνεια δείχνεται παρακάτω Επιφάνεια σφάλµατος για Adaline

25 Επιφάνεια σφάλµατος Γενικότερα, η σχεδίαση του κόστους J σαν συνάρτηση δύο παραµέτρων w, w2 δείχνει µιαν επιφάνεια σφάλµατος, µε πολλά ελάχιστα J w w2 Επιφάνεια σφάλµατος Ανάλογα, η σχεδίαση κόστους J σε πολυδιάστατο χώρο είναι µια νοητή επιφάνεια σφάλµατος το γραµµικό adaline, η επιφάνεια έχει κοίλο σχήµα (convex), µε πολύ καλά καθορισµένα τοπικά ελάχιστα και ολικό ελάχιστο (global minimum) Αυτό το σηµείο, είναι το βέλτιστο για το φίλτρο, µε την έννοια ότι το µέσο τετραγωνικό λάθος δίνει την ελάχιστη τιµή στο J 25

26 Ελάχιστο της επιφάνειας σφάλµατος Όπως για να βρούµε το ελάχιστο µιας µονοδιάστατης συνάρτησης, εξισώνουµε τη παράγωγο µε µηδέν και λύνουµε την εξίσωση, έτσι και εδώ, για το προσδιορισµό του βέλτιστου, διαφορίζουµε τη συνάρτηση κόστους J ως προς τα βάρη w i και εξισώνουµε µε µηδέν Η µερική παράγωγος του J ως προς w i, είναι η κλίση (gradient) της επιφάνειας σφάλµατος ως προς το συγκεκριµένο w i Παραγωγίζοντας την (45) ως προς w i και εξισώνοντας µε µηδέν, έχουµε: N J w J i = = R () i + w R (, i j ) = 0 (46) xd j xx w i j=

27 Εξισώσεις Wiener-Hopf Έτσι παίρνουµε τις εξισώσεις Wiener-Hoff για βέλτιστο φίλτρο τύπου Adaline: N j= wr ( i, j) = R ( i) i=, 2,, N * j xx dx (47) Όπου το w * i δηλώνει τη βέλτιστη τιµή του w i Tο νευρωνικό δίκτυο που έχει βάρη που ικανοποιούν τις πιο πάνω εξισώσεις, είναι γνωστό ως φίλτρο Wiener Εφαρµογή φίλτρου Wiener Lena µε θόρυβο Lena µετά από φίλτρο Wiener

28 Λύση εξισώσεων Wiener-Hopf υνήθως δεν είναι εύκολο (ή είναι αδύνατο) να βρεθούν αναλυτικές λύσεις του συστήµατος Wiener-Hopf Χρειάζεται να βρεθεί το αντίστροφο ενός µεγάλου πίνακα [ΝxΝ], που είναι δύσκολη και χρονοβόρος εργασία Μπορούν όµως να να βρεθούν µε διερεύνηση (search), ψάχνοντας στο χώρο της επιφάνειας σφάλµατος, εφαρµόζοντας τη µέθοδο ταχυτέρας καθόδου που είδαµε προηγουµένως Η µέθοδος που προκύπτει λέγεται Μέθοδος Ελαχίστων Τετραγώνων (LMS) ή Κανόνας ιορθώµατος φάλµατος (Error Correction Learning), ή Κανόνας έλτα (Delta Rule) (Widrow Hoff, 960) Μέθοδος ταχυτέρας καθόδου στη λύση των εξισώσεων Wiener-Hoff Χρησιµοποιώντας τη µέθοδο όπως εξηγήθηκε προηγουµένως, έχουµε: w i = - η wi J i =,, N όπου η παράµετρος η είναι γνωστή ως Ρυθµός Μάθησης (Learning Rate ή Learning Coefficient) ήσε διαφορική µορφή για τη περίπτωση συνεχούς χρονικής µεταβολής των βαρών: dw dt = -η wi J (48) (49)

29 Μέθοδος ταχυτέρας καθόδου στη λύση των εξισώσεων Wiener-Hoff Χρησιµοποιώντας τον δείκτη κ, να αναφέρεται στον αριθµό επανάληψης (ή δοκιµής, ή προσπάθειας), ο συνδυασµός των εξισώσεων (45) και (48) δίνουν: N w i [κ+] = w i [κ] + η{r xd (i) - w [ κ j ] Rxx( i, j) } i =,, Ν (420) j= Θα µπορούσαµε να καταλήξουµε σε ανάλογα συµπεράσµατα χρησιµοποιώντας ένα συνολικό άθροισµα των σφαλµάτων αντί της αναµενόµενης ή µέσης τιµής J Μέθοδος ταχυτέρας καθόδου στη λύση των εξισώσεων Wiener-Hoff ε τέτοια περίπτωση το κόστος που προσπαθούµε να ελαχιστοποιήσουµε συµβολίζεται συνήθως µε Ε (από το Energy) ή C, και δίνεται όπως πιο κάτω: E ολικό P = ei 2 i= 2 (42) τη βιβλιογραφία θα το βρείτε επίσης µε το όνοµα SSE από το Sum Square Error

30 Μέθοδος ταχυτέρας καθόδου στη λύση των εξισώσεων Wiener-Hoff Ο συνδυασµός της έκφρασης του κόστους ως συνάρτηση των µέσων τετραγώνων του σφάλµατος, και της µεθόδου της ταχυτέρας καθόδου, είναι γνωστός ως: Αλγόριθµος Ελαχίστου Μέσου Τετραγώνου ή Κανόνας έλτα ή Κανόνας Widrow-Hoff Επειδή δεν γνωρίζουµε τη τελική µορφή της επιφάνειας σφάλµατος, σε πρακτική αλγοριθµική µορφή χρησιµοποιούµε τα στιγµιαία βάρη και τη στιγµιαία επιφάνεια Αλγόριθµος Ελαχίστου Μέσου Τετραγώνου Least Mean Square Algorithm (LMS) Αρχικοποίηση (initialization): wˆ [] = 0 για i =,, N i (422) Το καπελάκι υποδηλώνει καθ υπολογισµό βάρη, για τη στιγµιαία επιφάνεια Φιλτράρισµα (filtering): Για χρόνους κ =, 2, Υπολόγισε: N y[ κ] = x[ ] ˆ i κ wi[ κ] i= και e[κ] = d[κ] y[κ] (423) (424)

31 Αλγόριθµος Ελαχίστου Μέσου Τετραγώνου Least Mean Square Algorithm (LMS) Αναθεώρηση βαρών w (weight updating): w ˆ i[ κ + ] = wi[ κ] + ηe[ κ] xi[ κ ] (424) για i =,, Ν Για την αρχικοποίηση, συνήθως βάζουµε τα βάρη να έχουν αρχικές τιµές ίσες µε µηδέν Θα µπορούσαµε όµως να χρησιµοποιήσουµε άλλες τιµές Αλγόριθµος Ελαχίστου Μέσου Τετραγώνου Least Mean Square Algorithm (LMS) Όπως είπαµε, µεγάλες τιµές του η θα µπορούσαν να οδηγήσουν σε αστάθειες, ενώ πολύ µικρές θα έκαναν το ρυθµό µάθησης πολύ αργό ηµαντική θεωρητική εργασία που έγινε, δίνει καθοδήγηση για µεταβαλλόµενο η όπως δείχνετε στον παρακάτω αλγόριθµο

32 Αλγόριθµος Ελαχίστου Μέσου Τετραγώνου µε µεταβαλλόµενο ρυθµό µάθησης, η Βήµα Για χρόνο κ = ώσε αρχικά βάρη w[] και διάλεξε τιµές για το η ο και το τ Βήµα 2 Υπολόγισε το ρυθµό µάθησης από: o η[ κ ] = η κ + τ Βήµα 3 Βρές το σφάλµα: e[ κ] = d( κ) - wˆ i[ κ] xi[ κ] N i= (425) (425) Αλγόριθµος Ελαχίστου Μέσου Τετραγώνου µε µεταβαλλόµενο ρυθµό µάθησης, η Βήµα 4 Αναθεώρησε τα βάρη: w ˆ i[ κ + ] = wi[ κ] + η[ κ] e[ κ] xi[ κ] (424) για i =,, Ν Βήµα 5 Έλεγχος για σύγκλιση: Εάν ναι, σταµάτα Εάν όχι, θέσε: κ κ + Πίσω στο βήµα 2

33 Μάθηση στα MADALINES Τα MADALINES µπορούν να εκπαιδευτούν µε τον κανόνα LMS ή από άλλους κατάλληλους που θα δούµε αργότερα Λίγη ξεκούραση!

34 Μάθηση σε Πολυεπίπεδα PERCEPTRONS υνήθως εκπαιδεύονται µε επιβλεπόµενο τρόπο (supervised learning), χρησιµοποιώντας τον πολύ δηµοφιλή αλγόριθµο ανατροφοδότησης σφάλµατος (Α) (Error Backpropagation -BP)που είναι επίσης γνωστός ως Γενικευµένος Κανόνας έλτα (Generalized Delta Rule) Ο αλγόριθµος βασίζεται σε κανόνα µάθησης που χρησιµοποιεί το σφάλµα στην έξοδο για να οδηγήσει το δίκτυο σε σταδιακά καλύτερη απόδοση (Error Correction Learning Rule) Μάθηση σε Μη-Γραµµικά PERCEPTRONS κατωφλίου Η µάθηση που συνήθως χρησιµοποιείται είναι βασισµένη σε µέσο τετραγωνικό σφάλµα (MSE) και σε κανόνα ταχυτέρας καθόδου Οαρχικός αλγόριθµος όπως προτάθηκε από τον Rosenblatt ήταν: w ij [κ+] = w ij [κ] + ηe j [κ]x i [κ] (425) και e j [κ] = d j [κ] y j [κ] = d j [κ] sgn(u j [κ])

35 Μάθηση σε Μη-Γραµµικά PERCEPTRONS τη περίπτωση που η συνάρτηση δραστηριοποίησης είναι σιγµοειδής, η εφαρµογή του πιο πάνω κανόνα οδηγά στον κλασσικό αλγόριθµο Backpropagation (BP) για µονοεπίπεδο, µη-γραµµικό perceptron τη περίπτωση που η συνάρτηση δραστηριοποίησης είναι για παράδειγµα η: yj = f ( uj) = tanh( γuj) (426) Οαλγόριθµος µάθησης γίνετε: w ij [κ+] = w ij [κ] + ηe j [κ]{- (y j [κ]) 2 }x i [κ] Που είναι ο BP για µονοεπίπεδο perceptron (427) MLP και BP Βασικά η διαδικασία της Α αποτελείται από δυο περάσµατα διαµέσου των επιπέδων του δικτύου: Ένα πέρασµα προς τα εµπρός (ενεργοποίηση) (forward pass) και ένα πέρασµα προς τα πίσω (ανάδραση) (backward pass) την την ενεργοποίηση τα βάρη στο δίκτυο διατηρούνται σταθερά Κατά τη διάρκεια της ανατροφοδότησης τα βάρη προσαρµόζονται σύµφωνα µε τον κανόνα διόρθωσης σφάλµατος, ώστε σταδιακά να µειωθεί το συνολικό σφάλµα

36 MLP και BP Ηπαρουσία της µη-γραµµικότητας είναι σηµαντική, διότι διαφορετικά η σχέση εισόδου-εξόδου θα µπορούσε να απλοποιηθεί σε αυτή ενός µονοεπίπεδου perceptron Η χρήση της λογιστικής συνάρτησης στη δραστηριοποίηση έχει και βιολογικά κίνητρα, µιας και προσοµοιάζει την επίµονη φάση (refractory phase) των πραγµατικών νευρώνων ηµειώνεται επίσης το σηµαντικό χαρακτηριστικό των πραγµατικών βιολογικών νευρώνων, ότι δεν έχουν ψηφιακές (δυαδικές) εξόδους, αλλά η έξοδος τους έχει συνεχώς κάποια τιµή (συρµός από ώσεις) MLP και BP Η κατανεµηµένη µορφή της µη-γραµµικότητας και η υψηλή διασύνδεση του δικτύου κάνουν την θεωρητική ανάλυση ενός MLP εξαιρετικά δύσκολη Επίσης, η χρήση κρυµµένων νευρώνων κάνει την διαδικασία µάθησης δύσκολη, και δυσνόητη O αλγόριθµος BP είναι ένας γρήγορος τρόπος για τη µάθηση τέτοιων νευρωνικών δικτύων, όπου βοηθά στη κατανοµή της αναγκαίας διόρθωσης στους κρυµµένους νευρώνες, ώστε το συνολικό σφάλµα να µειώνεται σταδιακά

37 MLP και BP O κλασσικός αλγόριθµος BP εφαρµόζεται σε πολυεπίπεδα δίκτυα που έχουν ένα ή περισσότερα κρυµµένα επίπεδα, που είναι πλήρως συνδεδεµένα Οι υπολογισµοί από την είσοδο προς την έξοδο, λέγονται συνήθως σήµατα ενεργοποίησης ή συναρτησιακά σήµατα (function signals), ή σήµατα δραστηριοποίησης, ενώ τα σήµατα που στέλλονται πίσω για να διορθώσουν τα βάρη λέγονται σήµατα διόρθωσης βαρών (error correction signals) ή ανατροφοδότησης (feedback signals) Έρευνες έδειξαν ότι δύο κρυµµένα επίπεδα µε λογιστικήσιγµοειδή δραστηριοποίηση, είναι αρκετό για να επιλύσει τα πλείστα µη- γραµµικά προβλήµατα απεικόνισης εισόδουεξόδου (Kolmogorov, White, Hecht- Nielsen) Ηπρώτη εργασία έγινε από τον Paul Werbos* το 974 στο διδακτορικό του Ακολούθως ξανα-ανακαλύφθηκε από τον Parker το 982, και από τον LeCun σε παρόµοια µορφή το 985 Ο όρος BACKPROPAGATION καθιερώθηκε µε τη σηµαντικότατη εργασία των Rumelhart, Hinton και McClelland** το 986 ΟΑλγόριθµος BP Paul Werbos *Werbos P (974) Beyond regression: New tools for prediction and analysis in the behavioral sciences Ph D Dissertation Harvard University ** Rumelhart D E, Hinton G E and McClelland J L (986) In McClelland J L, Rumelhart D E and the PDP Research Group (Eds) Parallel Dis-tributed Processing: Explorations in the Microstructure of Cognition Vol Foundations Cambridge, MA: MIT Press

38 ΟΑλγόριθµος BP Ουσιαστικά ο αλγόριθµος ψάχνει και βρίσκει ένα καλό σύνολο από βάρη w ώστε το δίκτυο να κάνει ικανοποιητικά την αντιστοίχηση (mapping) R Nx R Mx Είναι µια µορφή βελτιστοποίησης χωρίς περιορισµούς (unconstrained optimization) υνήθως οργανώνονται δύο περάσµατα H ενεργοποίηση από την είσοδο στην έξοδο, και η ανατροφοδότηση (πισωδιάδοση) από το σφάλµα στις διορθώσεις των βαρών Μετά τη µάθηση, τα βάρη «παγώνουν» καιτοδίκτυοεφαρµόζει την αντιστοίχηση για διάγνωση, κατηγοριοποίηση, αναγνώριση προτύπων, κα ΟΑλγόριθµος BP Για ευκολία, θα αποφύγουµε τον αυτονόητο δείκτη κ, έχοντας υπόψη ότι w = w[κ+] - w[κ] Η διαδικασία βασίζεται στη µέθοδο ταχυτέρας καθόδου εφαρµοζόµενη σε σφάλµα Ε p για το δείγµα p (τοπικό σφάλµα): (p =,,P) Ep = d y = e 2 2 Νo Νo 2 2 ( jp jp, out ) jp j= j= Το συνολικό (global ή total) σφάλµα εκφράζεται ως: (428) E = E = d y = e P P Νo P Νo 2 2 p ( jp jp, out ) jp p p j= p j= τα αγγλικά είναι γνωστό σαν Sum Square Error (SSE) (429)

39 ΟΑλγόριθµος BP Θα παρουσιασθεί για αρχιτεκτονική 3 επιπέδων και ακολούθως θα γίνει γενίκευση σε πολλαπλά επίπεδα Ας δούµε πρώτα τους σχετικούς συµβολισµούς για το στάδιο της ενεργοποίησης (εµπρός-περάσµατος) (feedforward pass ή function signal pass) Επίπεδο Εισόδου x ο Κρυµµένο Επίπεδο 2 ο Κρυµµένο Επίπεδο Επίπεδο Εξόδου y x 2 y 2 x N y No

40 υναπτικά βάρη u Επίπεδο Εισόδου x Επίπεδο Εξόδου y x 2 a S() y 2 x N y No Επίπεδο Εισόδου x Κρυµµένο επίπεδο, µε n νευρώνες u [] a [] Κρυµµένο επίπεδο 2, µε n 2 νευρώνες u [2] f() [2] a [2] Κρυµµένο επίπεδο 3, µε No νευρώνες f() [3] Επίπεδο Εξόδου x 2 u [] 2 a [] 2 u [2] 2 a [2] 2 u [3] u [3] 2 y y 2 x N u [] n u [2] n2 a [2] n2 u [3] n0 f() [3] n0 a [] n yl = yl = f ( ul ) = f n2 ( a [3] wkl ) = f n2 ( f ( u [3] ) wkl ) = f n2 ( f n [] [2] ( aj w [3] ) wkl ) = out [ ] [3] [3] [3] [3] [2] [3] [2] [2] [3] [2] k jk l l l k k l k k k k j = = = = n2 n n2 n N [3] [2] [] [] [2] [3] [3] [2] [] [] [2] [3] ij jk kl l k j j jk kl l k j i k j = = k j i = = = = f ( f ( f ( u ) w ) w ) = f ( f ( f ( xw ) w ) w ) l =,, N o y No

41 ΟΑλγόριθµος BP: Υπολογισµοί ενεργοποίησης y = y = f ( u ) = [ out] [3] [3] [3] l l l l n2 n2 [3] [2] [3] [3] [2] [2] [3] l k kl l k k kl k= k= = f ( a w ) = f ( f ( u ) w ) = n2 n [3] [2] [] [2] [3] l k j jk kl k= j= = f ( f ( a w ) w ) = n2 n [3] [2] [] [] [2] [3] l k j j jk kl k= j= = f ( f ( f ( u ) w ) w ) = n n N [3] [2] [] [] [2] [3] l fk f j xw i ij wjk wkl k= j= i= = f ( 2 ( ( ) ) ) (430) Οπου, l =,, N o κ ο κ για MLP περισσότερων επιπέδων ΟΑλγόριθµος BP Υπολογισµοί Ενεργοποίησης - Γενική µορφή n L- u = a w [L] [L-] [L] j i ij i= (43) n L- y = f ( a w ) [L] [L] [L-] [L] j j i ij i= (432)

42 Ότι δεν θέλεις να σου κάνουν, µην κάνεις στους άλλους, Κονφούκιος Είσαι αυτά που γνωρίζεις, Albert Einstein ΟΠΟΥ ΑΤΟΧΗΕΙ ΓΥΡΙΕ, ΚΙ' ΟΠΟΥ ΠΕΤΥΧΕΙ ΦΥΓΕ, Λαϊκή ρήση από τη Κρήτη Πισωδιάδοση σφάλµατος υνήθως ακολουθείται µια από τις πιο κάτω εναλλακτικές τακτικές: α) Μάθηση ανά δείγµα (online learning) Η διόρθωση w L γίνεται µετά από κάθε δείγµα [ ] ij β) Μάθηση ανά οµάδα ή εποχή (batch ή epoch learning) Η διόρθωση συσσωρεύεται και γίνεται µετά που περνούν όλα τα δείγµατα

43 Πισωδιάδοση σφάλµατος Μάθηση ανά δείγµα (online learning) Η µάθηση βασίζεται στο τοπικό σφάλµα, E p Ας δούµε αναλυτικά τον αλγόριθµο για σύστηµα τριών επιπέδων: w E = η = ηδ a [3] p [3] [2] ij [3] j i wij (433) και δ f f [3] [3] [3] j j j = ejp = ( d ) [3] jp yjp [3] uj uj (434) Πισωδιάδοση σφάλµατος Μάθηση ανά δείγµα (online learning) w E = η = ηδ a [2] p [2] [] ij [2] j i wij (435) και δ f [2] n [2] j [3] [3] j = δ [2] i wij 3 u j i= (436)

44 Πισωδιάδοση σφάλµατος Μάθηση ανά δείγµα (online learning) w = ηδ x [] [] ij j i (437) και δ f [] n [] j [2] [2] j = δ [] i wij 2 u j i= (438) Πισωδιάδοση σφάλµατος Βήµατα στη µάθηση ανά δείγµα: Αρχικοποίησε τα συναπτικά βάρη w δίνοντας τους µικρές τυχαίες τιµές 2 Εφάρµοσε ένα δείγµα µάθησης x στην είσοδο, από το ζεύγος δείγµατος µάθησης (x, d), και υπολόγισε την έξοδο y µε βάση την τρέχουσα τιµή των w, χρησιµοποιώντας τις εξισώσεις (43) και (432) 3 Χρησιµοποιώντας τις τιµές της επιθυµητής εξόδου d, υπολόγισε τα τοπικά σφάλµατα δ j [L] από τις (434), (436) και (438) 4 ιόρθωσε τα βάρη w ij [L] για L=,2,3 σύµφωνα µε την εξίσωση: w ij [L] = ηδ j [L] x i [L] 5 Επανάλαβε από το βήµα 2, εφαρµόζωντας νέο δείγµα, µέχρι το σφάλµα να πάρει ικανοποιητική τιµή, και τα βάρη να σταθεροποιηθούν

45 BP µε συντελεστή ορµής Για να έχουµε ευσταθή µάθηση χρειάζεται να χρησιµοποιήσουµε µικρή τιµή του συντελεστή µάθησης η Αυτό οδηγεί σε αργό ρυθµό µάθησης Επίσης, εάν υπάρχουν τοπικά ελάχιστα, τα βάρη θα µπορούσαν να περιοριστούν γύρω από τέτοιο ελάχιστο Ένας τρόπος που χρησιµοποιείται για αποφυγή αυτών των προβληµάτων είναι η χρήση ενός συντελεστή ορµής µ (momentum fficient) όπως πιο κάτω: w [ κ] = ηδ a + µ w [ κ ] [ L ] [ L ] [ L- ] [ L ] ij j i ij (439) ή w [ κ + ] = w [ κ] + w [ κ] [ L] [ L] [ L] ij ij ij Όπου η > 0 και 0 µ < (440)

46 BP - Γενικό σχόλιο Με τα προηγούµενα, φαίνεται ότι η µέθοδος αυτή, όπως και οι πλείστες παρόµοιες, δουλεύουν όπως και οι στατιστικές πολυπαραµετρικές µέθοδοι για παλινδροµική προσέγγιση ενός υπερεπιπέδου στον πολυδιάστατο χώρο, όπου η προσέγγιση γίνεται µε παραδείγµατα (Multidimensional curve fitting) Πισωδιάδοση σφάλµατος Μάθηση ανά οµάδα (Batch processing) ε αυτή τη τακτική, το τοπικό σφάλµα E p συσσωρεύεται για µερικά δείγµατα (συνήθως για όλα) και ακολούθως γίνεται η διόρθωση των σφαλµάτων Ο απλός αλγόριθµος σε αυτή τη περίπτωση γίνεται: [ ] [ ] E [ ] [ ] w L ij = pw L ij = η = η δ [ ] L jp a L- L ip (44) w p ij Μια πιο περίπλοκη µορφή αλλά πιο διαδεδοµένη είναι: η w [ κ] = δ a + µ w [ κ ] γ w [ κ] (442) [L] [L] [L-] [L] [L] ij jp ip ij ij nl- p Όπου γ είναι ένας συντελεστής απόσβεσης (decay factor) p

47 ΕΠΛ 604 Τεχνητή Νοηµοσύνη ***************** Τέλος στα MLP και BP Κώστας Νεοκλέους, PhD Τηλέφωνο Γραφείου:

Μοντέλο Perceptron πολλών στρωμάτων Multi Layer Perceptron (MLP)

Μοντέλο Perceptron πολλών στρωμάτων Multi Layer Perceptron (MLP) x -0,5 a x x 2 0 0 0 0 - -0,5 y y 0 0 x 2 -,5 a 2 θ η τιμή κατωφλίου Μία λύση του προβλήματος XOR Multi Layer Perceptron (MLP) x -0,5 Μία

Μοντέλο Perceptron πολλών στρωμάτων Multi Layer Perceptron (MLP) x -0,5 a x x 2 0 0 0 0 - -0,5 y y 0 0 x 2 -,5 a 2 θ η τιμή κατωφλίου Μία λύση του προβλήματος XOR Multi Layer Perceptron (MLP) x -0,5 Μία

Νευρωνικά ίκτυα. Σηµερινό Μάθηµα

Νευρωνικά ίκτυα Σηµερινό Μάθηµα Perceptron (Αισθητήρας) Aλγόριθµος µάθησης του Perceptron Οι εξισώσεις των Wiener-Hopf Μέθοδος Ταχύτερης Καθόδου (Steepest Descent) Οαλγόριθµος Ελάχιστου Μέσου Τετραγωνικού

Νευρωνικά ίκτυα Σηµερινό Μάθηµα Perceptron (Αισθητήρας) Aλγόριθµος µάθησης του Perceptron Οι εξισώσεις των Wiener-Hopf Μέθοδος Ταχύτερης Καθόδου (Steepest Descent) Οαλγόριθµος Ελάχιστου Μέσου Τετραγωνικού

Το μοντέλο Perceptron

Το μοντέλο Perceptron Αποτελείται από έναν μόνο νευρώνα McCulloch-Pitts w j x x 1, x2,..., w x T 1 1 x 2 w 2 Σ u x n f(u) Άνυσμα Εισόδου s i x j x n w n -θ w w 1, w2,..., w n T Άνυσμα Βαρών 1 Το μοντέλο

Το μοντέλο Perceptron Αποτελείται από έναν μόνο νευρώνα McCulloch-Pitts w j x x 1, x2,..., w x T 1 1 x 2 w 2 Σ u x n f(u) Άνυσμα Εισόδου s i x j x n w n -θ w w 1, w2,..., w n T Άνυσμα Βαρών 1 Το μοντέλο

Το Πολυεπίπεδο Perceptron. "Τεχνητά Νευρωνικά Δίκτυα" (Διαφάνειες), Α. Λύκας, Παν. Ιωαννίνων

Το Πολυ Perceptron Δίκτυα Πρόσθιας Τροφοδότησης (feedforward) Tο αντίστοιχο γράφημα του δικτύου δεν περιλαμβάνει κύκλους: δεν υπάρχει δηλαδή ανατροφοδότηση της εξόδου ενός νευρώνα προς τους νευρώνες από

Το Πολυ Perceptron Δίκτυα Πρόσθιας Τροφοδότησης (feedforward) Tο αντίστοιχο γράφημα του δικτύου δεν περιλαμβάνει κύκλους: δεν υπάρχει δηλαδή ανατροφοδότηση της εξόδου ενός νευρώνα προς τους νευρώνες από

3. O ΑΛΓΟΡΙΘΜΟΣ ΤΟΥ PERCEPTRON

3. O ΑΛΓΟΡΙΘΜΟΣ ΤΟΥ PERCEPRON 3. ΕΙΣΑΓΩΓΗ: Το Perceptron είναι η απλούστερη μορφή Νευρωνικού δικτύου, το οποίο χρησιμοποιείται για την ταξινόμηση ενός ειδικού τύπου προτύπων, που είναι γραμμικά διαχωριζόμενα.

3. O ΑΛΓΟΡΙΘΜΟΣ ΤΟΥ PERCEPRON 3. ΕΙΣΑΓΩΓΗ: Το Perceptron είναι η απλούστερη μορφή Νευρωνικού δικτύου, το οποίο χρησιμοποιείται για την ταξινόμηση ενός ειδικού τύπου προτύπων, που είναι γραμμικά διαχωριζόμενα.

HMY 795: Αναγνώριση Προτύπων. Διαλέξεις 15-16

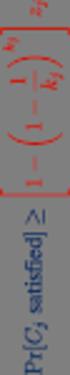

HMY 795: Αναγνώριση Προτύπων Διαλέξεις 15-16 Νευρωνικά Δίκτυα(Neural Networks) Fisher s linear discriminant: Μείωση διαστάσεων (dimensionality reduction) y Τ =w x s + s =w S w 2 2 Τ 1 2 W ( ) 2 2 ( ) m2

HMY 795: Αναγνώριση Προτύπων Διαλέξεις 15-16 Νευρωνικά Δίκτυα(Neural Networks) Fisher s linear discriminant: Μείωση διαστάσεων (dimensionality reduction) y Τ =w x s + s =w S w 2 2 Τ 1 2 W ( ) 2 2 ( ) m2

Βέλτιστα Ψηφιακά Φίλτρα: Φίλτρα Wiener, Ευθεία και αντίστροφη γραµµική πρόβλεψη

ΒΕΣ 6 Προσαρµοστικά Συστήµατα στις Τηλεπικοινωνίες Βέλτιστα Ψηφιακά Φίλτρα: Φίλτρα Wiener, Ευθεία και αντίστροφη γραµµική πρόβλεψη 7 Nicolas sapatsoulis Βιβλιογραφία Ενότητας Benvenuto []: Κεφάλαιo Wirow

ΒΕΣ 6 Προσαρµοστικά Συστήµατα στις Τηλεπικοινωνίες Βέλτιστα Ψηφιακά Φίλτρα: Φίλτρα Wiener, Ευθεία και αντίστροφη γραµµική πρόβλεψη 7 Nicolas sapatsoulis Βιβλιογραφία Ενότητας Benvenuto []: Κεφάλαιo Wirow

ΤΜΗΜΑ ΔΙΟΙΚΗΣΗΣ ΕΠΙΧΕΙΡΗΣΕΩΝ

ΤΕΙ Δυτικής Μακεδονίας ΤΜΗΜΑ ΔΙΟΙΚΗΣΗΣ ΕΠΙΧΕΙΡΗΣΕΩΝ 2015-2016 Τεχνητή Νοημοσύνη Νευρώνας Perceptron Διδάσκων: Τσίπουρας Μάρκος Εκπαιδευτικό Υλικό: Τσίπουρας Μάρκος Τζώρτζης Γρηγόρης Περιεχόμενα Εισαγωγή

ΤΕΙ Δυτικής Μακεδονίας ΤΜΗΜΑ ΔΙΟΙΚΗΣΗΣ ΕΠΙΧΕΙΡΗΣΕΩΝ 2015-2016 Τεχνητή Νοημοσύνη Νευρώνας Perceptron Διδάσκων: Τσίπουρας Μάρκος Εκπαιδευτικό Υλικό: Τσίπουρας Μάρκος Τζώρτζης Γρηγόρης Περιεχόμενα Εισαγωγή

ΠΑΝΕΠΙΣΤΗΜΙΟΥ ΠΑΤΡΩΝ ΕΚΠΑΙ ΕΥΣΗΣ ΑΠΟ ΑΠΟΣΤΑΣΗ

ΠΑΝΕΠΙΣΤΗΜΙΟ ΠΑΤΡΩΝ ΠΡΟΓΡΑΜΜΑ ΣΠΟΥ ΩΝ ΕΚΠΑΙ ΕΥΣΗΣ ΑΠΟ ΑΠΟΣΤΑΣΗ ΠΡΟΓΡΑΜΜΑ ΣΠΟΥ ΩΝ ΘΕΜΑΤΙΚΗ ΕΝΟΤΗΤΑ P-INF-003 : ΠΛΗΡΟΦΟΡΙΚΗ : ΝΕΥΡΩΝΙΚΑ ΙΚΤΥΑ ΚΑΙ ΓΕΝΕΤΙΚΟΙ ΑΛΓΟΡΙΘΜΟΙ ΕΚΠΑΙ ΕΥΤΙΚΟ ΥΛΙΚΟ ΤΡΙΤΟ ΚΕΦΑΛΑΙΟ ΣΥΓΓΡΑΦΕΙΣ

ΠΑΝΕΠΙΣΤΗΜΙΟ ΠΑΤΡΩΝ ΠΡΟΓΡΑΜΜΑ ΣΠΟΥ ΩΝ ΕΚΠΑΙ ΕΥΣΗΣ ΑΠΟ ΑΠΟΣΤΑΣΗ ΠΡΟΓΡΑΜΜΑ ΣΠΟΥ ΩΝ ΘΕΜΑΤΙΚΗ ΕΝΟΤΗΤΑ P-INF-003 : ΠΛΗΡΟΦΟΡΙΚΗ : ΝΕΥΡΩΝΙΚΑ ΙΚΤΥΑ ΚΑΙ ΓΕΝΕΤΙΚΟΙ ΑΛΓΟΡΙΘΜΟΙ ΕΚΠΑΙ ΕΥΤΙΚΟ ΥΛΙΚΟ ΤΡΙΤΟ ΚΕΦΑΛΑΙΟ ΣΥΓΓΡΑΦΕΙΣ

4.3. Γραµµικοί ταξινοµητές

Γραµµικοί ταξινοµητές Γραµµικός ταξινοµητής είναι ένα σύστηµα ταξινόµησης που χρησιµοποιεί γραµµικές διακριτικές συναρτήσεις Οι ταξινοµητές αυτοί αναπαρίστανται συχνά µε οµάδες κόµβων εντός των οποίων

Γραµµικοί ταξινοµητές Γραµµικός ταξινοµητής είναι ένα σύστηµα ταξινόµησης που χρησιµοποιεί γραµµικές διακριτικές συναρτήσεις Οι ταξινοµητές αυτοί αναπαρίστανται συχνά µε οµάδες κόµβων εντός των οποίων

ΣΤΟΧΑΣΤΙΚΑ ΣΗΜΑΤΑ ΚΑΙ ΕΦΑΡΜΟΓΕΣ

ΣΤΟΧΑΣΤΙΚΑ ΣΗΜΑΤΑ ΚΑΙ ΕΦΑΡΜΟΓΕΣ Ακαδηµαϊκό Έτος 007-008 ιδάσκων: Ν. Παπανδρέου (Π.. 407/80) Πανεπιστήµιο Πατρών Τµήµα Μηχανικών Ηλεκτρονικών Υπολογιστών και Πληροφορικής 1η Εργαστηριακή Άσκηση Αναγνώριση

ΣΤΟΧΑΣΤΙΚΑ ΣΗΜΑΤΑ ΚΑΙ ΕΦΑΡΜΟΓΕΣ Ακαδηµαϊκό Έτος 007-008 ιδάσκων: Ν. Παπανδρέου (Π.. 407/80) Πανεπιστήµιο Πατρών Τµήµα Μηχανικών Ηλεκτρονικών Υπολογιστών και Πληροφορικής 1η Εργαστηριακή Άσκηση Αναγνώριση

Μη γραµµικοί ταξινοµητές Νευρωνικά ίκτυα

KEΣ 3 Αναγνώριση Προτύπων και Ανάλυση Εικόνας Μη γραµµικοί ταξινοµητές Νευρωνικά ίκτυα ΤµήµαΕπιστήµης και Τεχνολογίας Τηλεπικοινωνιών Πανεπιστήµιο Πελοποννήσου Εισαγωγή Πολυεπίπεδες Perceptron Οαλγόριθµος

KEΣ 3 Αναγνώριση Προτύπων και Ανάλυση Εικόνας Μη γραµµικοί ταξινοµητές Νευρωνικά ίκτυα ΤµήµαΕπιστήµης και Τεχνολογίας Τηλεπικοινωνιών Πανεπιστήµιο Πελοποννήσου Εισαγωγή Πολυεπίπεδες Perceptron Οαλγόριθµος

Ακαδηµαϊκό Έτος , Εαρινό Εξάµηνο ιδάσκων Καθ.: Νίκος Τσαπατσούλης

ΠΑΝΕΠΙΣΤΗΜΙΟ ΠΕΛΟΠΟΝΝΗΣΟΥ, ΤΜΗΜΑ ΤΕΧΝΟΛΟΓΙΑΣ ΤΗΛΕΠΙΚΟΙΝΩΝΙΩΝ ΒΕΣ 6: ΠΡΟΣΑΡΜΟΣΤΙΚΑ ΣΥΣΤΗΜΑΤΑ ΣΤΙΣ ΤΗΛΕΠΙΚΟΙΝΩΝΙΕΣ Ακαδηµαϊκό Έτος 26 27, Εαρινό Εξάµηνο Καθ.: Νίκος Τσαπατσούλης ΕΡΩΤΗΣΕΙΣ ΓΙΑ ΕΠΑΝΑΛΗΨΗ Το

ΠΑΝΕΠΙΣΤΗΜΙΟ ΠΕΛΟΠΟΝΝΗΣΟΥ, ΤΜΗΜΑ ΤΕΧΝΟΛΟΓΙΑΣ ΤΗΛΕΠΙΚΟΙΝΩΝΙΩΝ ΒΕΣ 6: ΠΡΟΣΑΡΜΟΣΤΙΚΑ ΣΥΣΤΗΜΑΤΑ ΣΤΙΣ ΤΗΛΕΠΙΚΟΙΝΩΝΙΕΣ Ακαδηµαϊκό Έτος 26 27, Εαρινό Εξάµηνο Καθ.: Νίκος Τσαπατσούλης ΕΡΩΤΗΣΕΙΣ ΓΙΑ ΕΠΑΝΑΛΗΨΗ Το

Μέθοδοι Μηχανών Μάθησης για Ευφυή Αναγνώριση και ιάγνωση Ιατρικών εδοµένων

Μέθοδοι Μηχανών Μάθησης για Ευφυή Αναγνώριση και ιάγνωση Ιατρικών εδοµένων Εισηγητής: ρ Ηλίας Ζαφειρόπουλος Εισαγωγή Ιατρικά δεδοµένα: Συλλογή Οργάνωση Αξιοποίηση Data Mining ιαχείριση εδοµένων Εκπαίδευση

Μέθοδοι Μηχανών Μάθησης για Ευφυή Αναγνώριση και ιάγνωση Ιατρικών εδοµένων Εισηγητής: ρ Ηλίας Ζαφειρόπουλος Εισαγωγή Ιατρικά δεδοµένα: Συλλογή Οργάνωση Αξιοποίηση Data Mining ιαχείριση εδοµένων Εκπαίδευση

Ασκήσεις Φροντιστηρίου «Υπολογιστική Νοημοσύνη Ι» 4 o Φροντιστήριο

Ασκήσεις Φροντιστηρίου 4 o Φροντιστήριο Πρόβλημα 1 ο Ο πίνακας συσχέτισης R x του διανύσματος εισόδου x( στον LMS αλγόριθμο 1 0.5 R x = ορίζεται ως: 0.5 1. Ορίστε το διάστημα των τιμών της παραμέτρου μάθησης

Ασκήσεις Φροντιστηρίου 4 o Φροντιστήριο Πρόβλημα 1 ο Ο πίνακας συσχέτισης R x του διανύσματος εισόδου x( στον LMS αλγόριθμο 1 0.5 R x = ορίζεται ως: 0.5 1. Ορίστε το διάστημα των τιμών της παραμέτρου μάθησης

Βασικές αρχές εκπαίδευσης ΤΝΔ: το perceptron. "Τεχνητά Νευρωνικά Δίκτυα" (Διαφάνειες), Α. Λύκας, Παν. Ιωαννίνων

Βασικές αρχές εκπαίδευσης ΤΝΔ: το perceptron Βιολογικός Νευρώνας Δενδρίτες, που αποτελούν τις γραμμές εισόδου των ερεθισμάτων (βιολογικών σημάτων) Σώμα, στο οποίο γίνεται η συσσώρευση των ερεθισμάτων και

Βασικές αρχές εκπαίδευσης ΤΝΔ: το perceptron Βιολογικός Νευρώνας Δενδρίτες, που αποτελούν τις γραμμές εισόδου των ερεθισμάτων (βιολογικών σημάτων) Σώμα, στο οποίο γίνεται η συσσώρευση των ερεθισμάτων και

Προσαρµοστικοί Αλγόριθµοι Υλοποίησης Βέλτιστων Ψηφιακών Φίλτρων: Ο αναδροµικός αλγόριθµος ελάχιστων τετραγώνων (RLS Recursive Least Squares)

ΒΕΣ 6 Προσαρµοστικά Συστήµατα στις Τηλεπικοινωνίες Προσαρµοστικοί Αλγόριθµοι Υλοποίησης Βέλτιστων Ψηφιακών Φίλτρων: Ο αναδροµικός αλγόριθµος ελάχιστων τετραγώνων RLS Rcrsiv Last Sqars 27 iclas sapatslis

ΒΕΣ 6 Προσαρµοστικά Συστήµατα στις Τηλεπικοινωνίες Προσαρµοστικοί Αλγόριθµοι Υλοποίησης Βέλτιστων Ψηφιακών Φίλτρων: Ο αναδροµικός αλγόριθµος ελάχιστων τετραγώνων RLS Rcrsiv Last Sqars 27 iclas sapatslis

Kalman Filter Γιατί ο όρος φίλτρο;

Kalman Filter Γιατί ο όρος φίλτρο; Συνήθως ο όρος φίλτρο υποδηλώνει µια διαδικασία αποµάκρυνσης µη επιθυµητών στοιχείων Απότολατινικόόροfelt : το υλικό για το φιλτράρισµα υγρών Στη εποχή των ραδιολυχνίων:

Kalman Filter Γιατί ο όρος φίλτρο; Συνήθως ο όρος φίλτρο υποδηλώνει µια διαδικασία αποµάκρυνσης µη επιθυµητών στοιχείων Απότολατινικόόροfelt : το υλικό για το φιλτράρισµα υγρών Στη εποχή των ραδιολυχνίων:

Πανεπιστήµιο Κύπρου Πολυτεχνική Σχολή

Πανεπιστήµιο Κύπρου Πολυτεχνική Σχολή Τµήµα Ηλεκτρολόγων Μηχανικών και Μηχανικών Υπολογιστών ΗΜΜΥ 795: ΑΝΑΓΝΩΡΙΣΗ ΠΡΟΤΥΠΩΝ Ακαδηµαϊκό έτος 2010-11 Χειµερινό Εξάµηνο Τελική εξέταση Τρίτη, 21 εκεµβρίου 2010,

Πανεπιστήµιο Κύπρου Πολυτεχνική Σχολή Τµήµα Ηλεκτρολόγων Μηχανικών και Μηχανικών Υπολογιστών ΗΜΜΥ 795: ΑΝΑΓΝΩΡΙΣΗ ΠΡΟΤΥΠΩΝ Ακαδηµαϊκό έτος 2010-11 Χειµερινό Εξάµηνο Τελική εξέταση Τρίτη, 21 εκεµβρίου 2010,

Εισαγωγή στα Προσαρµοστικά Συστήµατα

ΒΕΣ 06 Προσαρµοστικά Συστήµατα στις Τηλεπικοινωνίες Εισαγωγή στα Προσαρµοστικά Συστήµατα Νικόλας Τσαπατσούλης Επίκουρος Καθηγητής Π..407/80 Τµήµα Επιστήµη και Τεχνολογίας Τηλεπικοινωνιών Πανεπιστήµιο Πελοποννήσου

ΒΕΣ 06 Προσαρµοστικά Συστήµατα στις Τηλεπικοινωνίες Εισαγωγή στα Προσαρµοστικά Συστήµατα Νικόλας Τσαπατσούλης Επίκουρος Καθηγητής Π..407/80 Τµήµα Επιστήµη και Τεχνολογίας Τηλεπικοινωνιών Πανεπιστήµιο Πελοποννήσου

οµή δικτύου ΣΧΗΜΑ 8.1

8. ίκτυα Kohonen Το µοντέλο αυτό των δικτύων προτάθηκε το 1984 από τον Kοhonen, και αφορά διαδικασία εκµάθησης χωρίς επίβλεψη, δηλαδή δεν δίδεται καµία εξωτερική επέµβαση σχετικά µε τους στόχους που πρέπει

8. ίκτυα Kohonen Το µοντέλο αυτό των δικτύων προτάθηκε το 1984 από τον Kοhonen, και αφορά διαδικασία εκµάθησης χωρίς επίβλεψη, δηλαδή δεν δίδεται καµία εξωτερική επέµβαση σχετικά µε τους στόχους που πρέπει

ΕΡΩΤΗΜΑΤΑ σε ΝΕΥΡΩΝΙΚΑ

ηµήτρης Ψούνης ΠΛΗ3, Απαντήσεις Quiz σε ΝΕΥΡΩΝΙΚΑ ΙΚΤΥΑ ΕΡΩΤΗΜΑΤΑ σε ΝΕΥΡΩΝΙΚΑ Μάθηµα 3. ΕΡΩΤΗΜΑ Ένας αισθητήρας µπορεί να µάθει: a. εδοµένα που ανήκουν σε 5 διαφορετικές κλάσεις. b. εδοµένα που ανήκουν

ηµήτρης Ψούνης ΠΛΗ3, Απαντήσεις Quiz σε ΝΕΥΡΩΝΙΚΑ ΙΚΤΥΑ ΕΡΩΤΗΜΑΤΑ σε ΝΕΥΡΩΝΙΚΑ Μάθηµα 3. ΕΡΩΤΗΜΑ Ένας αισθητήρας µπορεί να µάθει: a. εδοµένα που ανήκουν σε 5 διαφορετικές κλάσεις. b. εδοµένα που ανήκουν

Ασκήσεις μελέτης της 19 ης διάλεξης

Οικονομικό Πανεπιστήμιο Αθηνών, Τμήμα Πληροφορικής Μάθημα: Τεχνητή Νοημοσύνη, 2016 17 Διδάσκων: Ι. Ανδρουτσόπουλος Ασκήσεις μελέτης της 19 ης διάλεξης 19.1. Δείξτε ότι το Perceptron με (α) συνάρτηση ενεργοποίησης

Οικονομικό Πανεπιστήμιο Αθηνών, Τμήμα Πληροφορικής Μάθημα: Τεχνητή Νοημοσύνη, 2016 17 Διδάσκων: Ι. Ανδρουτσόπουλος Ασκήσεις μελέτης της 19 ης διάλεξης 19.1. Δείξτε ότι το Perceptron με (α) συνάρτηση ενεργοποίησης

Τμήμα Μηχανικών Η/Υ και Πληροφορικής

Τμήμα Μηχανικών Η/Υ και Πληροφορικής Εργαστήριο Επεξεργασίας Σημάτων και Τηλεπικοινωνιών Κινητά Δίκτυα Επικοινωνιών Μέρος Α: Τηλεπικοινωνιακά Θέματα: Τεχνικές Ισοστάθμισης Διαύλου Βασικές αρχές Ισοστάθμισης

Τμήμα Μηχανικών Η/Υ και Πληροφορικής Εργαστήριο Επεξεργασίας Σημάτων και Τηλεπικοινωνιών Κινητά Δίκτυα Επικοινωνιών Μέρος Α: Τηλεπικοινωνιακά Θέματα: Τεχνικές Ισοστάθμισης Διαύλου Βασικές αρχές Ισοστάθμισης

ΠΑΝΕΠΙΣΤΗΜΙΟ ΜΑΚΕ ΟΝΙΑΣ ΟΙΚΟΝΟΜΙΚΩΝ ΚΑΙ ΚΟΙΝΩΝΙΚΩΝ ΕΠΙΣΤΗΜΩΝ ΤΜΗΜΑ ΕΦΑΡΜΟΣΜΕΝΗΣ ΠΛΗΡΟΦΟΡΙΚΗΣ ΝΕΥΡΩΝΙΚΑ ΙΚΤΥΑ

ΘΕΜΑ ο 2.5 µονάδες ΠΑΝΕΠΙΣΤΗΜΙΟ ΜΑΚΕ ΟΝΙΑΣ ΟΙΚΟΝΟΜΙΚΩΝ ΚΑΙ ΚΟΙΝΩΝΙΚΩΝ ΕΠΙΣΤΗΜΩΝ ΤΜΗΜΑ ΕΦΑΡΜΟΣΜΕΝΗΣ ΠΛΗΡΟΦΟΡΙΚΗΣ ΝΕΥΡΩΝΙΚΑ ΙΚΤΥΑ Τελικές εξετάσεις 2 Σεπτεµβρίου 2005 5:00-8:00 Σχεδιάστε έναν αισθητήρα ercetro

ΘΕΜΑ ο 2.5 µονάδες ΠΑΝΕΠΙΣΤΗΜΙΟ ΜΑΚΕ ΟΝΙΑΣ ΟΙΚΟΝΟΜΙΚΩΝ ΚΑΙ ΚΟΙΝΩΝΙΚΩΝ ΕΠΙΣΤΗΜΩΝ ΤΜΗΜΑ ΕΦΑΡΜΟΣΜΕΝΗΣ ΠΛΗΡΟΦΟΡΙΚΗΣ ΝΕΥΡΩΝΙΚΑ ΙΚΤΥΑ Τελικές εξετάσεις 2 Σεπτεµβρίου 2005 5:00-8:00 Σχεδιάστε έναν αισθητήρα ercetro

Νευρωνικά ίκτυα και Εξελικτικός. Σηµερινό Μάθηµα. επανάληψη Γενετικών Αλγορίθµων 1 η εργασία Επανάληψη νευρωνικών δικτύων Ασκήσεις εφαρµογές

Νευρωνικά ίκτυα και Εξελικτικός Προγραµµατισµός Σηµερινό Μάθηµα επανάληψη Γενετικών Αλγορίθµων η εργασία Επανάληψη νευρωνικών δικτύων Ασκήσεις εφαρµογές Κωδικοποίηση Αντικειµενική Συνάρτ Αρχικοποίηση Αξιολόγηση

Νευρωνικά ίκτυα και Εξελικτικός Προγραµµατισµός Σηµερινό Μάθηµα επανάληψη Γενετικών Αλγορίθµων η εργασία Επανάληψη νευρωνικών δικτύων Ασκήσεις εφαρµογές Κωδικοποίηση Αντικειµενική Συνάρτ Αρχικοποίηση Αξιολόγηση

Κινητά Δίκτυα Επικοινωνιών. Συμπληρωματικό υλικό. Προσαρμοστική Ισοστάθμιση Καναλιού

Κινητά Δίκτυα Επικοινωνιών Συμπληρωματικό υλικό Προσαρμοστική Ισοστάθμιση Καναλιού Προσαρμοστικοί Ισοσταθμιστές Για να υπολογίσουμε τους συντελεστές του ισοσταθμιστή MMSE, απαιτείται να λύσουμε ένα γραμμικό

Κινητά Δίκτυα Επικοινωνιών Συμπληρωματικό υλικό Προσαρμοστική Ισοστάθμιση Καναλιού Προσαρμοστικοί Ισοσταθμιστές Για να υπολογίσουμε τους συντελεστές του ισοσταθμιστή MMSE, απαιτείται να λύσουμε ένα γραμμικό

Στοχαστικά Σήματα και Τηλεπικοινωνιές

Στοχαστικά Σήματα και Τηλεπικοινωνιές Ενότητα 4: Βέλτιστα Φίλτρα Wiener Καθηγητής Κώστας Μπερμπερίδης Πολυτεχνική Σχολή Τμήμα Μηχανικών Η/Υ και Πληροφορικής Σκοποί ενότητας Παρουσίαση βασικών εννοιών των

Στοχαστικά Σήματα και Τηλεπικοινωνιές Ενότητα 4: Βέλτιστα Φίλτρα Wiener Καθηγητής Κώστας Μπερμπερίδης Πολυτεχνική Σχολή Τμήμα Μηχανικών Η/Υ και Πληροφορικής Σκοποί ενότητας Παρουσίαση βασικών εννοιών των

Εκπαίδευση ΤΝΔ με ελαχιστοποίηση του τετραγωνικού σφάλματος εκπαίδευσης. "Τεχνητά Νευρωνικά Δίκτυα" (Διαφάνειες), Α. Λύκας, Παν.

Εκπαίδευση ΤΝΔ με ελαχιστοποίηση του τετραγωνικού σφάλματος εκπαίδευσης Ελαχιστοποίηση συνάρτησης σφάλματος Εκπαίδευση ΤΝΔ: μπορεί να διατυπωθεί ως πρόβλημα ελαχιστοποίησης μιας συνάρτησης σφάλματος E(w)

Εκπαίδευση ΤΝΔ με ελαχιστοποίηση του τετραγωνικού σφάλματος εκπαίδευσης Ελαχιστοποίηση συνάρτησης σφάλματος Εκπαίδευση ΤΝΔ: μπορεί να διατυπωθεί ως πρόβλημα ελαχιστοποίησης μιας συνάρτησης σφάλματος E(w)

ΧΑΡΟΚΟΠΕΙΟ ΠΑΝΕΠΙΣΤΗΜΙΟ ΑΘΗΝΩΝ ΤΜΗΜΑ ΠΛΗΡΟΦΟΡΙΚΗΣ & ΤΗΛΕΜΑΤΙΚΗΣ ΤΕΧΝΗΤΗ ΝΟΗΜΟΣΥΝΗ ΝΕΥΡΩΝΙΚΑ ΔΙΚΤΥΑ. Καραγιώργου Σοφία

ΧΑΡΟΚΟΠΕΙΟ ΠΑΝΕΠΙΣΤΗΜΙΟ ΑΘΗΝΩΝ ΤΜΗΜΑ ΠΛΗΡΟΦΟΡΙΚΗΣ & ΤΗΛΕΜΑΤΙΚΗΣ ΤΕΧΝΗΤΗ ΝΟΗΜΟΣΥΝΗ ΝΕΥΡΩΝΙΚΑ ΔΙΚΤΥΑ Καραγιώργου Σοφία Εισαγωγή Προσομοιώνει βιολογικές διεργασίες (π.χ. λειτουργία του εγκεφάλου, διαδικασία

ΧΑΡΟΚΟΠΕΙΟ ΠΑΝΕΠΙΣΤΗΜΙΟ ΑΘΗΝΩΝ ΤΜΗΜΑ ΠΛΗΡΟΦΟΡΙΚΗΣ & ΤΗΛΕΜΑΤΙΚΗΣ ΤΕΧΝΗΤΗ ΝΟΗΜΟΣΥΝΗ ΝΕΥΡΩΝΙΚΑ ΔΙΚΤΥΑ Καραγιώργου Σοφία Εισαγωγή Προσομοιώνει βιολογικές διεργασίες (π.χ. λειτουργία του εγκεφάλου, διαδικασία

HMY 795: Αναγνώριση Προτύπων

HMY 795: Αναγνώριση Προτύπων Διαλέξεις 15 16 Λογιστική παλινδρόμηση (Logistic regression) Νευρωνικά Δίκτυα (Neural Networks) g ( x) = w x+ w T k k k0 1 ( T T WLS = X X) X T= X T Γραμμικές διαχωριστικές

HMY 795: Αναγνώριση Προτύπων Διαλέξεις 15 16 Λογιστική παλινδρόμηση (Logistic regression) Νευρωνικά Δίκτυα (Neural Networks) g ( x) = w x+ w T k k k0 1 ( T T WLS = X X) X T= X T Γραμμικές διαχωριστικές

Κεφάλαιο 2. Ιστορική αναδροµή

Κεφάλαιο 2. Ιστορική αναδροµή Σκοπός: Στο κεφάλαιο αυτό γίνεται µία σύντοµη ιστορική ανασκόπηση της περιοχής των νευρωνικών δικτύων. Παρουσιάζονται επιγραµµατικά τα έργα που σηµάδευσαν την περιοχή αυτή,

Κεφάλαιο 2. Ιστορική αναδροµή Σκοπός: Στο κεφάλαιο αυτό γίνεται µία σύντοµη ιστορική ανασκόπηση της περιοχής των νευρωνικών δικτύων. Παρουσιάζονται επιγραµµατικά τα έργα που σηµάδευσαν την περιοχή αυτή,

ΔΙΚΤΥO RBF. "Τεχνητά Νευρωνικά Δίκτυα" (Διαφάνειες), Α. Λύκας, Παν. Ιωαννίνων

ΔΙΚΤΥO RBF Αρχιτεκτονική δικτύου RBF Δίκτυα RBF: δίκτυα συναρτήσεων πυρήνα (radial basis function networks). Πρόσθιας τροφοδότησης (feedforward) για προβλήματα μάθησης με επίβλεψη. Εναλλακτικό του MLP.

ΔΙΚΤΥO RBF Αρχιτεκτονική δικτύου RBF Δίκτυα RBF: δίκτυα συναρτήσεων πυρήνα (radial basis function networks). Πρόσθιας τροφοδότησης (feedforward) για προβλήματα μάθησης με επίβλεψη. Εναλλακτικό του MLP.

4. Ο αισθητήρας (perceptron)

4. Ο αισθητήρας (perceptron) Σκοπός: Προσδοκώµενα αποτελέσµατα: Λέξεις Κλειδιά: To µοντέλο του αισθητήρα (perceptron) είναι από τα πρώτα µοντέλα νευρωνικών δικτύων που αναπτύχθηκαν, και έδωσαν µεγάλη ώθηση

4. Ο αισθητήρας (perceptron) Σκοπός: Προσδοκώµενα αποτελέσµατα: Λέξεις Κλειδιά: To µοντέλο του αισθητήρα (perceptron) είναι από τα πρώτα µοντέλα νευρωνικών δικτύων που αναπτύχθηκαν, και έδωσαν µεγάλη ώθηση

Γραµµικοί Ταξινοµητές

ΚΕΣ 3: Αναγνώριση Προτύπων και Ανάλυση Εικόνας KEΣ 3 Αναγνώριση Προτύπων και Ανάλυση Εικόνας Γραµµικοί Ταξινοµητές ΤµήµαΕπιστήµης και Τεχνολογίας Τηλεπικοινωνιών Πανεπιστήµιο Πελοποννήσου 7 Ncolas sapatsouls

ΚΕΣ 3: Αναγνώριση Προτύπων και Ανάλυση Εικόνας KEΣ 3 Αναγνώριση Προτύπων και Ανάλυση Εικόνας Γραµµικοί Ταξινοµητές ΤµήµαΕπιστήµης και Τεχνολογίας Τηλεπικοινωνιών Πανεπιστήµιο Πελοποννήσου 7 Ncolas sapatsouls

Μάθηση και Γενίκευση. "Τεχνητά Νευρωνικά Δίκτυα" (Διαφάνειες), Α. Λύκας, Παν. Ιωαννίνων

Μάθηση και Γενίκευση Το Πολυεπίπεδο Perceptron (MultiLayer Perceptron (MLP)) Έστω σύνολο εκπαίδευσης D={(x n,t n )}, n=1,,n. x n =(x n1,, x nd ) T, t n =(t n1,, t np ) T Θα πρέπει το MLP να έχει d νευρώνες

Μάθηση και Γενίκευση Το Πολυεπίπεδο Perceptron (MultiLayer Perceptron (MLP)) Έστω σύνολο εκπαίδευσης D={(x n,t n )}, n=1,,n. x n =(x n1,, x nd ) T, t n =(t n1,, t np ) T Θα πρέπει το MLP να έχει d νευρώνες

Ασκήσεις Φροντιστηρίου «Υπολογιστική Νοημοσύνη Ι» 3ο Φροντιστήριο

Ασκήσεις Φροντιστηρίου 3ο Φροντιστήριο Πρόβλημα 1 ο Το perceptron ενός επιπέδου είναι ένας γραμμικός ταξινομητής προτύπων. Δικαιολογήστε αυτή την πρόταση. x 1 x 2 Έξοδος y x p θ Κατώφλι Perceptron (στοιχειώδης

Ασκήσεις Φροντιστηρίου 3ο Φροντιστήριο Πρόβλημα 1 ο Το perceptron ενός επιπέδου είναι ένας γραμμικός ταξινομητής προτύπων. Δικαιολογήστε αυτή την πρόταση. x 1 x 2 Έξοδος y x p θ Κατώφλι Perceptron (στοιχειώδης

Εισαγωγή στη Γνωστική Ψυχολογία. επ. Κωνσταντίνος Π. Χρήστου

Εισαγωγή στη Γνωστική Ψυχολογία Inside the black box για µια επιστήµη του Νου Επιστροφή στο Νου Γνωστική Ψυχολογία / Γνωσιακή Επιστήµη Inside the black box για µια επιστήµη του Νου Επιστροφή στο Νου Γνωστική

Εισαγωγή στη Γνωστική Ψυχολογία Inside the black box για µια επιστήµη του Νου Επιστροφή στο Νου Γνωστική Ψυχολογία / Γνωσιακή Επιστήµη Inside the black box για µια επιστήµη του Νου Επιστροφή στο Νου Γνωστική

ΕΛΕΓΧΟΣ ΠΑΡΑΓΩΓΙΚΩΝ ΔΙΕΡΓΑΣΙΩΝ

ΕΛΛΗΝΙΚΗ ΔΗΜΟΚΡΑΤΙΑ Ανώτατο Εκπαιδευτικό Ίδρυμα Πειραιά Τεχνολογικού Τομέα ΕΛΕΓΧΟΣ ΠΑΡΑΓΩΓΙΚΩΝ ΔΙΕΡΓΑΣΙΩΝ Ενότητα: Αναγνώριση Διεργασίας - Προσαρμοστικός Έλεγχος (Process Identification) Αλαφοδήμος Κωνσταντίνος

ΕΛΛΗΝΙΚΗ ΔΗΜΟΚΡΑΤΙΑ Ανώτατο Εκπαιδευτικό Ίδρυμα Πειραιά Τεχνολογικού Τομέα ΕΛΕΓΧΟΣ ΠΑΡΑΓΩΓΙΚΩΝ ΔΙΕΡΓΑΣΙΩΝ Ενότητα: Αναγνώριση Διεργασίας - Προσαρμοστικός Έλεγχος (Process Identification) Αλαφοδήμος Κωνσταντίνος

Νευρωνικά ίκτυα. Σηµερινό Μάθηµα

Νευρωνικά ίκτυα Σηµερινό Μάθηµα Ιστορική Αναδροµή ΑπόταΒιολογικάΝευρωνικά ίκτυαστα Τεχνητά Το µοντέλο του τεχνητού νευρώνα Νευρωνικά ίκτυα Εκπαίδευση Συναρτήσεις ενεργοποίησης TαΝ.. σαν κατευθυνόµενoιγράφοι

Νευρωνικά ίκτυα Σηµερινό Μάθηµα Ιστορική Αναδροµή ΑπόταΒιολογικάΝευρωνικά ίκτυαστα Τεχνητά Το µοντέλο του τεχνητού νευρώνα Νευρωνικά ίκτυα Εκπαίδευση Συναρτήσεις ενεργοποίησης TαΝ.. σαν κατευθυνόµενoιγράφοι

Τεχνητά Νευρωνικά Δίκτυα. Τσιριγώτης Γεώργιος Τμήμα Μηχανικών Πληροφορικής ΤΕΙ Ανατολικής Μακεδονίας & Θράκης

Τεχνητά Τσιριγώτης Γεώργιος Τμήμα Μηχανικών Πληροφορικής ΤΕΙ Ανατολικής Μακεδονίας & Θράκης Ο Βιολογικός Νευρώνας Δενδρίτες Συνάψεις Πυρήνας (Σώμα) Άξονας 2 Ο Βιολογικός Νευρώνας 3 Βασικά Χαρακτηριστικά

Τεχνητά Τσιριγώτης Γεώργιος Τμήμα Μηχανικών Πληροφορικής ΤΕΙ Ανατολικής Μακεδονίας & Θράκης Ο Βιολογικός Νευρώνας Δενδρίτες Συνάψεις Πυρήνας (Σώμα) Άξονας 2 Ο Βιολογικός Νευρώνας 3 Βασικά Χαρακτηριστικά

ΣΤΟΧΑΣΤΙΚΕΣ ΔΙΕΡΓΑΣΙΕΣ & ΒΕΛΤΙΣΤΟΠΟΙΗΣΗ Αίθουσα Νέα Κτίρια ΣΗΜΜΥ Ε.Μ.Π. Ανάλυση Κυρίων Συνιστωσών (Principal-Component Analysis, PCA)

ΣΤΟΧΑΣΤΙΚΕΣ ΔΙΕΡΓΑΣΙΕΣ & ΒΕΛΤΙΣΤΟΠΟΙΗΣΗ Αίθουσα 005 - Νέα Κτίρια ΣΗΜΜΥ Ε.Μ.Π. Ανάλυση Κυρίων Συνιστωσών (Principal-Coponent Analysis, PCA) καθ. Βασίλης Μάγκλαρης aglaris@netode.ntua.gr www.netode.ntua.gr

ΣΤΟΧΑΣΤΙΚΕΣ ΔΙΕΡΓΑΣΙΕΣ & ΒΕΛΤΙΣΤΟΠΟΙΗΣΗ Αίθουσα 005 - Νέα Κτίρια ΣΗΜΜΥ Ε.Μ.Π. Ανάλυση Κυρίων Συνιστωσών (Principal-Coponent Analysis, PCA) καθ. Βασίλης Μάγκλαρης aglaris@netode.ntua.gr www.netode.ntua.gr

Αριθμητική Ανάλυση και Εφαρμογές

Αριθμητική Ανάλυση και Εφαρμογές Διδάσκων: Δημήτριος Ι. Φωτιάδης Τμήμα Μηχανικών Επιστήμης Υλικών Ιωάννινα 07-08 Αριθμητική Παραγώγιση Εισαγωγή Ορισμός 7. Αν y f x είναι μια συνάρτηση ορισμένη σε ένα διάστημα

Αριθμητική Ανάλυση και Εφαρμογές Διδάσκων: Δημήτριος Ι. Φωτιάδης Τμήμα Μηχανικών Επιστήμης Υλικών Ιωάννινα 07-08 Αριθμητική Παραγώγιση Εισαγωγή Ορισμός 7. Αν y f x είναι μια συνάρτηση ορισμένη σε ένα διάστημα

Τεχνητή Νοημοσύνη. 19η διάλεξη ( ) Ίων Ανδρουτσόπουλος.

Τεχνητή Νοημοσύνη 19η διάλεξη (2016-17) Ίων Ανδρουτσόπουλος http://www.aueb.gr/users/ion/ 1 Οι διαφάνειες αυτές βασίζονται σε ύλη των βιβλίων: Artificia Inteigence A Modern Approach των S. Russe και P.

Τεχνητή Νοημοσύνη 19η διάλεξη (2016-17) Ίων Ανδρουτσόπουλος http://www.aueb.gr/users/ion/ 1 Οι διαφάνειες αυτές βασίζονται σε ύλη των βιβλίων: Artificia Inteigence A Modern Approach των S. Russe και P.

Σέργιος Θεοδωρίδης Κωνσταντίνος Κουτρούμπας. Version 2

Σέργιος Θεοδωρίδης Κωνσταντίνος Κουτρούμπας Verson ΜΗ ΓΡΑΜΜΙΚΟΙ ΤΑΞΙΝΟΜΗΤΕΣ ΝΕΥΡΩΝΙΚΑ ΔΙΚΤΥΑ Η παραπάνω ανάλυση ήταν χρήσιμη προκειμένου να κατανοήσουμε τη λογική των δικτύων perceptrons πολλών επιπέδων

Σέργιος Θεοδωρίδης Κωνσταντίνος Κουτρούμπας Verson ΜΗ ΓΡΑΜΜΙΚΟΙ ΤΑΞΙΝΟΜΗΤΕΣ ΝΕΥΡΩΝΙΚΑ ΔΙΚΤΥΑ Η παραπάνω ανάλυση ήταν χρήσιμη προκειμένου να κατανοήσουμε τη λογική των δικτύων perceptrons πολλών επιπέδων

EΦΑΡΜΟΓΕΣ ΤΗΣ ΨΗΦΙΑΚΗΣ ΕΠΕΞΕΡΓΑΣΙΑΣ ΣΗΜΑΤΩΝ. Γραµµική Εκτίµηση Τυχαίων Σηµάτων

EΦΑΡΜΟΓΕΣ ΤΗΣ ΨΗΦΙΑΚΗΣ ΕΠΕΞΕΡΓΑΣΙΑΣ ΣΗΜΑΤΩΝ Γραµµική Εκτίµηση Τυχαίων Σηµάτων Εµµανουήλ Ζ. Ψαράκης Πολυτεχνική Σχολή Τµήµα Μηχανικών Η/Υ & Πληροφορικής Γραµµική Εκτίµηση Τυχαίων Σηµάτων FIR φίλτρα: Ορίζουµε

EΦΑΡΜΟΓΕΣ ΤΗΣ ΨΗΦΙΑΚΗΣ ΕΠΕΞΕΡΓΑΣΙΑΣ ΣΗΜΑΤΩΝ Γραµµική Εκτίµηση Τυχαίων Σηµάτων Εµµανουήλ Ζ. Ψαράκης Πολυτεχνική Σχολή Τµήµα Μηχανικών Η/Υ & Πληροφορικής Γραµµική Εκτίµηση Τυχαίων Σηµάτων FIR φίλτρα: Ορίζουµε

Στοχαστικά Σήµατα και Εφαρµογές. ιδάσκων: Ν. Παπανδρέου (Π.. 407/80) Πανεπιστήµιο Πατρών ΤµήµαΜηχανικώνΗ/Υ και Πληροφορικής

Στοχαστικά Σήµατα & Εφαρµογές Βέλτιστα Φίλτρα Wiener ιδάσκων: Ν. Παπανδρέου (Π.. 7/8) Πανεπιστήµιο Πατρών ΤµήµαΜηχανικώνΗ/Υ και Πληροφορικής CEID 7-8 Εισαγωγή ιατύπωση του προβλήµατος: οθέντος των από

Στοχαστικά Σήµατα & Εφαρµογές Βέλτιστα Φίλτρα Wiener ιδάσκων: Ν. Παπανδρέου (Π.. 7/8) Πανεπιστήµιο Πατρών ΤµήµαΜηχανικώνΗ/Υ και Πληροφορικής CEID 7-8 Εισαγωγή ιατύπωση του προβλήµατος: οθέντος των από

6. Στατιστικές μέθοδοι εκπαίδευσης

6. Στατιστικές μέθοδοι εκπαίδευσης Μία διαφορετική μέθοδος εκπαίδευσης των νευρωνικών δικτύων χρησιμοποιεί ιδέες από την Στατιστική Φυσική για να φέρει τελικά το ίδιο αποτέλεσμα όπως οι άλλες μέθοδοι,

6. Στατιστικές μέθοδοι εκπαίδευσης Μία διαφορετική μέθοδος εκπαίδευσης των νευρωνικών δικτύων χρησιμοποιεί ιδέες από την Στατιστική Φυσική για να φέρει τελικά το ίδιο αποτέλεσμα όπως οι άλλες μέθοδοι,

Προσαρµοστικοί Αλγόριθµοι Υλοποίησης Βέλτιστων Ψηφιακών Φίλτρων: Οαλγόριθµος Least Mean Square (LMS)

ΒΕΣ 6 Προσαρµοστικά Συστήµατα στις Τηλεπικοινωνίες Προσαρµοστικοί Αλγόριθµοι Υλοποίησης Βέλτιστων Ψηφιακών Φίλτρων: Οαλγόριθµος Least ean Sqare (LS) Βιβλιογραφία Ενότητας Benvento []: Κεφάλαιo 3 Widrow

ΒΕΣ 6 Προσαρµοστικά Συστήµατα στις Τηλεπικοινωνίες Προσαρµοστικοί Αλγόριθµοι Υλοποίησης Βέλτιστων Ψηφιακών Φίλτρων: Οαλγόριθµος Least ean Sqare (LS) Βιβλιογραφία Ενότητας Benvento []: Κεφάλαιo 3 Widrow

Τμήμα Μηχανικών Η/Υ και Πληροφορικής

Τμήμα Μηχανικών Η/Υ και Πληροφορικής Εργαστήριο Επεξεργασίας Σημάτων και Τηλεπικοινωνιών Κινητά Δίκτυα Επικοινωνιών Μέρος Α: Τηλεπικοινωνιακά Θέματα: Ενότητα Νο 4 Τεχνικές Ισοστάθμισης Διαύλου Βασικές

Τμήμα Μηχανικών Η/Υ και Πληροφορικής Εργαστήριο Επεξεργασίας Σημάτων και Τηλεπικοινωνιών Κινητά Δίκτυα Επικοινωνιών Μέρος Α: Τηλεπικοινωνιακά Θέματα: Ενότητα Νο 4 Τεχνικές Ισοστάθμισης Διαύλου Βασικές

Τεχνητή Νοημοσύνη. 18η διάλεξη ( ) Ίων Ανδρουτσόπουλος.

Τεχνητή Νοημοσύνη 18η διάλεξη (2016-17) Ίων Ανδρουτσόπουλος http://www.aueb.gr/users/ion/ 1 Οι διαφάνειες αυτής της διάλεξης βασίζονται: στο βιβλίο Machine Learning του T. Mitchell, McGraw- Hill, 1997,

Τεχνητή Νοημοσύνη 18η διάλεξη (2016-17) Ίων Ανδρουτσόπουλος http://www.aueb.gr/users/ion/ 1 Οι διαφάνειες αυτής της διάλεξης βασίζονται: στο βιβλίο Machine Learning του T. Mitchell, McGraw- Hill, 1997,

ΠΑΝΕΠΙΣΤΗΜΙΟ ΜΑΚΕ ΟΝΙΑΣ ΟΙΚΟΝΟΜΙΚΩΝ ΚΑΙ ΚΟΙΝΩΝΙΚΩΝ ΕΠΙΣΤΗΜΩΝ ΠΜΣΕ ΣΤΗΝ ΕΦΑΡΜΟΣΜΕΝΗ ΠΛΗΡΟΦΟΡΙΚΗ ΝΕΥΡΩΝΙΚΑ ΙΚΤΥΑ ΚΑΙ ΕΞΕΛΙΚΤΙΚΟΙ ΑΛΓΟΡΙΘΜΟΙ

ΠΑΝΕΠΙΣΤΗΜΙΟ ΜΑΚΕ ΟΝΙΑΣ ΟΙΚΟΝΟΜΙΚΩΝ ΚΑΙ ΚΟΙΝΩΝΙΚΩΝ ΕΠΙΣΤΗΜΩΝ ΠΜΣΕ ΣΤΗΝ ΕΦΑΡΜΟΣΜΕΝΗ ΠΛΗΡΟΦΟΡΙΚΗ ΝΕΥΡΩΝΙΚΑ ΙΚΤΥΑ ΚΑΙ ΕΞΕΛΙΚΤΙΚΟΙ ΑΛΓΟΡΙΘΜΟΙ ΟΜΑ Α ΑΣΚΗΣΕΩΝ ΑΣΚΗΣΗ Στην εικόνα παρακάτω φαίνεται ένα νευρωνικό

ΠΑΝΕΠΙΣΤΗΜΙΟ ΜΑΚΕ ΟΝΙΑΣ ΟΙΚΟΝΟΜΙΚΩΝ ΚΑΙ ΚΟΙΝΩΝΙΚΩΝ ΕΠΙΣΤΗΜΩΝ ΠΜΣΕ ΣΤΗΝ ΕΦΑΡΜΟΣΜΕΝΗ ΠΛΗΡΟΦΟΡΙΚΗ ΝΕΥΡΩΝΙΚΑ ΙΚΤΥΑ ΚΑΙ ΕΞΕΛΙΚΤΙΚΟΙ ΑΛΓΟΡΙΘΜΟΙ ΟΜΑ Α ΑΣΚΗΣΕΩΝ ΑΣΚΗΣΗ Στην εικόνα παρακάτω φαίνεται ένα νευρωνικό

Παρεμβολή & πρόγνωση άγνωστης συνάρτησης μέσω σημειακής προσαρμογής

Ειδικά Θέματα Συνορθώσεων & Εφαρμογές 8 ο εξάμηνο, Ακαδημαϊκό έτος 2018-2019 Παρεμβολή & πρόγνωση άγνωστης συνάρτησης μέσω σημειακής προσαρμογής (Least squares collocation) Χριστόφορος Κωτσάκης Τμήμα Αγρονόμων

Ειδικά Θέματα Συνορθώσεων & Εφαρμογές 8 ο εξάμηνο, Ακαδημαϊκό έτος 2018-2019 Παρεμβολή & πρόγνωση άγνωστης συνάρτησης μέσω σημειακής προσαρμογής (Least squares collocation) Χριστόφορος Κωτσάκης Τμήμα Αγρονόμων

PROJECT ΣΤΟ ΜΑΘΗΜΑ ΕΙΣΑΓΩΓΗ ΣΤΙΣ ΕΥΡΕΤΙΚΕΣ ΜΕΘΟ ΟΥΣ

ΠΑΝΕΠΙΣΤΗΜΙΟ ΠΑΤΡΩΝ ΠΟΛΥΤΕΧΝΙΚΗ ΣΧΟΛΗ ΤΜΗΜΑ ΜΗΧΑΝΙΚΩΝ Η/Υ ΚΑΙ ΠΛΗΡΟΦΟΡΙΚΗΣ PROJECT ΣΤΟ ΜΑΘΗΜΑ ΕΙΣΑΓΩΓΗ ΣΤΙΣ ΕΥΡΕΤΙΚΕΣ ΜΕΘΟ ΟΥΣ ΜΕΡΟΣ ΤΡΙΤΟ Πολίτη Όλγα Α.Μ. 4528 Εξάµηνο 8ο Υπεύθυνος Καθηγητής Λυκοθανάσης

ΠΑΝΕΠΙΣΤΗΜΙΟ ΠΑΤΡΩΝ ΠΟΛΥΤΕΧΝΙΚΗ ΣΧΟΛΗ ΤΜΗΜΑ ΜΗΧΑΝΙΚΩΝ Η/Υ ΚΑΙ ΠΛΗΡΟΦΟΡΙΚΗΣ PROJECT ΣΤΟ ΜΑΘΗΜΑ ΕΙΣΑΓΩΓΗ ΣΤΙΣ ΕΥΡΕΤΙΚΕΣ ΜΕΘΟ ΟΥΣ ΜΕΡΟΣ ΤΡΙΤΟ Πολίτη Όλγα Α.Μ. 4528 Εξάµηνο 8ο Υπεύθυνος Καθηγητής Λυκοθανάσης

Βέλτιστη παρεμβολή και πρόγνωση άγνωστης συνάρτησης με τη μέθοδο της σημειακής προσαρμογής

Ειδικά Θέματα Συνορθώσεων & Εφαρμογές 8 ο εξάμηνο, Ακαδημαϊκό έτος 2016-2017 Βέλτιστη παρεμβολή και πρόγνωση άγνωστης συνάρτησης με τη μέθοδο της σημειακής προσαρμογής (Least squares collocation) Χριστόφορος

Ειδικά Θέματα Συνορθώσεων & Εφαρμογές 8 ο εξάμηνο, Ακαδημαϊκό έτος 2016-2017 Βέλτιστη παρεμβολή και πρόγνωση άγνωστης συνάρτησης με τη μέθοδο της σημειακής προσαρμογής (Least squares collocation) Χριστόφορος

Σειρά: Επεξεργασία Δεδομένων Εκδοση/Ημ.νία: #3.1/ Συγγραφέας: Μίχος Θεόδωρος, Φυσικός

Σειρά: Επεξεργασία Δεδομένων Εκδοση/Ημ.νία: #3.1/018-0-15 Συγγραφέας: Μίχος Θεόδωρος, Φυσικός 1. Μέθοδος Ελαχίστων Τετραγώνων Μια από τις πρώτες δουλειές που μαθαίνει ένας φοιτητής θετικών επιστημών μόλις

Σειρά: Επεξεργασία Δεδομένων Εκδοση/Ημ.νία: #3.1/018-0-15 Συγγραφέας: Μίχος Θεόδωρος, Φυσικός 1. Μέθοδος Ελαχίστων Τετραγώνων Μια από τις πρώτες δουλειές που μαθαίνει ένας φοιτητής θετικών επιστημών μόλις

Υπολογιστική Νοημοσύνη. Μάθημα 4: Μάθηση στον απλό τεχνητό νευρώνα (2)

Υπολογιστική Νοημοσύνη Μάθημα 4: Μάθηση στον απλό τεχνητό νευρώνα (2) Ο κανόνας Δέλτα για συνεχείς συναρτήσεις ενεργοποίησης (1/2) Για συνεχείς συναρτήσεις ενεργοποίησης, θα θέλαμε να αλλάξουμε περισσότερο

Υπολογιστική Νοημοσύνη Μάθημα 4: Μάθηση στον απλό τεχνητό νευρώνα (2) Ο κανόνας Δέλτα για συνεχείς συναρτήσεις ενεργοποίησης (1/2) Για συνεχείς συναρτήσεις ενεργοποίησης, θα θέλαμε να αλλάξουμε περισσότερο

ΠΑΝΕΠΙΣΤΗΜΙΟ ΜΑΚΕ ΟΝΙΑΣ ΟΙΚΟΝΟΜΙΚΩΝ ΚΑΙ ΚΟΙΝΩΝΙΚΩΝ ΕΠΙΣΤΗΜΩΝ ΤΜΗΜΑ ΕΦΑΡΜΟΣΜΕΝΗΣ ΠΛΗΡΟΦΟΡΙΚΗΣ ΝΕΥΡΩΝΙΚΑ ΙΚΤΥΑ

ΘΕΜΑ ο 2.5 µονάδες ΠΑΝΕΠΙΣΤΗΜΙΟ ΜΑΚΕ ΟΝΙΑΣ ΟΙΚΟΝΟΜΙΚΩΝ ΚΑΙ ΚΟΙΝΩΝΙΚΩΝ ΕΠΙΣΤΗΜΩΝ ΤΜΗΜΑ ΕΑΡΜΟΣΜΕΝΗΣ ΠΛΗΡΟΟΡΙΚΗΣ ΝΕΥΡΩΝΙΚΑ ΙΚΤΥΑ Τελικές εξετάσεις 2 Οκτωβρίου 23 ιάρκεια: 2 ώρες Έστω το παρακάτω γραµµικώς

ΘΕΜΑ ο 2.5 µονάδες ΠΑΝΕΠΙΣΤΗΜΙΟ ΜΑΚΕ ΟΝΙΑΣ ΟΙΚΟΝΟΜΙΚΩΝ ΚΑΙ ΚΟΙΝΩΝΙΚΩΝ ΕΠΙΣΤΗΜΩΝ ΤΜΗΜΑ ΕΑΡΜΟΣΜΕΝΗΣ ΠΛΗΡΟΟΡΙΚΗΣ ΝΕΥΡΩΝΙΚΑ ΙΚΤΥΑ Τελικές εξετάσεις 2 Οκτωβρίου 23 ιάρκεια: 2 ώρες Έστω το παρακάτω γραµµικώς

Τεχνητή Νοημοσύνη. 17η διάλεξη ( ) Ίων Ανδρουτσόπουλος.

Τεχνητή Νοημοσύνη 17η διάλεξη (2016-17) Ίων Ανδρουτσόπουλος http://.aueb.gr/users/ion/ 1 Οι διαφάνειες αυτής της διάλεξης βασίζονται: στο βιβλίο Artificia Inteigence A Modern Approach των S. Russe και

Τεχνητή Νοημοσύνη 17η διάλεξη (2016-17) Ίων Ανδρουτσόπουλος http://.aueb.gr/users/ion/ 1 Οι διαφάνειες αυτής της διάλεξης βασίζονται: στο βιβλίο Artificia Inteigence A Modern Approach των S. Russe και

Στοχαστικά Σήματα και Τηλεπικοινωνιές

Στοχαστικά Σήματα και Τηλεπικοινωνιές Ενότητα 5: Προσαρμοστική Επεξεργασία Καθηγητής Κώστας Μπερμπερίδης Πολυτεχνική Σχολή Τμήμα Μηχανικών Η/Υ και Πληροφορικής Σκοποί ενότητας Παρουσίαση των βασικών εννοιών

Στοχαστικά Σήματα και Τηλεπικοινωνιές Ενότητα 5: Προσαρμοστική Επεξεργασία Καθηγητής Κώστας Μπερμπερίδης Πολυτεχνική Σχολή Τμήμα Μηχανικών Η/Υ και Πληροφορικής Σκοποί ενότητας Παρουσίαση των βασικών εννοιών

ΕΥΦΥΗΣ ΕΛΕΓΧΟΣ. Ενότητα #12: Εισαγωγή στα Nευρωνικά Δίκτυα. Αναστάσιος Ντούνης Τμήμα Μηχανικών Αυτοματισμού Τ.Ε.

ΕΛΛΗΝΙΚΗ ΔΗΜΟΚΡΑΤΙΑ Ανώτατο Εκπαιδευτικό Ίδρυμα Πειραιά Τεχνολογικού Τομέα ΕΥΦΥΗΣ ΕΛΕΓΧΟΣ Ενότητα #12: Εισαγωγή στα Nευρωνικά Δίκτυα Αναστάσιος Ντούνης Τμήμα Μηχανικών Αυτοματισμού Τ.Ε. Άδειες Χρήσης Το

ΕΛΛΗΝΙΚΗ ΔΗΜΟΚΡΑΤΙΑ Ανώτατο Εκπαιδευτικό Ίδρυμα Πειραιά Τεχνολογικού Τομέα ΕΥΦΥΗΣ ΕΛΕΓΧΟΣ Ενότητα #12: Εισαγωγή στα Nευρωνικά Δίκτυα Αναστάσιος Ντούνης Τμήμα Μηχανικών Αυτοματισμού Τ.Ε. Άδειες Χρήσης Το

Α. ΤΕΙ ΚΡΗΤΗΣ Τµήµα Εφαρµοσµένης Πληροφορικής και Πολυµέσων Εργαστήριο Νευρωνικών Δικτύων

Α. ΤΕΙ ΚΡΗΤΗΣ Τµήµα Εφαρµοσµένης Πληροφορικής και Πολυµέσων Εργαστήριο Νευρωνικών Δικτύων 5 BACKPROPAGATION MULTILAYER FEEDFORWARD ΔΙΚΤΥΑ Α. ΕΙΣΑΓΩΓΗ Τα νευρωνικά δίκτυα που εξετάσαµε µέχρι τώρα είχαν

Α. ΤΕΙ ΚΡΗΤΗΣ Τµήµα Εφαρµοσµένης Πληροφορικής και Πολυµέσων Εργαστήριο Νευρωνικών Δικτύων 5 BACKPROPAGATION MULTILAYER FEEDFORWARD ΔΙΚΤΥΑ Α. ΕΙΣΑΓΩΓΗ Τα νευρωνικά δίκτυα που εξετάσαµε µέχρι τώρα είχαν

Εισόδημα Κατανάλωση 1500 500 1600 600 1300 450 1100 400 600 250 700 275 900 300 800 352 850 400 1100 500

Εισόδημα Κατανάλωση 1500 500 1600 600 1300 450 1100 400 600 250 700 275 900 300 800 352 850 400 1100 500 Πληθυσμός Δείγμα Δείγμα Δείγμα Ο ρόλος της Οικονομετρίας Οικονομική Θεωρία Διατύπωση της

Εισόδημα Κατανάλωση 1500 500 1600 600 1300 450 1100 400 600 250 700 275 900 300 800 352 850 400 1100 500 Πληθυσμός Δείγμα Δείγμα Δείγμα Ο ρόλος της Οικονομετρίας Οικονομική Θεωρία Διατύπωση της

Μέρος V. Ανάλυση Παλινδρόμηση (Regression Analysis)

Μέρος V. Ανάλυση Παλινδρόμηση (Regresso Aalss) Βασικές έννοιες Απλή Γραμμική Παλινδρόμηση Πολλαπλή Παλινδρόμηση Εφαρμοσμένη Στατιστική Μέρος 5 ο - Κ. Μπλέκας () Βασικές έννοιες Έστω τ.μ. Χ,Υ όπου υπάρχει

Μέρος V. Ανάλυση Παλινδρόμηση (Regresso Aalss) Βασικές έννοιες Απλή Γραμμική Παλινδρόμηση Πολλαπλή Παλινδρόμηση Εφαρμοσμένη Στατιστική Μέρος 5 ο - Κ. Μπλέκας () Βασικές έννοιες Έστω τ.μ. Χ,Υ όπου υπάρχει

Κινητά Δίκτυα Επικοινωνιών

Κινητά Δίκτυα Επικοινωνιών Καθ. Κώστας Μπερμπερίδης Πολυτεχνική Σχολή Τμήμα Μηχανικών Η/Υ & Πληροφορικής Σκοποί ενότητας Η εξοικείωση του φοιτητή με τις διάφορες τεχνικές ισοστάθμισης καναλιού που χρησιμοποιούνται

Κινητά Δίκτυα Επικοινωνιών Καθ. Κώστας Μπερμπερίδης Πολυτεχνική Σχολή Τμήμα Μηχανικών Η/Υ & Πληροφορικής Σκοποί ενότητας Η εξοικείωση του φοιτητή με τις διάφορες τεχνικές ισοστάθμισης καναλιού που χρησιμοποιούνται

Σέργιος Θεοδωρίδης Κωνσταντίνος Κουτρούμπας. Version 2

Σέργιος Θεοδωρίδης Κωνσταντίνος Κουτρούμπας Verson ΧΑΡΤΟΓΡΑΦΗΣΗ ΤΟΥ ΧΩΡΟΥ ΤΩΝ ΤΑΞΙΝΟΜΗΤΩΝ Ταξινομητές Ταξινομητές συναρτ. διάκρισης Ταξινομητές επιφανειών απόφ. Παραμετρικοί ταξινομητές Μη παραμετρικοί

Σέργιος Θεοδωρίδης Κωνσταντίνος Κουτρούμπας Verson ΧΑΡΤΟΓΡΑΦΗΣΗ ΤΟΥ ΧΩΡΟΥ ΤΩΝ ΤΑΞΙΝΟΜΗΤΩΝ Ταξινομητές Ταξινομητές συναρτ. διάκρισης Ταξινομητές επιφανειών απόφ. Παραμετρικοί ταξινομητές Μη παραμετρικοί

ΠΡΟΒΛΕΨΗ ΖΗΤΗΣΗΣ ΦΥΣΙΚΟΥ ΑΕΡΙΟΥ

Ατομική Διπλωματική Εργασία ΠΡΟΒΛΕΨΗ ΖΗΤΗΣΗΣ ΦΥΣΙΚΟΥ ΑΕΡΙΟΥ Χρίστος Αιμίλιος Πραστίτης ΠΑΝΕΠΙΣΤΗΜΙΟ ΚΥΠΡΟΥ ΤΜΗΜΑ ΠΛΗΡΟΦΟΡΙΚΗΣ Μάιος 2009 ΠΑΝΕΠΙΣΤΗΜΙΟ ΚΥΠΡΟΥ ΤΜΗΜΑ ΠΛΗΡΟΦΟΡΙΚΗΣ Πρόβλεψη ζήτησης φυσικού

Ατομική Διπλωματική Εργασία ΠΡΟΒΛΕΨΗ ΖΗΤΗΣΗΣ ΦΥΣΙΚΟΥ ΑΕΡΙΟΥ Χρίστος Αιμίλιος Πραστίτης ΠΑΝΕΠΙΣΤΗΜΙΟ ΚΥΠΡΟΥ ΤΜΗΜΑ ΠΛΗΡΟΦΟΡΙΚΗΣ Μάιος 2009 ΠΑΝΕΠΙΣΤΗΜΙΟ ΚΥΠΡΟΥ ΤΜΗΜΑ ΠΛΗΡΟΦΟΡΙΚΗΣ Πρόβλεψη ζήτησης φυσικού

x y max(x))

ΚΕΦΑΛΑΙΟ 0 Απλή Γραµµική Παλινδρόµηση Μωυσιάδης Χρόνης 6 o Εξάµηνο Μαθηµατικών Ένα Πρόβληµα εδοµένα.6 3. 3.8 4. 4.4 5.8 6.0 6.7 7. 7.8 y 5.6 7.9 8.0 8. 8. 9. 9.5 9.4 9.6 9.9 Έχει σχέση το yµε το ; Ειδικότερα

ΚΕΦΑΛΑΙΟ 0 Απλή Γραµµική Παλινδρόµηση Μωυσιάδης Χρόνης 6 o Εξάµηνο Μαθηµατικών Ένα Πρόβληµα εδοµένα.6 3. 3.8 4. 4.4 5.8 6.0 6.7 7. 7.8 y 5.6 7.9 8.0 8. 8. 9. 9.5 9.4 9.6 9.9 Έχει σχέση το yµε το ; Ειδικότερα

Τεχνητά Νευρωνικά Δίκτυα

Τεχνητά Νευρωνικά Δίκτυα & εφαρμογή τους στην πρόγνωση καιρού Πτυχιακή Εργασία Όνομα: Ανδρέας Φωτέας ΑΜ: 200600226 Επιβλέπων: Εμμανουήλ Τσίλης 2 Περιεχόμενα 1. Αρχές Λειτουργίας...7 1.1 Η δομή ενός νευρωνικού

Τεχνητά Νευρωνικά Δίκτυα & εφαρμογή τους στην πρόγνωση καιρού Πτυχιακή Εργασία Όνομα: Ανδρέας Φωτέας ΑΜ: 200600226 Επιβλέπων: Εμμανουήλ Τσίλης 2 Περιεχόμενα 1. Αρχές Λειτουργίας...7 1.1 Η δομή ενός νευρωνικού

Ανδρέας Παπαζώης. Τμ. Διοίκησης Επιχειρήσεων

Ανδρέας Παπαζώης Τμ. Διοίκησης Επιχειρήσεων Περιεχόμενα Εργ. Μαθήματος Εκπαίδευση (μάθηση) Νευρωνικών Δικτύων Απλός αισθητήρας Παράδειγμα εκπαίδευσης Θέματα υλοποίησης Νευρωνικών Δικτύων 2/17 Διαδικασία

Ανδρέας Παπαζώης Τμ. Διοίκησης Επιχειρήσεων Περιεχόμενα Εργ. Μαθήματος Εκπαίδευση (μάθηση) Νευρωνικών Δικτύων Απλός αισθητήρας Παράδειγμα εκπαίδευσης Θέματα υλοποίησης Νευρωνικών Δικτύων 2/17 Διαδικασία

Σέργιος Θεοδωρίδης Κωνσταντίνος Κουτρούμπας. Version 2

Σέργιος Θεοδωρίδης Κωνσταντίνος Κουτρούμπας Verson ΜΙΑ ΣΥΜΒΑΣΗ: Προκειμένου να καταστήσουμε πιο συμπαγή το συμβολισμό H : ορίζουμε Ετσι έχουμε *=[ ] an *=[ ]. H : * * ΣΗΜΕΙΩΣΗ: Στη συνέχεια εκτός αν ορίζεται

Σέργιος Θεοδωρίδης Κωνσταντίνος Κουτρούμπας Verson ΜΙΑ ΣΥΜΒΑΣΗ: Προκειμένου να καταστήσουμε πιο συμπαγή το συμβολισμό H : ορίζουμε Ετσι έχουμε *=[ ] an *=[ ]. H : * * ΣΗΜΕΙΩΣΗ: Στη συνέχεια εκτός αν ορίζεται

EΦΑΡΜΟΓΕΣ ΤΗΣ ΨΗΦΙΑΚΗΣ ΕΠΕΞΕΡΓΑΣΙΑΣ ΣΗΜΑΤΩΝ. Διαφορική Παλµοκωδική Διαµόρφωση (DPCM)

EΦΑΡΜΟΓΕΣ ΤΗΣ ΨΗΦΙΑΚΗΣ ΕΠΕΞΕΡΓΑΣΙΑΣ ΣΗΜΑΤΩΝ Διαφορική Παλµοκωδική Διαµόρφωση (DCM) Εµµανουήλ Ζ. Ψαράκης Πολυτεχνική Σχολή Τµήµα Μηχανικών Η/Υ & Πληροφορικής Προεπισκόπηση Διαφορική Παλµοκωδική Διαµόρφωση

EΦΑΡΜΟΓΕΣ ΤΗΣ ΨΗΦΙΑΚΗΣ ΕΠΕΞΕΡΓΑΣΙΑΣ ΣΗΜΑΤΩΝ Διαφορική Παλµοκωδική Διαµόρφωση (DCM) Εµµανουήλ Ζ. Ψαράκης Πολυτεχνική Σχολή Τµήµα Μηχανικών Η/Υ & Πληροφορικής Προεπισκόπηση Διαφορική Παλµοκωδική Διαµόρφωση

HMY 795: Αναγνώριση Προτύπων

HMY 795: Αναγνώριση Προτύπων Διάλεξη 5 Κατανομές πιθανότητας και εκτίμηση παραμέτρων Κατανομές πιθανότητας και εκτίμηση παραμέτρων δυαδικές τυχαίες μεταβλητές Διαχωριστικές συναρτήσεις Ταξινόμηση κανονικών

HMY 795: Αναγνώριση Προτύπων Διάλεξη 5 Κατανομές πιθανότητας και εκτίμηση παραμέτρων Κατανομές πιθανότητας και εκτίμηση παραμέτρων δυαδικές τυχαίες μεταβλητές Διαχωριστικές συναρτήσεις Ταξινόμηση κανονικών

Συστήµατα Μη-Γραµµικών Εξισώσεων Μέθοδος Newton-Raphson

Ιαν. 009 Συστήµατα Μη-Γραµµικών Εξισώσεων Μέθοδος Newton-Raphson Έστω y, y,, yn παρατηρήσεις µιας m -διάστατης τυχαίας µεταβλητής µε συνάρτηση πυκνότητας πιθανότητας p( y; θ) η οποία περιγράφεται από ένα

Ιαν. 009 Συστήµατα Μη-Γραµµικών Εξισώσεων Μέθοδος Newton-Raphson Έστω y, y,, yn παρατηρήσεις µιας m -διάστατης τυχαίας µεταβλητής µε συνάρτηση πυκνότητας πιθανότητας p( y; θ) η οποία περιγράφεται από ένα

----------Εισαγωγή στη Χρήση του SPSS for Windows ------------- Σελίδα: 0------------

----------Εισαγωγή στη Χρήση του SPSS for Windows ------------- Σελίδα: 0------------ ΚΕΦΑΛΑΙΟ 9 ο 9.1 ηµιουργία µοντέλων πρόβλεψης 9.2 Απλή Γραµµική Παλινδρόµηση 9.3 Αναλυτικά για το ιάγραµµα ιασποράς

----------Εισαγωγή στη Χρήση του SPSS for Windows ------------- Σελίδα: 0------------ ΚΕΦΑΛΑΙΟ 9 ο 9.1 ηµιουργία µοντέλων πρόβλεψης 9.2 Απλή Γραµµική Παλινδρόµηση 9.3 Αναλυτικά για το ιάγραµµα ιασποράς

ΣΤΟΧΑΣΤΙΚΕΣ ΔΙΕΡΓΑΣΙΕΣ & ΒΕΛΤΙΣΤΟΠΟΙΗΣΗ Αίθουσα Νέα Κτίρια ΣΗΜΜΥ Ε.Μ.Π.

ΣΤΟΧΑΣΤΙΚΕΣ ΔΙΕΡΓΑΣΙΕΣ & ΒΕΛΤΙΣΤΟΠΟΙΗΣΗ Αίθουσα 005 - Νέα Κτίρια ΣΗΜΜΥ Ε.Μ.Π. Επισκόπηση Νευρωνικών Δικτύων καθ. Βασίλης Μάγκλαρης maglaris@netmode.ntua.gr www.netmode.ntua.gr Πέμπτη 14/3/2019 Μη Γραμμικό

ΣΤΟΧΑΣΤΙΚΕΣ ΔΙΕΡΓΑΣΙΕΣ & ΒΕΛΤΙΣΤΟΠΟΙΗΣΗ Αίθουσα 005 - Νέα Κτίρια ΣΗΜΜΥ Ε.Μ.Π. Επισκόπηση Νευρωνικών Δικτύων καθ. Βασίλης Μάγκλαρης maglaris@netmode.ntua.gr www.netmode.ntua.gr Πέμπτη 14/3/2019 Μη Γραμμικό

ιαφορική εντροπία Σεραφείµ Καραµπογιάς

ιαφορική εντροπία Σεραφείµ Καραµπογιάς Για πηγές διακριτού χρόνου µε συνεχές αλφάβητο, των οποίων οι έξοδοι είναι πραγµατικοί αριθµοί, ορίζεται µια άλλη ποσότητα που µοιάζει µε την εντροπία και καλείται

ιαφορική εντροπία Σεραφείµ Καραµπογιάς Για πηγές διακριτού χρόνου µε συνεχές αλφάβητο, των οποίων οι έξοδοι είναι πραγµατικοί αριθµοί, ορίζεται µια άλλη ποσότητα που µοιάζει µε την εντροπία και καλείται

Στοχαστικά Σήματα και Τηλεπικοινωνιές

Στοχαστικά Σήματα και Τηλεπικοινωνιές Ενότητα 7: Βέλτιστο Φίλτρο Wiener και Γραμμικά Περιορισμένο Φίλτρο Ελάχιστης Διασποράς Εφαρμογή στις Έξυπνες Κεραίες Καθηγητής Κώστας Μπερμπερίδης Πολυτεχνική Σχολή

Στοχαστικά Σήματα και Τηλεπικοινωνιές Ενότητα 7: Βέλτιστο Φίλτρο Wiener και Γραμμικά Περιορισμένο Φίλτρο Ελάχιστης Διασποράς Εφαρμογή στις Έξυπνες Κεραίες Καθηγητής Κώστας Μπερμπερίδης Πολυτεχνική Σχολή

προβλήµατος Το φίλτρο Kalman διαφέρει από τα συνηθισµένα προβλήµατα ΜΕΤ σε δύο χαρακτηριστικά: παραµέτρων αγνώστων

Φίλτρα Kalman Εξαγωγή των εξισώσεων τους µε βάση το κριτήριο ελαχιστοποίησης της Μεθόδου των Ελαχίστων Τετραγώνων. Αναλυτικές Μέθοδοι στη Γεωπληροφορική Μεταπτυχιακό Πρόγραµµα ΓΕΩΠΛΗΡΟΦΟΡΙΚΗ ιατύπωση του

Φίλτρα Kalman Εξαγωγή των εξισώσεων τους µε βάση το κριτήριο ελαχιστοποίησης της Μεθόδου των Ελαχίστων Τετραγώνων. Αναλυτικές Μέθοδοι στη Γεωπληροφορική Μεταπτυχιακό Πρόγραµµα ΓΕΩΠΛΗΡΟΦΟΡΙΚΗ ιατύπωση του

Ασκήσεις Φροντιστηρίου «Υπολογιστική Νοημοσύνη Ι» 5 o Φροντιστήριο

Πρόβλημα ο Ασκήσεις Φροντιστηρίου 5 o Φροντιστήριο Δίνεται το παρακάτω σύνολο εκπαίδευσης: # Είσοδος Κατηγορία 0 0 0 Α 2 0 0 Α 0 Β 4 0 0 Α 5 0 Β 6 0 0 Α 7 0 Β 8 Β α) Στον παρακάτω κύβο τοποθετείστε τα

Πρόβλημα ο Ασκήσεις Φροντιστηρίου 5 o Φροντιστήριο Δίνεται το παρακάτω σύνολο εκπαίδευσης: # Είσοδος Κατηγορία 0 0 0 Α 2 0 0 Α 0 Β 4 0 0 Α 5 0 Β 6 0 0 Α 7 0 Β 8 Β α) Στον παρακάτω κύβο τοποθετείστε τα

EΦΑΡΜΟΓΕΣ ΤΗΣ ΨΗΦΙΑΚΗΣ ΕΠΕΞΕΡΓΑΣΙΑΣ ΣΗΜΑΤΩΝ Γραµµική Εκτίµηση Τυχαίων Σηµάτων Φίλτρο Kalman

EΦΑΡΜΟΓΕΣ ΤΗΣ ΨΗΦΙΑΚΗΣ ΕΠΕΞΕΡΓΑΣΙΑΣ ΣΗΜΑΤΩΝ Γραµµική Εκτίµηση Τυχαίων Σηµάτων Φίλτρο Kalma Εµµανουήλ Ζ. Ψαράκης Πολυτεχνική Σχολή Τµήµα Μηχανικών Η/Υ & Πληροφορικής Ακολουθιακή Επεξεργασία Τα δείγµατα

EΦΑΡΜΟΓΕΣ ΤΗΣ ΨΗΦΙΑΚΗΣ ΕΠΕΞΕΡΓΑΣΙΑΣ ΣΗΜΑΤΩΝ Γραµµική Εκτίµηση Τυχαίων Σηµάτων Φίλτρο Kalma Εµµανουήλ Ζ. Ψαράκης Πολυτεχνική Σχολή Τµήµα Μηχανικών Η/Υ & Πληροφορικής Ακολουθιακή Επεξεργασία Τα δείγµατα

Στοχαστικά Σήµατα και Εφαρµογές. Προσαρµοστικά φίλτρα. ιδάσκων: Ν. Παπανδρέου (Π.. 407/80) Πανεπιστήµιο Πατρών ΤµήµαΜηχανικώνΗ/Υ και Πληροφορικής

Στοχαστικά Σήµατα & Εφαρµογές Προσαρµοστικά φίλτρα ιδάσκων: Ν. Παπανδρέου (Π.. 47/8) Πανεπιστήµιο Πατρών ΤµήµαΜηχανικώνΗ/Υ και Πληροφορικής CEID 7-8 Εισαγωγή Υπολογισµός FIR φίλτρου Wieer σε στάσιµο περιβάλλον:

Στοχαστικά Σήµατα & Εφαρµογές Προσαρµοστικά φίλτρα ιδάσκων: Ν. Παπανδρέου (Π.. 47/8) Πανεπιστήµιο Πατρών ΤµήµαΜηχανικώνΗ/Υ και Πληροφορικής CEID 7-8 Εισαγωγή Υπολογισµός FIR φίλτρου Wieer σε στάσιµο περιβάλλον:

Μια εισαγωγή στο φίλτρο Kalman

1 Μια εισαγωγή στο φίλτρο Kalman Το 1960, R.E. Kalman δημόσιευσε το διάσημο έγγραφό του περιγράφοντας μια επαναλαμβανόμενη λύση στο γραμμικό πρόβλημα φιλτραρίσματος διακριτών δεδομένων. Από εκείνη τη στιγμή,

1 Μια εισαγωγή στο φίλτρο Kalman Το 1960, R.E. Kalman δημόσιευσε το διάσημο έγγραφό του περιγράφοντας μια επαναλαμβανόμενη λύση στο γραμμικό πρόβλημα φιλτραρίσματος διακριτών δεδομένων. Από εκείνη τη στιγμή,

5. ΤΟ ΓΕΝΙΚΟ ΓΡΑΜΜΙΚΟ ΜΟΝΤΕΛΟ (GENERAL LINEAR MODEL) 5.1 Εναλλακτικά μοντέλα του απλού γραμμικού μοντέλου: Το εκθετικό μοντέλο

5. ΤΟ ΓΕΝΙΚΟ ΓΡΑΜΜΙΚΟ ΜΟΝΤΕΛΟ (GENERAL LINEAR MODEL) 5.1 Εναλλακτικά μοντέλα του απλού γραμμικού μοντέλου: Το εκθετικό μοντέλο Ένα εναλλακτικό μοντέλο της απλής γραμμικής παλινδρόμησης (που χρησιμοποιήθηκε

5. ΤΟ ΓΕΝΙΚΟ ΓΡΑΜΜΙΚΟ ΜΟΝΤΕΛΟ (GENERAL LINEAR MODEL) 5.1 Εναλλακτικά μοντέλα του απλού γραμμικού μοντέλου: Το εκθετικό μοντέλο Ένα εναλλακτικό μοντέλο της απλής γραμμικής παλινδρόμησης (που χρησιμοποιήθηκε

Εφαρμοσμένη Στατιστική

ΠΑΝΕΠΙΣΤΗΜΙΟ ΙΩΑΝΝΙΝΩΝ ΑΝΟΙΚΤΑ ΑΚΑΔΗΜΑΪΚΑ ΜΑΘΗΜΑΤΑ Εφαρμοσμένη Στατιστική Παλινδρόμηση Διδάσκων: Επίκουρος Καθηγητής Κωνσταντίνος Μπλέκας Άδειες Χρήσης Το παρόν εκπαιδευτικό υλικό υπόκειται σε άδειες χρήσης

ΠΑΝΕΠΙΣΤΗΜΙΟ ΙΩΑΝΝΙΝΩΝ ΑΝΟΙΚΤΑ ΑΚΑΔΗΜΑΪΚΑ ΜΑΘΗΜΑΤΑ Εφαρμοσμένη Στατιστική Παλινδρόμηση Διδάσκων: Επίκουρος Καθηγητής Κωνσταντίνος Μπλέκας Άδειες Χρήσης Το παρόν εκπαιδευτικό υλικό υπόκειται σε άδειες χρήσης

Β Γραφικές παραστάσεις - Πρώτο γράφημα Σχεδιάζοντας το μήκος της σανίδας συναρτήσει των φάσεων της σελήνης μπορείτε να δείτε αν υπάρχει κάποιος συσχετισμός μεταξύ των μεγεθών. Ο συνήθης τρόπος γραφικής

Β Γραφικές παραστάσεις - Πρώτο γράφημα Σχεδιάζοντας το μήκος της σανίδας συναρτήσει των φάσεων της σελήνης μπορείτε να δείτε αν υπάρχει κάποιος συσχετισμός μεταξύ των μεγεθών. Ο συνήθης τρόπος γραφικής

Πληροφοριακά Συστήματα & Περιβάλλον

ΑΡΙΣΤΟΤΕΛΕΙΟ ΠΑΝΕΠΙΣΤΗΜΙΟ ΘΕΣΣΑΛΟΝΙΚΗΣ ΑΝΟΙΧΤΑ ΑΚΑΔΗΜΑΙΚΑ ΜΑΘΗΜΑΤΑ Πληροφοριακά Συστήματα & Περιβάλλον Ενότητα 8: Τεχνητά Νευρωνικά Δίκτυα Παναγιώτης Λεφάκης Δασολογίας & Φυσικού Περιβάλλοντος Άδειες Χρήσης

ΑΡΙΣΤΟΤΕΛΕΙΟ ΠΑΝΕΠΙΣΤΗΜΙΟ ΘΕΣΣΑΛΟΝΙΚΗΣ ΑΝΟΙΧΤΑ ΑΚΑΔΗΜΑΙΚΑ ΜΑΘΗΜΑΤΑ Πληροφοριακά Συστήματα & Περιβάλλον Ενότητα 8: Τεχνητά Νευρωνικά Δίκτυα Παναγιώτης Λεφάκης Δασολογίας & Φυσικού Περιβάλλοντος Άδειες Χρήσης

Ανάπτυξη και δηµιουργία µοντέλων προσοµοίωσης ροής και µεταφοράς µάζας υπογείων υδάτων σε καρστικούς υδροφορείς µε χρήση θεωρίας νευρωνικών δικτύων

Ανάπτυξη και δηµιουργία µοντέλων προσοµοίωσης ροής και µεταφοράς µάζας υπογείων υδάτων σε καρστικούς υδροφορείς µε χρήση θεωρίας νευρωνικών δικτύων Περίληψη ιδακτορικής ιατριβής Τριχακης Ιωάννης Εργαστήριο

Ανάπτυξη και δηµιουργία µοντέλων προσοµοίωσης ροής και µεταφοράς µάζας υπογείων υδάτων σε καρστικούς υδροφορείς µε χρήση θεωρίας νευρωνικών δικτύων Περίληψη ιδακτορικής ιατριβής Τριχακης Ιωάννης Εργαστήριο

Τεχνητή Νοημοσύνη. TMHMA ΠΛΗΡΟΦΟΡΙΚΗΣ & ΤΕΧΝΟΛΟΓΙΑΣ ΥΠΟΛΟΓΙΣΤΩΝ. Εξάμηνο 5ο Οικονόμου Παναγιώτης & Ελπινίκη Παπαγεωργίου. Νευρωνικά Δίκτυα.

Τεχνητή Νοημοσύνη. TMHMA ΠΛΗΡΟΦΟΡΙΚΗΣ & ΤΕΧΝΟΛΟΓΙΑΣ ΥΠΟΛΟΓΙΣΤΩΝ Εξάμηνο 5ο Οικονόμου Παναγιώτης & Ελπινίκη Παπαγεωργίου. Νευρωνικά Δίκτυα. 1 ΤΕΧΝΗΤΑ ΝΕΥΡΩΝΙΚΑ ΔΙΚΤΥΑ Χαρακτηριστικά Είδη εκπαίδευσης Δίκτυα

Τεχνητή Νοημοσύνη. TMHMA ΠΛΗΡΟΦΟΡΙΚΗΣ & ΤΕΧΝΟΛΟΓΙΑΣ ΥΠΟΛΟΓΙΣΤΩΝ Εξάμηνο 5ο Οικονόμου Παναγιώτης & Ελπινίκη Παπαγεωργίου. Νευρωνικά Δίκτυα. 1 ΤΕΧΝΗΤΑ ΝΕΥΡΩΝΙΚΑ ΔΙΚΤΥΑ Χαρακτηριστικά Είδη εκπαίδευσης Δίκτυα

HMY 795: Αναγνώριση Προτύπων

HMY 795: Αναγνώριση Προτύπων Διάλεξη 2 Επισκόπηση θεωρίας πιθανοτήτων Τυχαίες μεταβλητές: Βασικές έννοιες Τυχαία μεταβλητή: Μεταβλητή της οποίας δε γνωρίζουμε με βεβαιότητα την τιμή (σε αντίθεση με τις

HMY 795: Αναγνώριση Προτύπων Διάλεξη 2 Επισκόπηση θεωρίας πιθανοτήτων Τυχαίες μεταβλητές: Βασικές έννοιες Τυχαία μεταβλητή: Μεταβλητή της οποίας δε γνωρίζουμε με βεβαιότητα την τιμή (σε αντίθεση με τις

ΕΛΛΗΝΙΚΟ ΑΝΟΙΚΤΟ ΠΑΝΕΠΙΣΤΗΜΙΟ

Θ.Ε. ΠΛΗ31 (2004-5) ΓΡΑΠΤΗ ΕΡΓΑΣΙΑ #3 Στόχος Στόχος αυτής της εργασίας είναι η απόκτηση δεξιοτήτων σε θέματα που αφορούν τα Τεχνητά Νευρωνικά Δίκτυα και ποιο συγκεκριμένα θέματα εκπαίδευσης και υλοποίησης.

Θ.Ε. ΠΛΗ31 (2004-5) ΓΡΑΠΤΗ ΕΡΓΑΣΙΑ #3 Στόχος Στόχος αυτής της εργασίας είναι η απόκτηση δεξιοτήτων σε θέματα που αφορούν τα Τεχνητά Νευρωνικά Δίκτυα και ποιο συγκεκριμένα θέματα εκπαίδευσης και υλοποίησης.

E [ -x ^2 z] = E[x z]

![E [ -x ^2 z] = E[x z] E [ -x ^2 z] = E[x z]](/thumbs/69/60621176.jpg) 1 1.ΦΙΛΤΡΟ KALMAN ΔΙΑΚΡΙΤΟΥ ΧΡΟΝΟΥ Σε αυτήν την διάλεξη θα πάμε στο φίλτρο με περισσότερες λεπτομέρειες, και θα παράσχουμε μια νέα παραγωγή για το φίλτρο Kalman, αυτή τη φορά βασισμένο στην ιδέα της γραμμικής

1 1.ΦΙΛΤΡΟ KALMAN ΔΙΑΚΡΙΤΟΥ ΧΡΟΝΟΥ Σε αυτήν την διάλεξη θα πάμε στο φίλτρο με περισσότερες λεπτομέρειες, και θα παράσχουμε μια νέα παραγωγή για το φίλτρο Kalman, αυτή τη φορά βασισμένο στην ιδέα της γραμμικής

Αναγνώριση Προτύπων Ι

Αναγνώριση Προτύπων Ι Ενότητα 4: Νευρωνικά Δίκτυα στην Ταξιμόμηση Προτύπων Αν. Καθηγητής Δερματάς Ευάγγελος Τμήμα Ηλεκτρολόγων Μηχανικών και Τεχνολογίας Υπολογιστών Άδειες Χρήσης Το παρόν εκπαιδευτικό

Αναγνώριση Προτύπων Ι Ενότητα 4: Νευρωνικά Δίκτυα στην Ταξιμόμηση Προτύπων Αν. Καθηγητής Δερματάς Ευάγγελος Τμήμα Ηλεκτρολόγων Μηχανικών και Τεχνολογίας Υπολογιστών Άδειες Χρήσης Το παρόν εκπαιδευτικό

σύνθεση και απλοποίησή τους θεωρήµατα της άλγεβρας Boole, αξιώµατα του Huntington, κλπ.

Εισαγωγή Εργαστήριο 2 ΛΟΓΙΚΑ ΚΥΚΛΩΜΑΤΑ Σκοπός του εργαστηρίου είναι να κατανοήσουµε τον τρόπο µε τον οποίο εκφράζεται η ψηφιακή λογική υλοποιώντας ασκήσεις απλά και σύνθετα λογικά κυκλώµατα (χρήση του

Εισαγωγή Εργαστήριο 2 ΛΟΓΙΚΑ ΚΥΚΛΩΜΑΤΑ Σκοπός του εργαστηρίου είναι να κατανοήσουµε τον τρόπο µε τον οποίο εκφράζεται η ψηφιακή λογική υλοποιώντας ασκήσεις απλά και σύνθετα λογικά κυκλώµατα (χρήση του

HMY 799 1: Αναγνώριση Συστημάτων

HMY 799 : Αναγνώριση Συστημάτων Διάλεξη Στοχαστικές Τυχαίες Μεταβλητές/ Στοχαστικά Σήματα Πειραματικά δεδομένα >Επιλογή τύπου μοντέλου >Επιλογή κριτηρίου >Υπολογισμός >Επικύρωση Προσαρμογή καμπύλης (Curve

HMY 799 : Αναγνώριση Συστημάτων Διάλεξη Στοχαστικές Τυχαίες Μεταβλητές/ Στοχαστικά Σήματα Πειραματικά δεδομένα >Επιλογή τύπου μοντέλου >Επιλογή κριτηρίου >Υπολογισμός >Επικύρωση Προσαρμογή καμπύλης (Curve

Μοντέλα Παλινδρόμησης. Άγγελος Μάρκος, Λέκτορας ΠΤ Ε, ΠΘ

Μοντέλα Παλινδρόμησης Άγγελος Μάρκος, Λέκτορας ΠΤ Ε, ΠΘ Εισαγωγή (1) Σε αρκετές περιπτώσεις επίλυσης προβλημάτων ενδιαφέρει η ταυτόχρονη μελέτη δύο ή περισσότερων μεταβλητών, για να προσδιορίσουμε με ποιο

Μοντέλα Παλινδρόμησης Άγγελος Μάρκος, Λέκτορας ΠΤ Ε, ΠΘ Εισαγωγή (1) Σε αρκετές περιπτώσεις επίλυσης προβλημάτων ενδιαφέρει η ταυτόχρονη μελέτη δύο ή περισσότερων μεταβλητών, για να προσδιορίσουμε με ποιο

Ανάλυση Δεδοµένων µε χρήση του Στατιστικού Πακέτου R

Ανάλυση Δεδοµένων µε χρήση του Στατιστικού Πακέτου R, Επίκουρος Καθηγητής, Τοµέας Μαθηµατικών, Σχολή Εφαρµοσµένων Μαθηµατικών και Φυσικών Επιστηµών, Εθνικό Μετσόβιο Πολυτεχνείο. Περιεχόµενα Εισαγωγή στη

Ανάλυση Δεδοµένων µε χρήση του Στατιστικού Πακέτου R, Επίκουρος Καθηγητής, Τοµέας Μαθηµατικών, Σχολή Εφαρµοσµένων Μαθηµατικών και Φυσικών Επιστηµών, Εθνικό Μετσόβιο Πολυτεχνείο. Περιεχόµενα Εισαγωγή στη

ΠΑΝΕΠΙΣΤΗΜΙΟ ΜΑΚΕ ΟΝΙΑΣ ΟΙΚΟΝΟΜΙΚΩΝ ΚΑΙ ΚΟΙΝΩΝΙΚΩΝ ΕΠΙΣΤΗΜΩΝ ΤΜΗΜΑ ΕΦΑΡΜΟΣΜΕΝΗΣ ΠΛΗΡΟΦΟΡΙΚΗΣ ΝΕΥΡΩΝΙΚΑ ΙΚΤΥΑ

ΘΕΜΑ ο (2.5 µονάδες) ΠΑΝΕΠΙΣΤΗΜΙΟ ΜΑΚΕ ΟΝΙΑΣ ΟΙΚΟΝΟΜΙΚΩΝ ΚΑΙ ΚΟΙΝΩΝΙΚΩΝ ΕΠΙΣΤΗΜΩΝ ΤΜΗΜΑ ΕΦΑΡΜΟΣΜΕΝΗΣ ΠΛΗΡΟΦΟΡΙΚΗΣ ΝΕΥΡΩΝΙΚΑ ΙΚΤΥΑ Τελικές εξετάσεις Παρασκευή 9 Ιανουαρίου 2007 5:00-8:00 εδοµένου ότι η

ΘΕΜΑ ο (2.5 µονάδες) ΠΑΝΕΠΙΣΤΗΜΙΟ ΜΑΚΕ ΟΝΙΑΣ ΟΙΚΟΝΟΜΙΚΩΝ ΚΑΙ ΚΟΙΝΩΝΙΚΩΝ ΕΠΙΣΤΗΜΩΝ ΤΜΗΜΑ ΕΦΑΡΜΟΣΜΕΝΗΣ ΠΛΗΡΟΦΟΡΙΚΗΣ ΝΕΥΡΩΝΙΚΑ ΙΚΤΥΑ Τελικές εξετάσεις Παρασκευή 9 Ιανουαρίου 2007 5:00-8:00 εδοµένου ότι η

καθ. Βασίλης Μάγκλαρης

ΣΤΟΧΑΣΤΙΚΕΣ ΔΙΕΡΓΑΣΙΕΣ & ΒΕΛΤΙΣΤΟΠΟΙΗΣΗ Αίθουσα 005 - Νέα Κτίρια ΣΗΜΜΥ Ε.Μ.Π. Ενισχυτική Μάθηση - Δυναμικός Προγραμματισμός: 1. Markov Decision Processes 2. Bellman s Optimality Criterion 3. Αλγόριθμος

ΣΤΟΧΑΣΤΙΚΕΣ ΔΙΕΡΓΑΣΙΕΣ & ΒΕΛΤΙΣΤΟΠΟΙΗΣΗ Αίθουσα 005 - Νέα Κτίρια ΣΗΜΜΥ Ε.Μ.Π. Ενισχυτική Μάθηση - Δυναμικός Προγραμματισμός: 1. Markov Decision Processes 2. Bellman s Optimality Criterion 3. Αλγόριθμος

ΨΗΦΙΑΚΗ ΕΠΕΞΕΡΓΑΣΙΑ ΣΗΜΑΤΩΝ Εισαγωγή. Εµµανουήλ Ζ. Ψαράκης Πολυτεχνική Σχολή Τµήµα Μηχανικών Η/Υ & Πληροφορικής

ΨΗΦΙΑΚΗ ΕΠΕΞΕΡΓΑΣΙΑ ΣΗΜΑΤΩΝ Εισαγωγή Εµµανουήλ Ζ. Ψαράκης Πολυτεχνική Σχολή Τµήµα Μηχανικών Η/Υ & Πληροφορικής Εφαρµογές της Ψηφιακής Επεξεργασίας Σηµάτων Ακουστικά Σήµατα ü Αναγνώριση, Ανάλυση, Σύνθεση,

ΨΗΦΙΑΚΗ ΕΠΕΞΕΡΓΑΣΙΑ ΣΗΜΑΤΩΝ Εισαγωγή Εµµανουήλ Ζ. Ψαράκης Πολυτεχνική Σχολή Τµήµα Μηχανικών Η/Υ & Πληροφορικής Εφαρµογές της Ψηφιακής Επεξεργασίας Σηµάτων Ακουστικά Σήµατα ü Αναγνώριση, Ανάλυση, Σύνθεση,